GSP1342

Présentation

Supposons que vous soyez ingénieur de données chez Cymbal Gaming. Avec

l'équipe de développement, vous créez un nouveau jeu d'e-sport : Galactic

Grand Prix. Le jeu génère des données en temps réel basées sur des parties en

un contre un entre deux joueurs de différentes équipes. Par exemple, deux

joueurs s'affrontent lors d'un événement, un vainqueur est désigné, et des

points sont attribués au joueur et à l'équipe gagnants. Vous devez concevoir

une solution pour gérer ces données en flux continu à l'aide de Pub/Sub, puis

stocker les résultats dans des tables BigQuery. À partir de ces tables, vous

devez créer les vues de classement dans BigQuery, qui serviront de structure

de données backend pour les tableaux de bord.

Vous avez lu que BigQuery peut se connecter directement à un abonnement

Pub/Sub et qu'il peut être utilisé pour ce type de cas d'utilisation. Vous

avez également appris que Gemini peut vous aider tout au long du processus,

par exemple si vous rencontrez des difficultés au moment d'écrire une nouvelle

requête. Gemini peut même vous fournir des suggestions pour résoudre des

problèmes. L'utilisation de ces fonctionnalités vous permettra d'être plus

autonome dans votre travail et, potentiellement, de gagner en efficacité.

Toutefois, vous ne savez pas par où commencer.

Lorsque vous démarrerez l'atelier, l'environnement ne contiendra aucune

ressource prédéfinie.

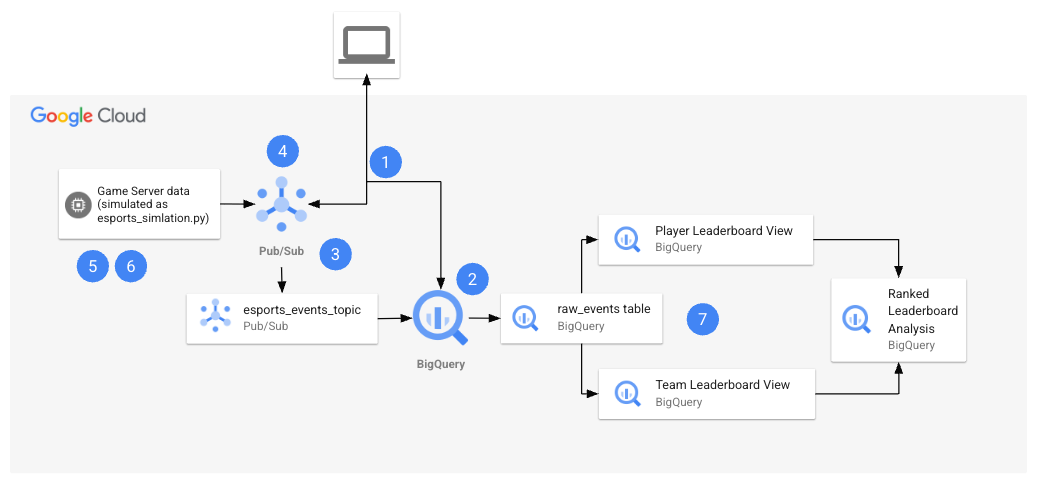

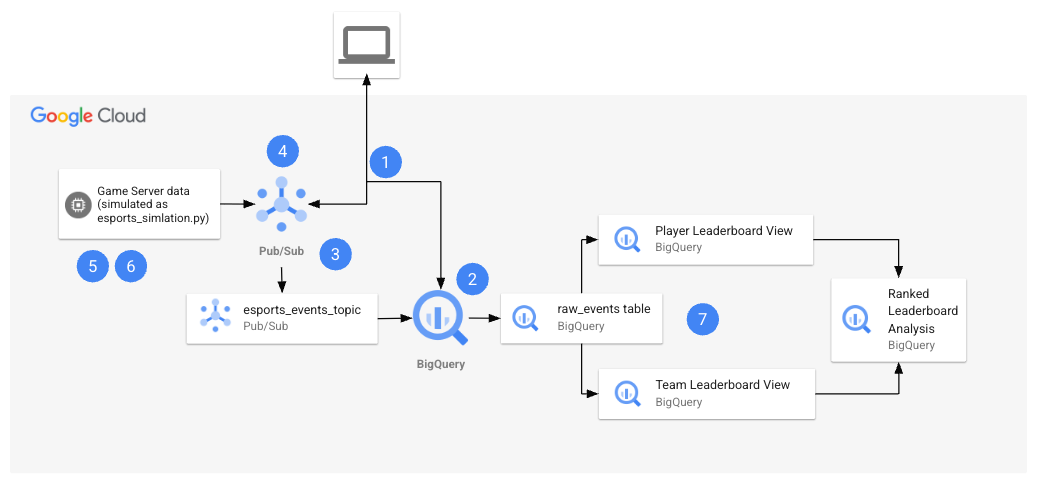

À la fin de l'atelier, vous aurez utilisé l'architecture pour effectuer

plusieurs tâches.

Le tableau suivant fournit une explication détaillée de chaque tâche par

rapport à l'architecture de l'atelier.

| Tâche numérotée |

Détails |

| 1. |

Configurer des variables d'environnement dans Cloud Shell

|

| 2. |

Créer les ressources BigQuery :

Vous allez

utiliser des commandes Cloud Shell pour créer l'ensemble de données et

la table BigQuery.

|

| 3. |

Créer le sujet et l'abonnement Pub/Sub :

Vous

allez utiliser la console Pub/Sub pour créer le sujet et l'abonnement,

puis modifier l'abonnement pour qu'il puisse écrire dans votre ensemble

de données et votre table BigQuery.

|

| 4. |

Accorder des autorisations IAM Pub/Sub :

Vous

allez utiliser la console IAM pour accorder des autorisations au compte

de service Compute.

|

| 5. |

Récupérer les fichiers Python du dépôt :

Dans

cette tâche, vous allez récupérer le fichier Python du dépôt et le

configurer pour votre projet.

|

| 6. |

Générer des données synthétiques :

Une fois le

fichier Python configuré pour votre projet, vous exécuterez le fichier

esports-simulation.py, qui utilise Python pour générer en continu des

messages Pub/Sub pour les événements de jeu.

|

| 7. |

Vérifier les résultats dans BigQuery :

Maintenant

que vous avez envoyé les données à votre sujet Pub/Sub, elles sont

capturées et stockées dans votre table BigQuery. Vous exécuterez des

requêtes sur la table et utiliserez une vue pour analyser les résultats

des parties.

|

Objectifs

Dans cet atelier, vous allez apprendre à :

- créer les ressources cloud et accorder l'accès à ces ressources ;

-

récupérer le fichier Python à partir du dépôt et le modifier pour votre

projet ;

- générer des données synthétiques ;

- vérifier les résultats des joueurs et des équipes dans BigQuery.

Enfin, vous pourrez prendre le temps de réfléchir à ce que vous avez appris

dans cet atelier et à la manière dont vous pourriez traiter vos propres cas

d'utilisation avec des données en flux continu en répondant aux questions du

journal de l'atelier.

Préparation

Avant de cliquer sur le bouton "Démarrer l'atelier"

Lisez ces instructions. Les ateliers sont minutés, et vous ne pouvez pas les mettre en pause. Le minuteur, qui démarre lorsque vous cliquez sur Démarrer l'atelier, indique combien de temps les ressources Google Cloud resteront accessibles.

Cet atelier pratique vous permet de suivre les activités dans un véritable environnement cloud, et non dans un environnement de simulation ou de démonstration. Des identifiants temporaires vous sont fournis pour vous permettre de vous connecter à Google Cloud le temps de l'atelier.

Pour réaliser cet atelier :

- Vous devez avoir accès à un navigateur Internet standard (nous vous recommandons d'utiliser Chrome).

Remarque : Ouvrez une fenêtre de navigateur en mode incognito (recommandé) ou de navigation privée pour effectuer cet atelier. Vous éviterez ainsi les conflits entre votre compte personnel et le compte temporaire de participant, qui pourraient entraîner des frais supplémentaires facturés sur votre compte personnel.

- Vous disposez d'un temps limité. N'oubliez pas qu'une fois l'atelier commencé, vous ne pouvez pas le mettre en pause.

Remarque : Utilisez uniquement le compte de participant pour cet atelier. Si vous utilisez un autre compte Google Cloud, des frais peuvent être facturés à ce compte.

Démarrer l'atelier et se connecter à la console Google Cloud

-

Cliquez sur le bouton Démarrer l'atelier. Si l'atelier est payant, une boîte de dialogue s'affiche pour vous permettre de sélectionner un mode de paiement.

Sur la gauche, vous trouverez le panneau "Détails concernant l'atelier", qui contient les éléments suivants :

- Le bouton "Ouvrir la console Google Cloud"

- Le temps restant

- Les identifiants temporaires que vous devez utiliser pour cet atelier

- Des informations complémentaires vous permettant d'effectuer l'atelier

-

Cliquez sur Ouvrir la console Google Cloud (ou effectuez un clic droit et sélectionnez Ouvrir le lien dans la fenêtre de navigation privée si vous utilisez le navigateur Chrome).

L'atelier lance les ressources, puis ouvre la page "Se connecter" dans un nouvel onglet.

Conseil : Réorganisez les onglets dans des fenêtres distinctes, placées côte à côte.

Remarque : Si la boîte de dialogue Sélectionner un compte s'affiche, cliquez sur Utiliser un autre compte.

-

Si nécessaire, copiez le nom d'utilisateur ci-dessous et collez-le dans la boîte de dialogue Se connecter.

{{{user_0.username | "Username"}}}

Vous trouverez également le nom d'utilisateur dans le panneau "Détails concernant l'atelier".

-

Cliquez sur Suivant.

-

Copiez le mot de passe ci-dessous et collez-le dans la boîte de dialogue Bienvenue.

{{{user_0.password | "Password"}}}

Vous trouverez également le mot de passe dans le panneau "Détails concernant l'atelier".

-

Cliquez sur Suivant.

Important : Vous devez utiliser les identifiants fournis pour l'atelier. Ne saisissez pas ceux de votre compte Google Cloud.

Remarque : Si vous utilisez votre propre compte Google Cloud pour cet atelier, des frais supplémentaires peuvent vous être facturés.

-

Accédez aux pages suivantes :

- Acceptez les conditions d'utilisation.

- N'ajoutez pas d'options de récupération ni d'authentification à deux facteurs (ce compte est temporaire).

- Ne vous inscrivez pas à des essais sans frais.

Après quelques instants, la console Cloud s'ouvre dans cet onglet.

Remarque : Pour accéder aux produits et services Google Cloud, cliquez sur le menu de navigation ou saisissez le nom du service ou du produit dans le champ Recherche.

Tâche 1 : Configurer des variables d'environnement dans Cloud Shell

Dans cette tâche, vous allez configurer des variables d'environnement dans

Cloud Shell.

-

Cliquez sur Activer Cloud Shell pour ouvrir Cloud Shell.

-

Vous devez autoriser son utilisation, car c'est la première fois que vous

utilisez Cloud Shell dans cet atelier. Pour ce faire, cliquez sur

Continuer, puis sur Autoriser dans les

fenêtres pop-up.

-

Exécutez les commandes suivantes.

export PROJECT_ID="{{{project_0.project_id|set at lab start}}}"

export BUCKET_NAME="{{{project_0.project_id|set at lab start}}}-bucket"

-

Exécutez les commandes ci-dessous pour vérifier que les variables sont

stockées.

echo ${PROJECT_ID}

echo ${BUCKET_NAME}

Vous utiliserez ces variables plus tard dans l'atelier.

Tâche 2 : Créer les ressources BigQuery

Dans cette tâche, vous allez créer l'ensemble de données et la table BigQuery

qui recevront les événements bruts en flux continu de Pub/Sub.

Créer l'ensemble de données BigQuery

Dans cette tâche, vous allez créer l'ensemble de données BigQuery qui servira

de conteneur pour vos tables et vos vues.

-

En haut de la console Google Cloud, utilisez la barre de recherche pour

trouver BigQuery et y accéder. La fenêtre pop-up

"Bienvenue…" s'affiche.

-

Cliquez sur OK.

-

Dans le volet "Explorateur" à gauche, recherchez votre ID de projet

() et cliquez dessus.

-

Cliquez sur les trois points verticaux (⋮) à droite de l'ID de votre

projet pour ouvrir le menu d'options, puis sélectionnez

Créer un ensemble de données.

-

Dans le panneau "Créer un ensemble de données", configurez les paramètres

suivants :

-

ID de l'ensemble de données : esports_analytics

-

Emplacement des données : sélectionnez un emplacement dans le menu

déroulant. Pour cet atelier, vous pouvez sélectionner "US" (plusieurs

régions aux États-Unis).

-

Conservez les valeurs par défaut des autres paramètres, puis cliquez sur

CRÉER UN ENSEMBLE DE DONNÉES. Le nouvel ensemble de

données esports_analytics apparaît sous l'ID de votre projet

dans le volet "Explorateur". Cela confirme que vous avez bien créé

l'ensemble de données.

Créer la table BigQuery

-

Dans le volet "Explorateur", développez votre projet et sélectionnez

l'ensemble de données esports_analytics.

-

Cliquez sur les trois points verticaux (⋮) à côté du nom de l'ensemble de

données, puis sélectionnez Créer une table.

-

Configurez la table avec les paramètres suivants :

-

Nom de la table :

raw_events

-

Schéma : cliquez sur

Modifier sous forme de texte et fournissez le tableau

JSON suivant.

[

{"name": "event_id", "type": "STRING", "mode": "NULLABLE"},

{"name": "match_id", "type": "STRING", "mode": "NULLABLE"},

{"name": "game_name", "type": "STRING", "mode": "NULLABLE"},

{"name": "event_type", "type": "STRING", "mode": "NULLABLE"},

{"name": "team_a_id", "type": "STRING", "mode": "NULLABLE"},

{"name": "player_a_id", "type": "STRING", "mode": "NULLABLE"},

{"name": "team_b_id", "type": "STRING", "mode": "NULLABLE"},

{"name": "player_b_id", "type": "STRING", "mode": "NULLABLE"},

{"name": "winner_player_id", "type": "STRING", "mode": "NULLABLE"},

{"name": "winner_team_id", "type": "STRING", "mode": "NULLABLE"},

{"name": "timestamp", "type": "TIMESTAMP", "mode": "NULLABLE"}

]

-

Cliquez sur Créer une table.

Cette requête crée la table raw_events dans l'ensemble de

données esports_analytics.

Cliquez sur Vérifier ma progression pour valider l'objectif.

Créer les ressources BigQuery

Tâche 3 : Créer le sujet et l'abonnement Pub/Sub

Dans cette tâche, vous allez créer le sujet et l'abonnement Pub/Sub pour

recevoir les données de jeu en flux continu, ajouter des autorisations IAM et

modifier l'abonnement pour permettre aux applications de recevoir des messages

de ce sujet et de les diriger vers la table raw_events dans

BigQuery.

Créer le sujet

-

Accédez à Pub/Sub dans la console Google Cloud. Vous pouvez

utiliser la barre de recherche en haut de la page pour trouver l'outil.

- En haut de la page, cliquez sur + CRÉER UN SUJET.

-

Pour l'ID du sujet, saisissez

esports_events_topic.

-

L'option

Ajouter un abonnement par défaut s'affiche. Laissez-la

activée.

- Conservez les valeurs par défaut des autres paramètres.

- Cliquez sur CRÉER.

Le sujet et l'abonnement sont créés.

Modifier la configuration de l'abonnement et définir les autorisations IAM

-

Dans la liste des abonnements, cliquez sur

esports_events_topic-sub.

-

Cliquez sur MODIFIER. Les options d'abonnement

s'affichent sur la page de modification de l'abonnement.

-

Pour le type de livraison, sélectionnez

Écrire dans BigQuery. D'autres options s'affichent.

-

Sélectionnez esports_analytics pour l'option "Ensemble de

données".

-

Saisissez raw_events pour la table. Notez qu'une erreur

semblable à celle-ci s'affiche :

Le compte de service service-@gcp-sa-pubsub.iam.gserviceaccount.com ne dispose pas des autorisations nécessaires pour écrire dans la table BigQuery : bigquery.tables.get et bigquery.tables.updateData.

Cela signifie que vous devez accorder les autorisations adéquates au

compte de service Pub/Sub pour écrire dans la table des événements bruts.

C'est ce que nous allons voir à présent.

Accorder au compte de service Pub/Sub des autorisations sur la table BigQuery

-

Copiez l'adresse e-mail du compte de service à partir du message d'erreur.

service-@gcp-sa-pubsub.iam.gserviceaccount.com

-

Accéder à BigQuery : ouvrez la page

BigQuery de la console dans un nouvel onglet de navigateur.

-

Partager l'ensemble de données : dans le panneau

Explorateur, recherchez l'ensemble de données

esports_analytics, cliquez sur les trois points verticaux (⋮) à

côté, puis sélectionnez Partager et

Gérer les autorisations.

-

Ajouter le compte principal : dans le panneau des

autorisations de l'ensemble de données qui s'affiche, cliquez

sur Ajouter un compte principal.

-

Collez l'adresse e-mail complète du compte de service Pub/Sub (obtenue à

l'étape 1) dans le champ

Nouveaux comptes principaux, puis

appuyez sur la touche de tabulation pour terminer l'opération.

-

Pour le rôle, sélectionnez Éditeur de données BigQuery.

- Cliquez sur Enregistrer.

Votre abonnement BigQuery est désormais autorisé à écrire les messages

entrants directement dans la table raw_events.

Terminer les modifications apportées à l'abonnement Pub/Sub

-

Revenez à l'onglet du navigateur contenant Pub/Sub.

-

Pour la configuration du schéma, choisissez

Utiliser un schéma de table.

-

Pour les autres options, conservez les valeurs par défaut.

-

Cliquez sur METTRE À JOUR.

La configuration de l'abonnement est maintenant enregistrée. L'abonnement

étant correctement configuré, Pub/Sub dirigera tous les messages (les

données d'e-sport en flux continu) vers votre table

raw_events dans BigQuery.

Cliquez sur Vérifier ma progression pour valider l'objectif.

Créer le sujet et l'abonnement Pub/Sub

Tâche 4 : Accorder des autorisations IAM pour Pub/Sub

Pour que votre solution s'exécute correctement, vous devez également accorder

au compte de service Compute l'autorisation de publier des

messages dans le sujet Pub/Sub.

Cela permet à votre script ou application Python d'envoyer des messages au

sujet Pub/Sub.

-

Dans la console Google Cloud, accédez à

IAM et administration > IAM. La liste

des comptes principaux actuellement configurés avec des autorisations

s'affiche.

-

Recherchez le compte principal associé à l'adresse e-mail

-compute@developer.gserviceaccount.com.

-

Modifier les rôles de ce compte principal : cliquez sur

Modifier le compte principal. Le panneau "Modifier

l'accès" s'ouvre pour le compte principal, et le rôle d'éditeur est

inclus.

-

Cliquez sur + Ajouter un autre rôle.

-

Dans le champ Sélectionner un rôle, recherchez et

sélectionnez le rôle Diffuseur Pub/Sub.

-

Cliquez sur Enregistrer.

Le rôle est maintenant attribué au compte principal Compute.

Cliquez sur Vérifier ma progression pour valider l'objectif.

Accorder des autorisations IAM pour Pub/Sub

Tâche 5 : Récupérer les fichiers Python et les configurer

Dans cette tâche, vous allez utiliser wget dans Cloud Shell pour récupérer le

fichier Python à partir d'un bucket Cloud Storage public. Une fois récupéré,

vous ouvrirez le fichier dans l'éditeur Cloud Shell et utiliserez la

fonctionnalité Code Assist de Gemini pour en savoir plus sur son

fonctionnement. Enfin, vous utiliserez l'éditeur Cloud Shell pour configurer

le fichier avec les détails de votre projet.

Récupérer les fichiers Python

-

Revenez dans Cloud Shell.

-

Exécutez la commande suivante pour revenir au répertoire d'accueil.

cd ~

-

Créez le répertoire esports et accédez-y.

mkdir esports

cd esports

-

Récupérez le fichier Python à l'aide des commandes wget ci-dessous.

wget https://storage.googleapis.com/spls/gsp1342/esports-simulation.py

Le terminal confirme que les fichiers ont été téléchargés.

Utiliser Code Assist pour obtenir des explications sur le rôle du fichier

Python

-

Cliquez sur le bouton "Ouvrir l'éditeur" dans Cloud Shell. L'éditeur

Cloud Shell s'ouvre. Le volet Gemini Code Assist s'affiche également.

-

Fermez l'onglet du tutoriel.

-

Dans le volet "Explorateur", développez le dossier esports.

Les fichiers Python s'affichent.

-

Ouvrez le fichier esports-simulation.py.

-

Dans la partie inférieure du volet Gemini Code Assist, un champ permet de

saisir un prompt, avec la mention "Demander à Gemini". Saisissez le prompt

suivant :

Examine le code du fichier esports-simulation.py. Explique ce que fait ce code.

Vous constatez que Code Assist explique en détail ce que fait le code. Dans

les grandes lignes, le code simule un match d'e-sport et publie les événements

dans un sujet Google Cloud Pub/Sub.

Vous pouvez constater que Code Assist a fait quelques suggestions

d'amélioration. N'acceptez pas les suggestions.

Temps de réflexion

-

Compte tenu de vos données et de vos cas d'utilisation, réfléchissez à la

façon dont vous utiliseriez Python pour générer des données synthétiques ou

collecter des données à partir de vos applications, puis à la façon dont

vous publieriez ces données comme sujet Pub/Sub dans votre propre workflow

de développement.

Remarque : Gemini a aidé le développeur à créer le fichier esports-simulation.py. Vous pouvez envisager d'utiliser Gemini pour générer des données de flux synthétiques avec Python pour vos projets, et d'utiliser Code Assist pour vous aider à expliquer votre code et à résoudre les problèmes.

-

En tenant compte de vos données et de vos cas d'utilisation, réfléchissez à

la façon dont vous pourriez utiliser Pub/Sub, puis stocker et analyser les

données diffusées depuis Pub/Sub dans BigQuery.

Configurez le fichier pour votre projet

-

Vers la ligne 10, définissez la variable PROJECT_ID sur votre

ID de projet. Comme pour l'autre fichier, remplacez simplement la ligne

par le code ci-dessous.

PROJECT_ID = "{{{project_0.project_id|set at lab start}}}"

Remarque : Si vous ne modifiez pas les fichiers pour votre projet, vous rencontrerez des erreurs lors de l'exécution dans Cloud Shell lorsque vous exécuterez ces fichiers dans la tâche suivante.

-

Enregistrez le fichier.

Tâche 6 : Générer des données synthétiques

Dans cette tâche, vous allez exécuter les fichiers Python pour générer les

données synthétiques et exécuter le pipeline.

Installer les dépendances et exécuter le simulateur

-

Revenez au terminal Cloud Shell.

-

Vérifiez que vous êtes dans le répertoire d'accueil.

cd ~

-

Accédez au répertoire esports.

cd esports

-

Utilisez pip pour installer les dépendances, en particulier la

bibliothèque Python pour Pub/Sub.

pip install google-cloud-pubsub

-

Exécutez le simulateur. Ce script s'exécutera en continu et enverra des

événements à votre sujet Pub/Sub.

python3 esports-simulation.py

Vous verrez dans le terminal un résultat indiquant que des événements sont

publiés.

Important : Gardez ce terminal ouvert et en cours d'exécution.

Tâche 7 : Vérifier les résultats dans BigQuery

Dans cette tâche, vous allez vérifier que la table "raw_events" est mise à

jour avec les nouveaux messages de l'abonnement Pub/Sub. Vous allez d'abord

interroger la table "raw_events". Ensuite, vous allez créer deux vues, puis

les interroger pour afficher les classements des joueurs et des équipes. Vous

prendrez également le temps de réfléchir à la façon dont Looker pourrait être

utilisé pour améliorer les visualisations du classement.

Interroger la table "raw_events"

-

Revenez dans BigQuery.

-

Dans le panneau "Explorateur", recherchez et sélectionnez la table

raw_events.

-

Cliquez sur Requête. Une requête de modèle vous est

fournie.

-

Modifiez cette requête en sélectionnant tous les enregistrements de la

table raw_events à l'aide de la requête ci-dessous :

SELECT * FROM `{{{project_0.project_id|set at lab start}}}.esports_analytics.raw_events` LIMIT 1000

-

Exécutez la requête. Si des enregistrements s'affichent, cela signifie que

Pub/Sub met à jour la table avec les derniers messages (données de jeu

e-sport) de la simulation.

Créer les vues dans BigQuery

-

Dans l'explorateur, développez votre projet et sélectionnez l'ensemble de

données esports_analytics.

-

Cliquez sur le signe plus pour créer une requête.

-

Dans l'onglet Requête, saisissez la requête suivante.

-- Query 1: Create the Player Leaderboard View

-- This view calculates player scores from raw events and ranks them.

CREATE OR REPLACE VIEW `esports_analytics.player_leaderboard_live` AS

SELECT

RANK() OVER (ORDER BY SUM(CASE WHEN event_type = 'match_end' THEN 5 ELSE 1 END) DESC) as rank,

winner_player_id AS player_id,

SUM(CASE WHEN event_type = 'match_end' THEN 5 ELSE 1 END) AS total_score,

MAX(timestamp) AS last_updated

FROM

`{{{project_0.project_id|set at lab start}}}.esports_analytics.raw_events`

WHERE

winner_player_id IS NOT NULL

AND (event_type = 'player_elimination' OR event_type = 'match_end')

GROUP BY

winner_player_id;

-- Query 2: Create the Team Leaderboard View

-- This view calculates team wins from raw events and ranks them.

CREATE OR REPLACE VIEW `esports_analytics.team_leaderboard_live` AS

SELECT

RANK() OVER (ORDER BY COUNT(*) DESC) as rank,

winner_team_id AS team_id,

COUNT(*) AS total_wins,

MAX(timestamp) AS last_updated

FROM

`{{{project_0.project_id|set at lab start}}}.esports_analytics.raw_events`

WHERE

winner_team_id IS NOT NULL

AND event_type = 'match_end'

GROUP BY

winner_team_id;

Remarque : Les requêtes ci-dessus sont déjà modélisées pour votre projet. En cas d'exécution de cette commande dans votre propre projet, vous devriez remplacer par l'ID de votre projet.

Cette requête crée deux vues : l'une pour le classement des joueurs et

l'autre pour le classement des équipes. Elle trouvera les scores les plus

récents du joueur et de l'équipe, et les classera en conséquence.

Exécuter une requête pour afficher le classement des joueurs

-

Cliquez sur le signe plus pour créer une requête.

-

Dans l'onglet Requête, saisissez la requête suivante.

SELECT * FROM `esports_analytics.player_leaderboard_live` ORDER BY rank;

Le classement des joueurs s'affiche, du premier au douzième, en fonction

du nombre total de victoires.

Exécuter une requête pour afficher le classement des équipes

-

Cliquez sur le signe plus pour créer une requête.

-

Dans l'onglet Requête, saisissez la requête suivante.

SELECT * FROM `esports_analytics.team_leaderboard_live` ORDER BY rank;

Les équipes sont classées de la première à la quatrième place en fonction

du nombre total de victoires.

Temps de réflexion

Examinez les résultats que vous avez obtenus dans BigQuery. Dans cet atelier,

nous avons utilisé des classements basés sur des requêtes SQL dans BigQuery.

Réfléchissez à la façon dont vous pourriez créer un tableau de bord pour ces

classements dans Looker et répondez aux questions suivantes dans votre journal

d'atelier :

- À quoi ressemblerait le tableau de bord ?

- Quelles requêtes BigQuery existantes utiliseriez-vous ?

- Qui aurait besoin d'accéder au tableau de bord ?

-

Devez-vous modifier les requêtes pour que le tableau de bord Looker reste à

jour ?

Cliquez sur Vérifier ma progression pour valider l'objectif.

Vérifier les résultats dans BigQuery

Félicitations !

Vous avez utilisé un script Python pour simuler des données de jeu. Vous avez

également utilisé Code Assist pour vous aider à expliquer le code de ces

scripts. Enfin, vous avez généré des ressources Google Cloud pour prendre en

charge vos données de streaming d'e-sport, y compris un sujet et un abonnement

Pub/Sub, un ensemble de données BigQuery, des tables et des vues, afin de

diffuser ces données et de générer des rapports sur les joueurs et les équipes

en tête. Vous êtes de plus en plus à l'aise avec Google Cloud au fil des

jours, et vous pouvez vous servir de Gemini pour élargir vos connaissances et

compétences en lien avec les workflows d'ingénierie des données.

Étapes suivantes et informations supplémentaires

Formations et certifications Google Cloud

Les formations et certifications Google Cloud vous aident à tirer pleinement parti des technologies Google Cloud. Nos cours portent sur les compétences techniques et les bonnes pratiques à suivre pour être rapidement opérationnel et poursuivre votre apprentissage. Nous proposons des formations pour tous les niveaux, à la demande, en salle et à distance, pour nous adapter aux emplois du temps de chacun. Les certifications vous permettent de valider et de démontrer vos compétences et votre expérience en matière de technologies Google Cloud.

Dernière mise à jour du manuel : 6 août 2025

Dernier test de l'atelier : 6 août 2025

Copyright 2026 Google LLC. Tous droits réservés. Google et le logo Google sont des marques de Google LLC. Tous les autres noms d'entreprises et de produits peuvent être des marques des entreprises auxquelles ils sont associés.