개요

Cloud Run 함수는 HTTP 요청, 메시지 서비스의 메시지, 파일 업로드와 같은 이벤트에 대한 응답으로 실행되는 코드입니다. Cloud 이벤트란 클라우드 환경에서 발생하는 모든 상황을 의미합니다. 데이터베이스의 데이터 변경, 스토리지 시스템에 파일 추가, 새로운 가상 머신 인스턴스의 생성 등이 그러한 예입니다.

Cloud Run functions는 이벤트 기반이므로 이벤트 발생 시에만 실행됩니다. 따라서 신속히 완료되어야 하거나 상시 실행이 필요 없는 작업에 적합합니다.

이 실무형 실습에서는 Google Cloud SDK를 사용해 BigQuery 테이블을 로드하는 Cloud Run 함수를 만들고 배포하고 테스트하는 방법을 살펴봅니다.

실습할 내용

- Cloud Run 함수 만들기

- Cloud Run 함수 배포 및 테스트

- BigQuery 및 Cloud Run 함수 로그에서 데이터 보기

설정 및 요구사항

각 실습에서는 정해진 기간 동안 새 Google Cloud 프로젝트와 리소스 집합이 무료로 제공됩니다.

-

실습 시작 버튼을 클릭합니다. 실습 비용을 결제해야 하는 경우 결제 수단을 선택할 수 있는 팝업이 열립니다.

왼쪽에는 다음과 같은 항목이 포함된 실습 세부정보 패널이 있습니다.

-

Google Cloud 콘솔 열기 버튼

- 남은 시간

- 이 실습에 사용해야 하는 임시 사용자 인증 정보

- 필요한 경우 실습 진행을 위한 기타 정보

-

Google Cloud 콘솔 열기를 클릭합니다(Chrome 브라우저를 실행 중인 경우 마우스 오른쪽 버튼으로 클릭하고 시크릿 창에서 링크 열기를 선택합니다).

실습에서 리소스가 가동되면 다른 탭이 열리고 로그인 페이지가 표시됩니다.

팁: 두 개의 탭을 각각 별도의 창으로 나란히 정렬하세요.

참고: 계정 선택 대화상자가 표시되면 다른 계정 사용을 클릭합니다.

-

필요한 경우 아래의 사용자 이름을 복사하여 로그인 대화상자에 붙여넣습니다.

{{{user_0.username | "Username"}}}

실습 세부정보 패널에서도 사용자 이름을 확인할 수 있습니다.

-

다음을 클릭합니다.

-

아래의 비밀번호를 복사하여 시작하기 대화상자에 붙여넣습니다.

{{{user_0.password | "Password"}}}

실습 세부정보 패널에서도 비밀번호를 확인할 수 있습니다.

-

다음을 클릭합니다.

중요: 실습에서 제공하는 사용자 인증 정보를 사용해야 합니다. Google Cloud 계정 사용자 인증 정보를 사용하지 마세요.

참고: 이 실습에 자신의 Google Cloud 계정을 사용하면 추가 요금이 발생할 수 있습니다.

-

이후에 표시되는 페이지를 클릭하여 넘깁니다.

- 이용약관에 동의합니다.

- 임시 계정이므로 복구 옵션이나 2단계 인증을 추가하지 않습니다.

- 무료 체험판을 신청하지 않습니다.

잠시 후 Google Cloud 콘솔이 이 탭에서 열립니다.

참고: Google Cloud 제품 및 서비스 목록이 있는 메뉴를 보려면 왼쪽 상단의 탐색 메뉴를 클릭하거나 검색창에 제품 또는 서비스 이름을 입력합니다.

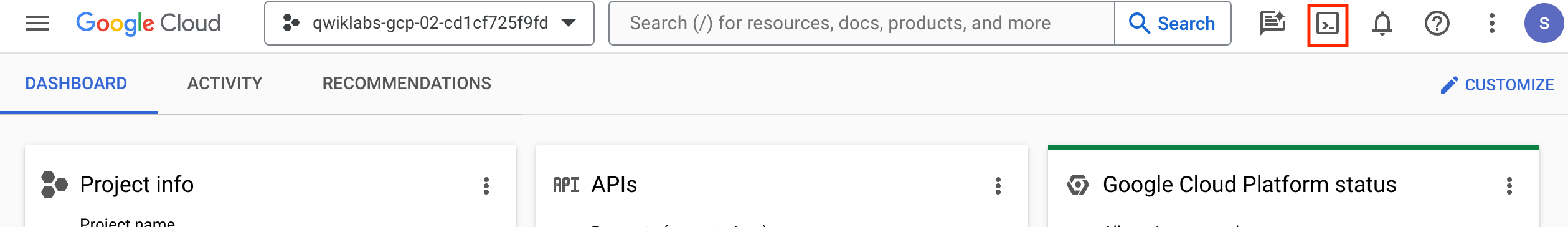

Google Cloud Shell 활성화하기

Google Cloud Shell은 다양한 개발 도구가 탑재된 가상 머신으로, 5GB의 영구 홈 디렉터리를 제공하며 Google Cloud에서 실행됩니다.

Google Cloud Shell을 사용하면 명령줄을 통해 Google Cloud 리소스에 액세스할 수 있습니다.

-

Cloud 콘솔의 오른쪽 상단 툴바에서 'Cloud Shell 열기' 버튼을 클릭합니다.

-

계속을 클릭합니다.

환경을 프로비저닝하고 연결하는 데 몇 분 정도 소요됩니다. 연결되면 사용자가 미리 인증되어 프로젝트가 PROJECT_ID로 설정됩니다. 예:

gcloud는 Google Cloud의 명령줄 도구입니다. Cloud Shell에 사전 설치되어 있으며 명령줄 자동 완성을 지원합니다.

- 다음 명령어를 사용하여 사용 중인 계정 이름을 나열할 수 있습니다.

gcloud auth list

출력:

Credentialed accounts:

- @.com (active)

출력 예시:

Credentialed accounts:

- google1623327_student@qwiklabs.net

- 다음 명령어를 사용하여 프로젝트 ID를 나열할 수 있습니다.

gcloud config list project

출력:

[core]

project =

출력 예시:

[core]

project = qwiklabs-gcp-44776a13dea667a6

참고:

gcloud 전체 문서는 gcloud CLI 개요 가이드를 참조하세요.

작업 1. API 사용 설정

이 작업에서는 Cloud Run 함수를 만들기 전에 관련 API를 사용 설정합니다.

- Cloud Shell에서 다음 명령어를 실행하여 프로젝트 ID 변수를 설정합니다.

export PROJECT_ID=$(gcloud config get-value project)

- 다음 명령어를 실행하여 Region 변수를 설정합니다.

export REGION={{{project_0.default_region | "REGION"}}}

gcloud config set compute/region $REGION

- 다음 명령어를 실행하여 구성 변수를 설정합니다.

gcloud config set run/region $REGION

gcloud config set run/platform managed

gcloud config set eventarc/location $REGION

- 다음 명령어를 실행하여 필요한 모든 서비스를 사용 설정합니다.

gcloud services enable \

artifactregistry.googleapis.com \

cloudfunctions.googleapis.com \

cloudbuild.googleapis.com \

eventarc.googleapis.com \

run.googleapis.com \

logging.googleapis.com \

pubsub.googleapis.com

참고: Eventarc의 경우 모든 권한이 서비스 에이전트에 전파되는 데 몇 분 정도 걸릴 수 있습니다.

작업 2. 필수 권한 설정

이 작업에서는 기본 Compute Engine 서비스 계정에 Eventarc 이벤트를 수신할 수 있는 권한을 부여하고, Cloud Storage 서비스 에이전트에는 Pub/Sub 주제에 메시지를 게시할 수 있는 권한을 부여하여 이벤트 기반 워크플로와 스토리지로 트리거되는 작업을 지원합니다.

- Cloud Shell에서 다음 명령어를 실행하여 PROJECT_NUMBER 변수를 설정합니다.

export PROJECT_NUMBER=$(gcloud projects describe $PROJECT_ID --format='value(projectNumber)')

- 다음 명령어를 실행하여 프로젝트 내의 기본 Compute Engine 서비스 계정에 Eventarc에서 이벤트를 수신하는 데 필요한 권한을 부여합니다.

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:$PROJECT_NUMBER-compute@developer.gserviceaccount.com" \

--role="roles/eventarc.eventReceiver"

- 다음 명령어를 실행하여 프로젝트의 Cloud Storage 서비스 에이전트를 가져오고 Pub/Sub 주제에 메시지를 게시할 수 있는 권한을 부여합니다.

SERVICE_ACCOUNT="$(gcloud storage service-agent --project=$PROJECT_ID)"

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member="serviceAccount:${SERVICE_ACCOUNT}" \

--role='roles/pubsub.publisher'

작업 3. 함수 만들기

이 작업에서는 loadBigQueryFromAvro라는 간단한 함수를 만듭니다. 이 함수는 Cloud Storage에 업로드되는 Avro 파일을 읽은 후 테이블을 만들어 BigQuery에 로드합니다.

- Cloud Shell에서 다음 명령어를 실행하여

index.js라는 이름의 파일을 만들고 엽니다.

nano index.js

- Cloud 함수에 대한 다음 코드를

index.js 파일에 복사합니다.

/**

* index.js Cloud Function - Avro on GCS to BQ

*/

const {Storage} = require('@google-cloud/storage');

const {BigQuery} = require('@google-cloud/bigquery');

const storage = new Storage();

const bigquery = new BigQuery();

exports.loadBigQueryFromAvro = async (event, context) => {

try {

// Check for valid event data and extract bucket name

if (!event || !event.bucket) {

throw new Error('Invalid event data. Missing bucket information.');

}

const bucketName = event.bucket;

const fileName = event.name;

// BigQuery configuration

const datasetId = 'loadavro';

const tableId = fileName.replace('.avro', '');

const options = {

sourceFormat: 'AVRO',

autodetect: true,

createDisposition: 'CREATE_IF_NEEDED',

writeDisposition: 'WRITE_TRUNCATE',

};

// Load job configuration

const loadJob = bigquery

.dataset(datasetId)

.table(tableId)

.load(storage.bucket(bucketName).file(fileName), options);

await loadJob;

console.log(`Job ${loadJob.id} completed. Created table ${tableId}.`);

} catch (error) {

console.error('Error loading data into BigQuery:', error);

throw error;

}

};

- nano에서 (Ctrl+x)를 누른 다음 (Y)를 누르고 Enter를 눌러 파일을 저장합니다.

함수 만들기

작업 4. Cloud Storage 버킷 및 BigQuery 데이터 세트 만들기

이 작업에서는 Cloud Run 함수를 호출하는 데 사용되는 애셋을 저장할 백그라운드 인프라(Cloud Storage 버킷)를 설정하고, 완료되면 출력을 BigQuery에 저장합니다.

- Cloud Shell에서 다음 명령어를 실행하여 스테이징 위치로 사용할 새 Cloud Storage 버킷을 만듭니다.

gcloud storage buckets create gs://$PROJECT_ID --location=$REGION

- 다음 명령어를 실행하여 데이터를 저장할 BigQuery 데이터 세트를 만듭니다.

bq mk -d loadavro

Cloud Storage 버킷 및 BigQuery 데이터 세트 만들기

작업 5. 함수 배포하기

이 작업에서는 새 Cloud Run 함수를 배포하고 데이터가 BigQuery에 로드되도록 트리거합니다.

- Cloud Shell에서 다음 명령어를 실행하여, Cloud Storage에서 읽고 BigQuery에 출력을 저장하는 JavaScript 라이브러리 2개를 설치합니다.

npm install @google-cloud/storage @google-cloud/bigquery

- 다음 명령어를 실행하여 함수를 배포합니다.

gcloud functions deploy loadBigQueryFromAvro \

--gen2 \

--runtime nodejs20 \

--source . \

--region $REGION \

--trigger-resource gs://$PROJECT_ID \

--trigger-event google.storage.object.finalize \

--memory=512Mi \

--timeout=540s \

--service-account=$PROJECT_NUMBER-compute@developer.gserviceaccount.com

참고: Eventarc 서비스 에이전트 전파와 관련된 오류 메시지가 표시되면 몇 분 정도 기다렸다가 명령어를 다시 실행합니다.

- 다음 명령어를 실행하여 트리거가 성공적으로 생성되었는지 확인합니다. 출력은 다음과 비슷하게 표시됩니다.

gcloud eventarc triggers list --location=$REGION

NAME: loadbigqueryfromavro-177311

TYPE: google.cloud.storage.object.v1.finalized

DESTINATION: Cloud Functions: loadBigQueryFromAvro

ACTIVE: Yes

LOCATION: europe-west1

- 다음 명령어를 실행하여 Avro 파일을 다운로드합니다. Cloud Run 함수에서 이 파일을 처리하여 BigQuery에 저장합니다.

wget https://storage.googleapis.com/cloud-training/dataengineering/lab_assets/idegc/campaigns.avro

- 다음 명령어를 실행하여 Avro 파일을 앞서 만든 스테이징 Cloud Storage 버킷으로 이동합니다. 이 작업으로 Cloud Run 함수가 트리거됩니다.

gcloud storage cp campaigns.avro gs://{{{project_0.project_id |PROJECT_ID}}}

함수 배포하기

작업 6. 데이터가 BigQuery에 로드되었는지 확인

이 작업에서는 bq 명령어를 사용하여 loadavro.campaigns 테이블을 쿼리하고 Cloud Run 함수에서 처리된 데이터가 BigQuery에 성공적으로 로드되었는지 확인합니다.

-

bq 명령어를 사용하여 BigQuery의 새 테이블에서 데이터를 확인하려면 Cloud Shell에서 다음 명령어를 실행합니다.

bq query \

--use_legacy_sql=false \

'SELECT * FROM `loadavro.campaigns`;'

참고: Cloud Run 함수는 일반적으로 빠르게 처리되지만 BigQuery에 대한 쿼리 실행 결과가 반환되지 않을 수 있습니다. 이러한 경우 잠시 기다렸다가 다시 쿼리를 실행하세요.

쿼리는 다음과 유사한 결과를 반환해야 합니다.

출력 예시:

+------------+--------+---------------------+--------+---------------------+----------+-----+

| created_at | period | campaign_name | amount | advertising_channel | bid_type | id |

+------------+--------+---------------------+--------+---------------------+----------+-----+

| 2020-09-17 | 90 | NA - Video - Other | 41 | Video | CPC | 81 |

| 2021-01-19 | 30 | NA - Video - Promo | 325 | Video | CPC | 137 |

| 2021-06-28 | 30 | NA - Video - Promo | 78 | Video | CPC | 214 |

| 2021-03-15 | 30 | EU - Search - Brand | 465 | Search | CPC | 170 |

| 2022-01-01 | 30 | EU - Search - Brand | 83 | Search | CPC | 276 |

| 2020-02-18 | 30 | EU - Search - Brand | 30 | Search | CPC | 25 |

| 2021-06-08 | 30 | EU - Search - Brand | 172 | Search | CPC | 201 |

| 2020-11-29 | 60 | EU - Search - Other | 83 | Search | CPC | 115 |

| 2021-09-11 | 30 | EU - Search - Other | 86 | Search | CPC | 237 |

| 2022-02-17 | 30 | EU - Search - Other | 64 | Search | CPC | 296 |

+------------+--------+---------------------+--------+---------------------+----------+-----+

작업 7. 로그 보기

이 작업에서는 loadBigQueryFromAvro라는 서비스와 연결된 모든 로그 항목을 검색합니다.

- Cloud Shell에서 다음 명령어를 실행하여 Cloud Run 함수의 로그를 검토합니다.

gcloud logging read "resource.labels.service_name=loadBigQueryFromAvro"

로그의 메시지는 다음과 비슷하게 표시됩니다.

resource:

labels:

configuration_name: loadbigqueryfromavro

location: europe-west1

project_id: qwiklabs-gcp-04-16fde64676e4

revision_name: loadbigqueryfromavro-00001-wim

service_name: loadbigqueryfromavro

type: cloud_run_revision

spanId: '5804952652695382607'

textPayload: |

Job undefined completed. Created table campaigns.

timestamp: '2025-03-10T17:24:43.560594Z'

수고하셨습니다

Google Cloud SDK를 사용해 BigQuery 테이블을 생성 및 로드하는 Cloud Run 함수를 만들고 배포하고 테스트했습니다.

Copyright 2026 Google LLC All rights reserved. Google 및 Google 로고는 Google LLC의 상표입니다. 기타 모든 회사명 및 제품명은 해당 업체의 상표일 수 있습니다.