GSP1096

Visão geral

Neste laboratório, você vai aprender na prática como implantar e combinar o SingleStoreDB com produtos nativos da nuvem do Google Cloud, como o Pub/Sub, o Dataflow e o Cloud Storage. Para demonstrar os recursos do produto, você vai trabalhar com o conjunto de dados público de táxis de Nova York.

Você vai começar o fluxo do laboratório com a implantação do SingleStoreDB pelo navegador local e a criação do esquema apropriado. Em seguida, você vai usar o Pub/Sub para enviar dados ao Cloud Storage em tempo real com a ajuda do Dataflow. Para consumir os dados gerados e armazenados no armazenamento de objetos, você vai usar o pipeline nativo do SingleStoreDB. Depois que o SingleStoreDB ingerir os dados, você vai executar consultas e interagir com ele.

O que você vai aprender

Neste laboratório, você vai aprender a fazer o seguinte:

- Fazer login e navegar no Google Cloud.

- Criar uma instância/cluster do SingleStoreDB.

- Usar o Cloud Shell para se conectar e criar um esquema no SingleStoreDB.

- Criar tópicos e assinaturas do Pub/Sub, além de enviar e receber dados de outros serviços.

- Criar um job de streaming do Dataflow.

- Usar o pipeline nativo do SingleStore para carregar dados do armazenamento de objetos.

- Executar consultas e interagir com os dados no SingleStore.

Pré-requisitos

Você vai precisar de acesso a uma conta de e-mail pessoal para responder a um e-mail de verificação que será enviado pelo SingleStore. Esse e-mail pessoal também vai ser necessário para responder a um código de verificação durante o laboratório.

Embora seja útil ter familiaridade com o Google Cloud e o SingleStore, isso não é obrigatório.

Configuração e requisitos

Antes de clicar no botão Começar o Laboratório

Leia estas instruções. Os laboratórios são cronometrados e não podem ser pausados. O timer é ativado quando você clica em Iniciar laboratório e mostra por quanto tempo os recursos do Google Cloud vão ficar disponíveis.

Este laboratório prático permite que você realize as atividades em um ambiente real de nuvem, e não em uma simulação ou demonstração. Você vai receber novas credenciais temporárias para fazer login e acessar o Google Cloud durante o laboratório.

Confira os requisitos para concluir o laboratório:

- Acesso a um navegador de Internet padrão (recomendamos o Chrome).

Observação: para executar este laboratório, use o modo de navegação anônima (recomendado) ou uma janela anônima do navegador. Isso evita conflitos entre sua conta pessoal e de estudante, o que poderia causar cobranças extras na sua conta pessoal.

- Tempo para concluir o laboratório: não se esqueça que, depois de começar, não será possível pausar o laboratório.

Observação: use apenas a conta de estudante neste laboratório. Se usar outra conta do Google Cloud, você poderá receber cobranças nela.

Como iniciar seu laboratório e fazer login no console do Google Cloud

-

Clique no botão Começar o laboratório. Se for preciso pagar por ele, uma caixa de diálogo vai aparecer para você selecionar a forma de pagamento.

No painel Detalhes do Laboratório, à esquerda, você vai encontrar o seguinte:

- O botão Abrir Console do Google Cloud

- O tempo restante

- As credenciais temporárias que você vai usar neste laboratório

- Outras informações, se forem necessárias

-

Se você estiver usando o navegador Chrome, clique em Abrir console do Google Cloud ou clique com o botão direito do mouse e selecione Abrir link em uma janela anônima.

O laboratório ativa os recursos e depois abre a página Fazer Login em outra guia.

Dica: coloque as guias em janelas separadas lado a lado.

Observação: se aparecer a caixa de diálogo Escolher uma conta, clique em Usar outra conta.

-

Se necessário, copie o Nome de usuário abaixo e cole na caixa de diálogo Fazer login.

{{{user_0.username | "Username"}}}

Você também encontra o nome de usuário no painel Detalhes do Laboratório.

-

Clique em Próxima.

-

Copie a Senha abaixo e cole na caixa de diálogo de Olá.

{{{user_0.password | "Password"}}}

Você também encontra a senha no painel Detalhes do Laboratório.

-

Clique em Próxima.

Importante: você precisa usar as credenciais fornecidas no laboratório, e não as da sua conta do Google Cloud.

Observação: se você usar sua própria conta do Google Cloud neste laboratório, é possível que receba cobranças adicionais.

-

Acesse as próximas páginas:

- Aceite os Termos e Condições.

- Não adicione opções de recuperação nem autenticação de dois fatores (porque essa é uma conta temporária).

- Não se inscreva em testes gratuitos.

Depois de alguns instantes, o console do Google Cloud será aberto nesta guia.

Observação: para acessar os produtos e serviços do Google Cloud, clique no Menu de navegação ou digite o nome do serviço ou produto no campo Pesquisar.

Tarefa 1: iniciar seu próprio cluster do SingleStore

Para essa etapa, você já deve ter feito login no console do Google Cloud usando uma janela anônima.

- Em outra guia dessa janela anônima, acesse o portal do SingleStore. A página abaixo deve aparecer:

- Clique em Inscrever-se e insira seus dados.

- Em Endereço de e-mail empresarial, digite seu e-mail pessoal.

- Clique em Continuar.

- Insira uma senha exclusiva e clique em Continuar para fazer login no SingleStore.

- Insira o código de verificação recebido no endereço de e-mail e clique em Enviar.

- Marque a caixa de seleção Termos de Serviço + Política de Privacidade e clique em Continuar.

- Na tela Sobre o projeto, selecione uma das opções e clique em Avançar.

- Clique em Ver minha implantação para acessar o portal do cliente do SingleStore.

- Clique em Começar a usar o SingleStore quando a mensagem Seu espaço de trabalho inicial sem custos está pronto! for exibida.

Criar o espaço de trabalho

-

No canto superior esquerdo, clique em + Criar e selecione Implantação.

-

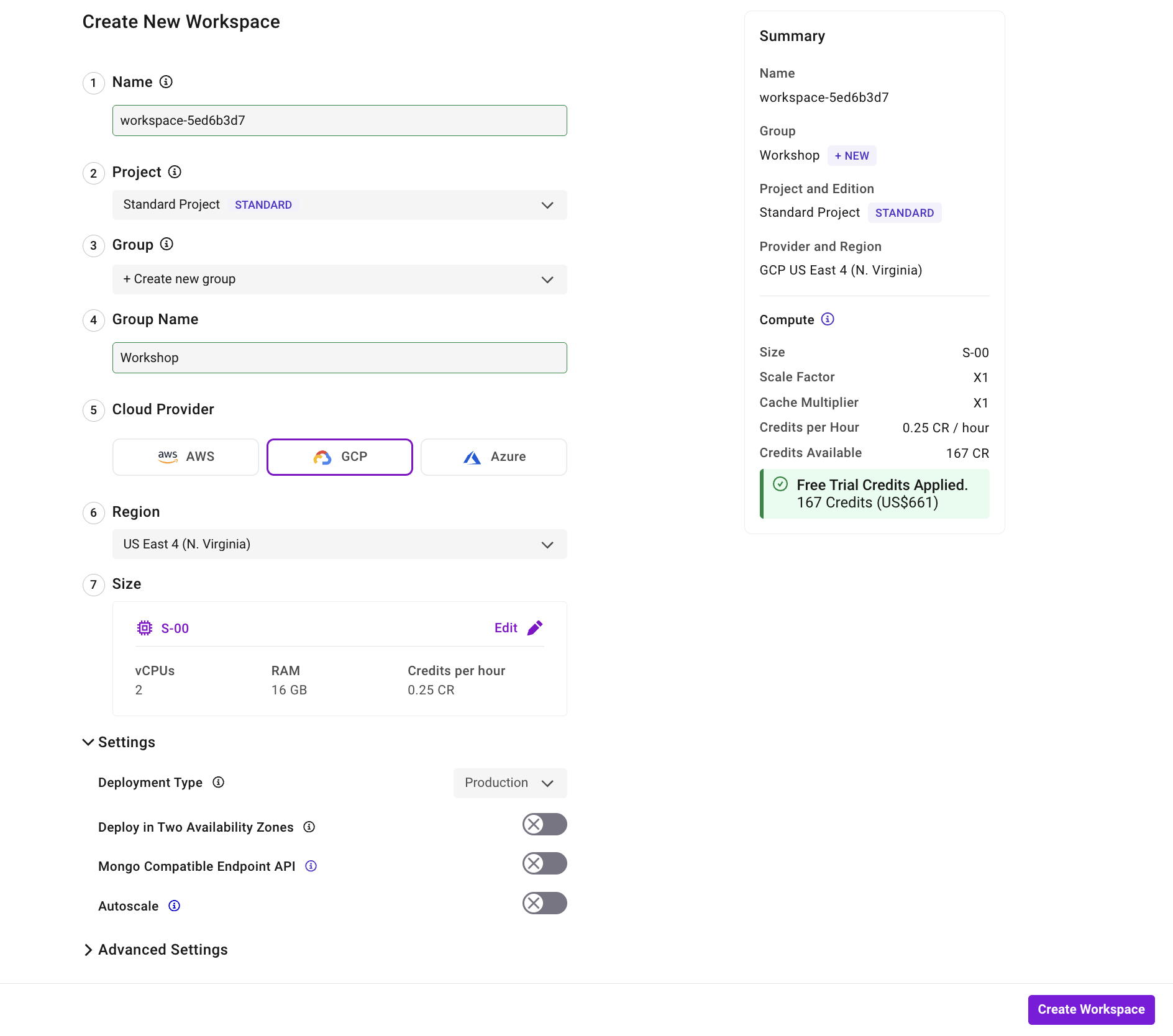

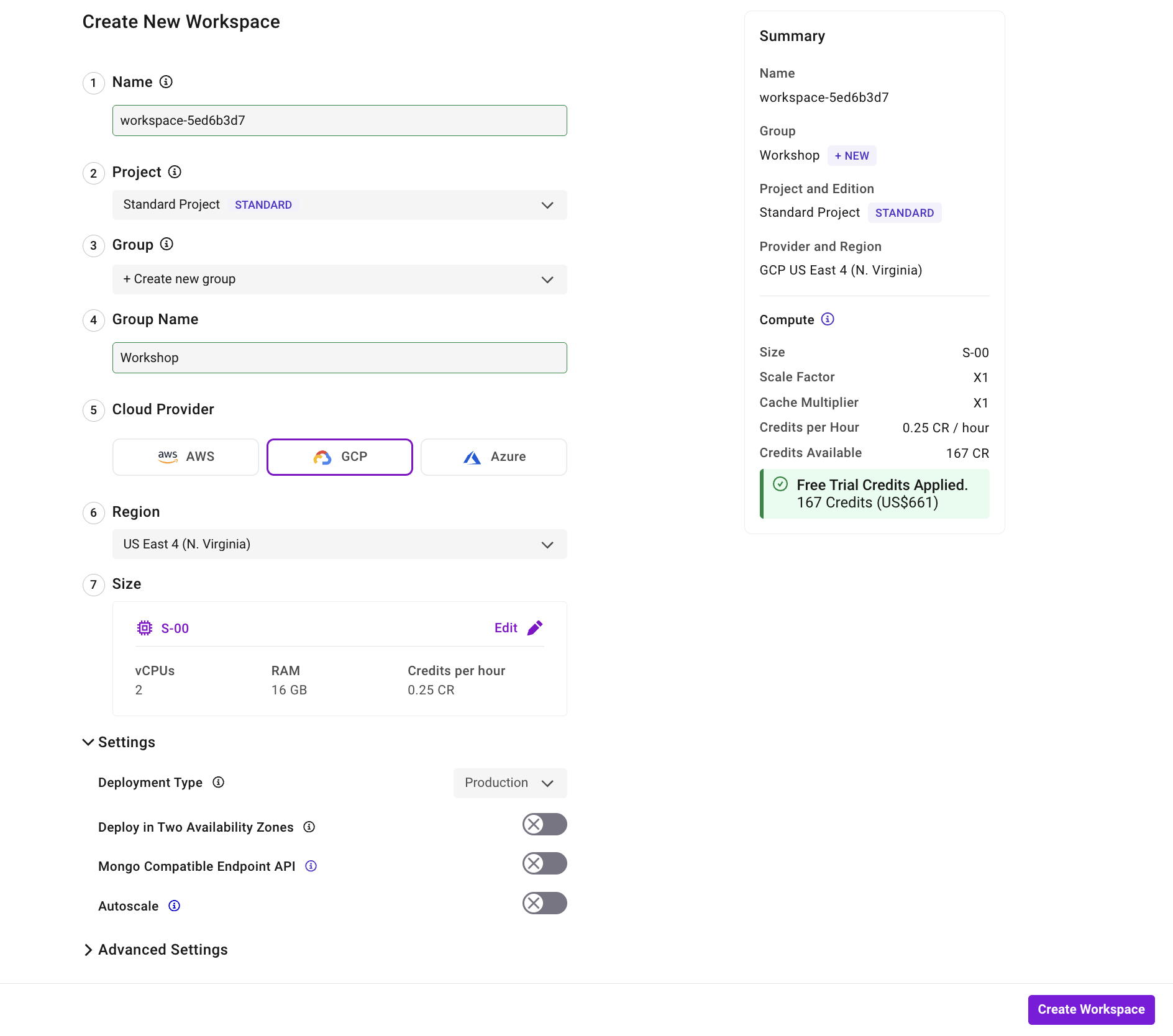

Na página Criar espaço de trabalho, configure o seguinte:

- Nome do grupo do espaço de trabalho: Workshop.

- Provedor de nuvem: GCP.

- Região: Leste dos EUA 4 (Norte da Virgínia). Essa é a região padrão. Se ela não estiver selecionada, faça a mudança.

A configuração precisa ficar assim:

-

Clique em Avançar.

-

Na página Detalhes do espaço de trabalho, mantenha as configurações padrão e clique em Criar espaço de trabalho.

Aguarde alguns minutos até que o espaço de trabalho seja ativado. Ele vai gerar um banco de dados de exemplo que você não vai usar neste laboratório.

Tarefa 2: conectar-se ao SingleStore e ao Google Cloud

-

Antes de se conectar ao espaço de trabalho do SingleStore, volte ao console do Google Cloud.

-

Abra uma nova janela do Cloud Shell. Para isso, clique no ícone Ativar Cloud Shell ( ) no canto superior direito do console. Se for solicitado, clique em Continuar e em Autorizar.

) no canto superior direito do console. Se for solicitado, clique em Continuar e em Autorizar.

-

No Cloud Shell, execute os comandos a seguir para clonar o repositório do GitHub e fazer o download do código do workshop.

git clone https://github.com/mlochbihler/singlestore-gcp-looker-devday-01

cd singlestore-gcp-looker-devday-01/section_b

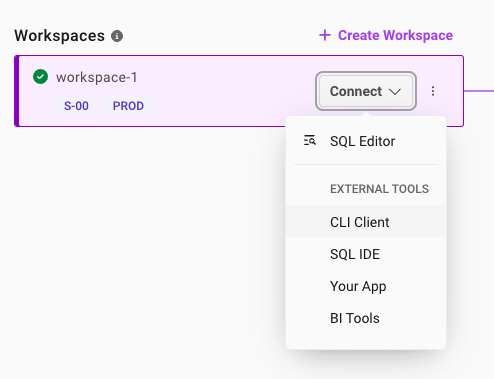

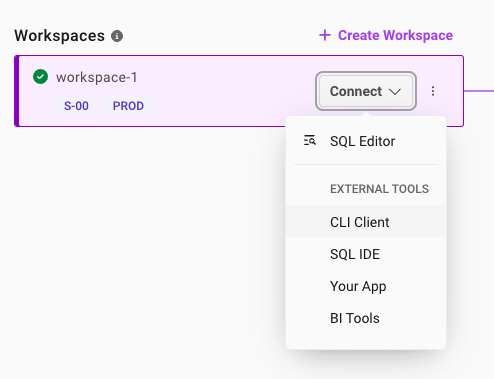

- Volte ao portal do SingleStore. Depois que o espaço de trabalho for inicializado, clique no menu suspenso ao lado de Conectar e selecione Cliente da CLI.

-

Na página Conectar-se ao espaço de trabalho, copie a senha gerada para você. Haverá um ícone de cópia ao lado dela. Como você vai precisar dessa senha mais tarde no laboratório, é uma boa ideia armazená-la em um arquivo local.

-

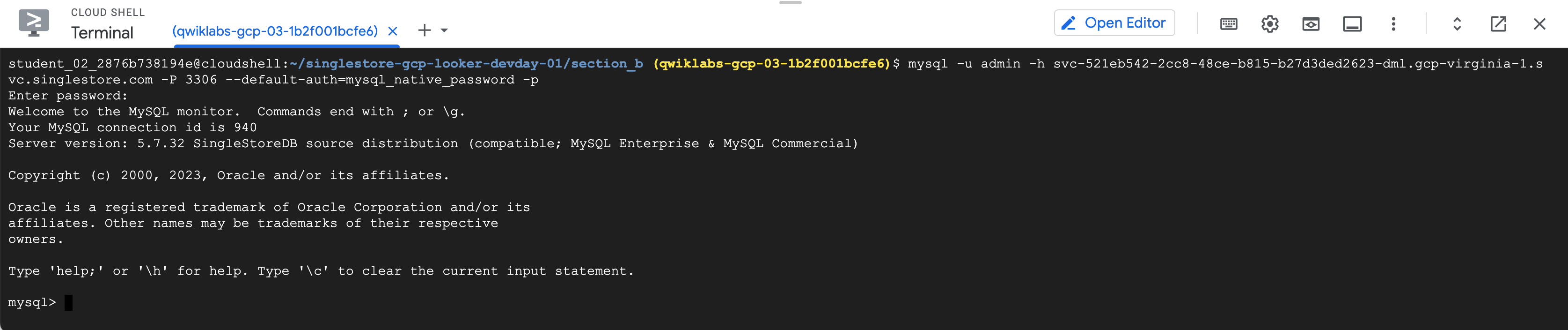

Clique no ícone Copiar à direita do comando MySQL. Ao fazer isso, o comando será copiado para a área de transferência.

O comando MySQL deve ser parecido com o seguinte: mysql -u admin -h svc-b675ae2f-b129-4baf-86ca-0a03c2c31d19-dml.gcp-virginia-1.svc.singlestore.com -P 3306 --default-auth=mysql_native_password --password

Observação:

a senha que você acabou de criar pode aparecer no comando MySQL acima. Isso só acontece na primeira vez que você abre essa janela. Depois disso, ela não é mais mostrada. É por isso que você deve salvar essa senha.

Se por algum motivo você não conseguir se conectar ao SingleStoreDB, redefina a senha. Para isso, navegue até a guia Acesso e clique em Redefinir.

-

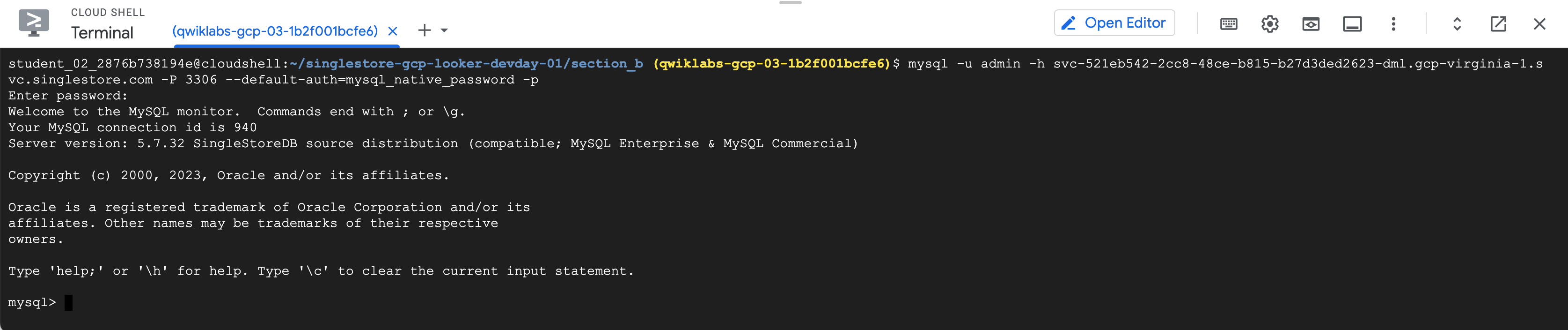

Volte ao console do Google Cloud e à instância do Cloud Shell.

-

Cole o comando MySQL no terminal.

-

Se solicitado, digite a senha que você copiou anteriormente. Agora, você vai acessar o comando mysql>.

Observação:

se a implantação parar de responder aos comandos MySQL, verifique o estado do espaço de trabalho no SingleStore. Ele está configurado para pausar ao ficar inativo por mais de 20 minutos. Nesse caso, você vai notar um botão Retomar. Clique nele para retomar as operações. Isso deve levar alguns minutos.

Tarefa 3: criar o esquema e interagir com o SingleStore

Nesta seção, você vai criar os esquemas de tabela.

Use a DDL a seguir para criar um banco de dados chamado nyc_taxi.

- No comando mysql>, execute este código:

source create_nyctaxi_tables.ddl;

use nyc_taxi; show tables;

Os resultados serão semelhantes ao seguinte:

Saída:

Database changed

+--------------------+

| Tables_in_nyc_taxi |

+--------------------+

| avgcost |

| avgdist |

| avgriders |

| avgridetime |

| avgwait_driver |

| avgwait_passenger |

| drivers |

| nab_nyctaxi_scored |

| neighborhoods |

| trips |

| triptotals |

| triptotalsc |

+--------------------+

12 rows in set (0.05 sec)

Você criou o esquema e as tabelas do banco de dados estão listadas.

- Execute este comando:

select * from avgcost limit 5;

A saída dessa consulta é Empty set ou 0. Isso acontece porque você criou o esquema, mas a tabela ainda está vazia.

Faça uma pausa aqui. Você criou o banco de dados SingleStore e se conectou a ele. O esquema também está configurado, mas ainda não há dados.

Se for possível, passe um tempo explorando o SingleStore.

Tarefa 4: analisar os dados no laboratório (opcional)

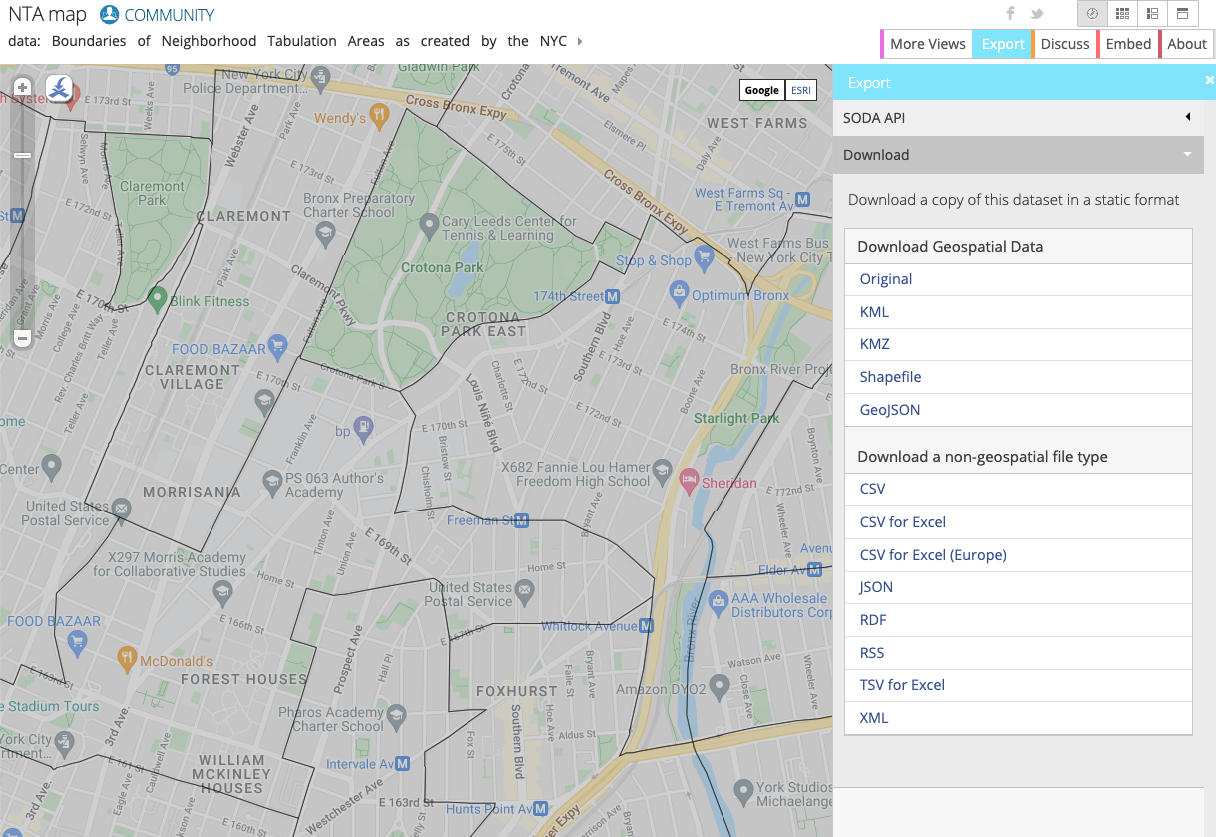

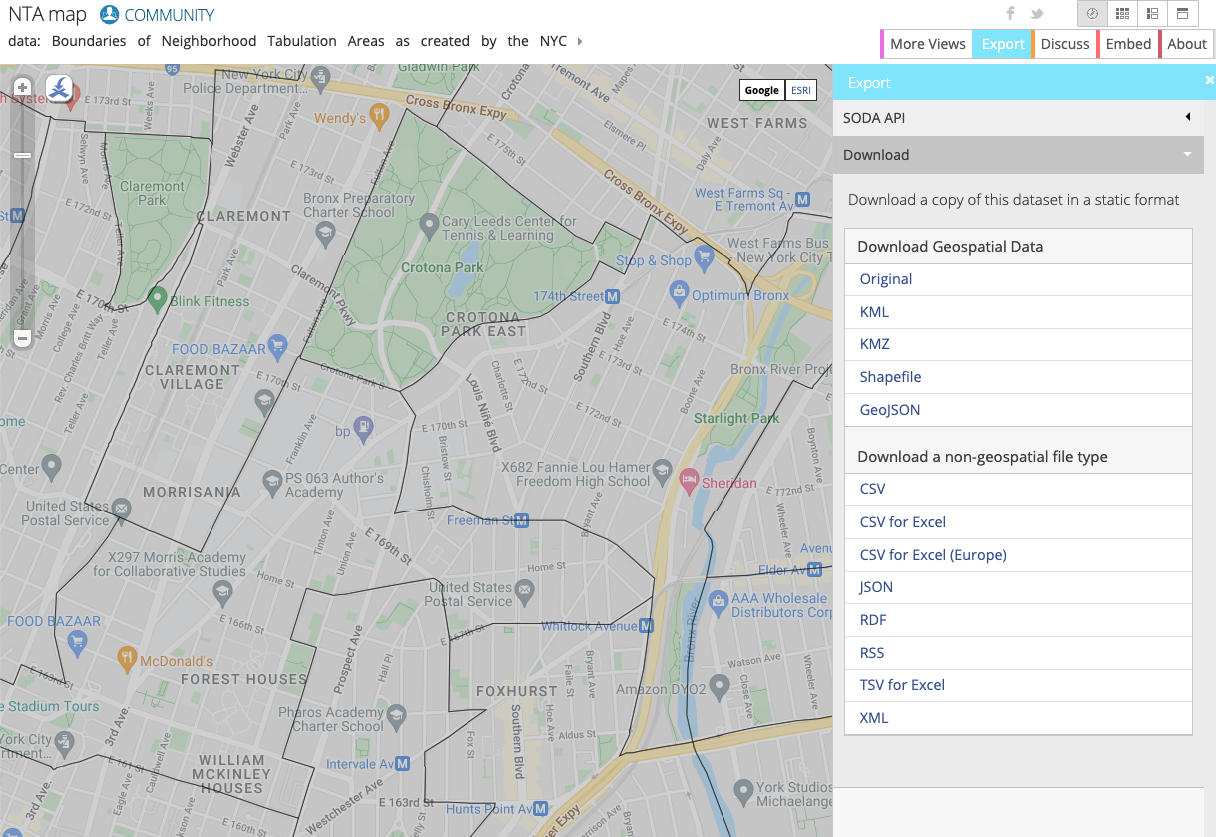

Neste laboratório, você vai usar os dados de táxi de Nova York, que podem ser encontrados nos conjuntos de dados públicos do BigQuery ou no site NYC Open Data.

Como esses dados já foram colocados em um bucket do Cloud Storage para você, não é necessário fazer o download deles ou importá-los para o Google Cloud. Se quiser, passe um tempo explorando esses dados.

O site NYC Open Data oferece conjuntos de dados sem custos relacionados à cidade de Nova York, incluindo dados de táxi, educação, polícia e muito mais.

Neste laboratório, você vai trabalhar com as áreas de tabulação de bairros (NTAs) do Departamento de Planejamento Urbano de Nova York, que fornecem informações sobre zonas e bairros aproximados na cidade. Você vai combinar essas informações com os dados de táxi de Nova York para descobrir onde os passageiros embarcaram e desembarcaram.

No site, é possível visualizar os dados por bairro:

Tarefa 5: configurar um bucket do Cloud Storage

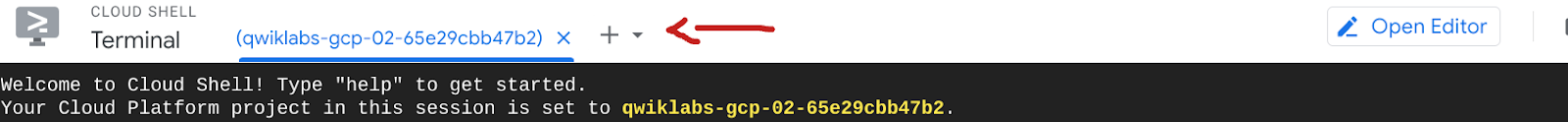

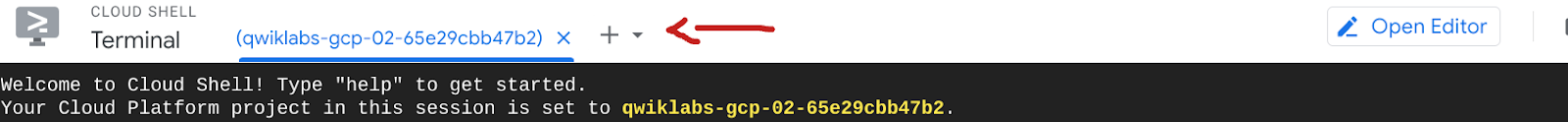

- Antes de começar esta seção, abra uma nova guia do terminal do Cloud Shell. Para isso, clique no botão +:

No Google Cloud, é possível configurar recursos usando principalmente a GUI e a CLI. Neste laboratório, você vai usar a CLI para criar o bucket e acessar os dados mais recentes de bairros no site de táxis de Nova York.

- Copie e execute os comandos abaixo para criar seu próprio bucket e importar para ele os dados de um bucket público:

gcloud storage buckets create gs://$GOOGLE_CLOUD_PROJECT --location={{{ project_0.default_region | "REGION" }}}

gcloud storage cp -r gs://configuring-singlestore-on-gcp/drivers gs://$GOOGLE_CLOUD_PROJECT

gcloud storage cp -r gs://configuring-singlestore-on-gcp/trips gs://$GOOGLE_CLOUD_PROJECT

gcloud storage cp gs://configuring-singlestore-on-gcp/neighborhoods.csv gs://$GOOGLE_CLOUD_PROJECT

Se for solicitado, clique em Autorizar.

Observe que já existe outro bucket criado no projeto. Não se preocupe com esse bucket. Ele é um local de armazenamento temporário/de preparo para o Dataflow.

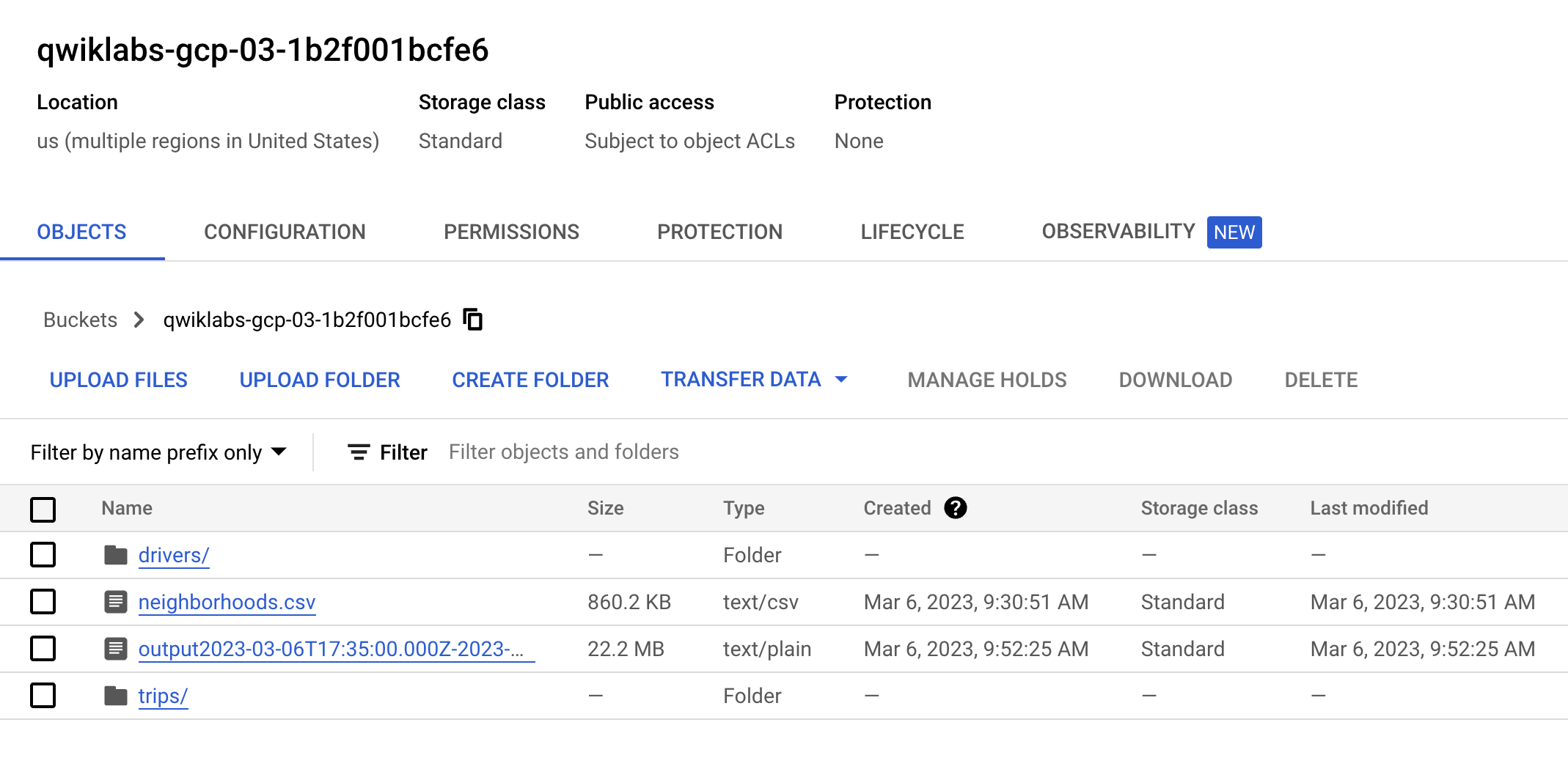

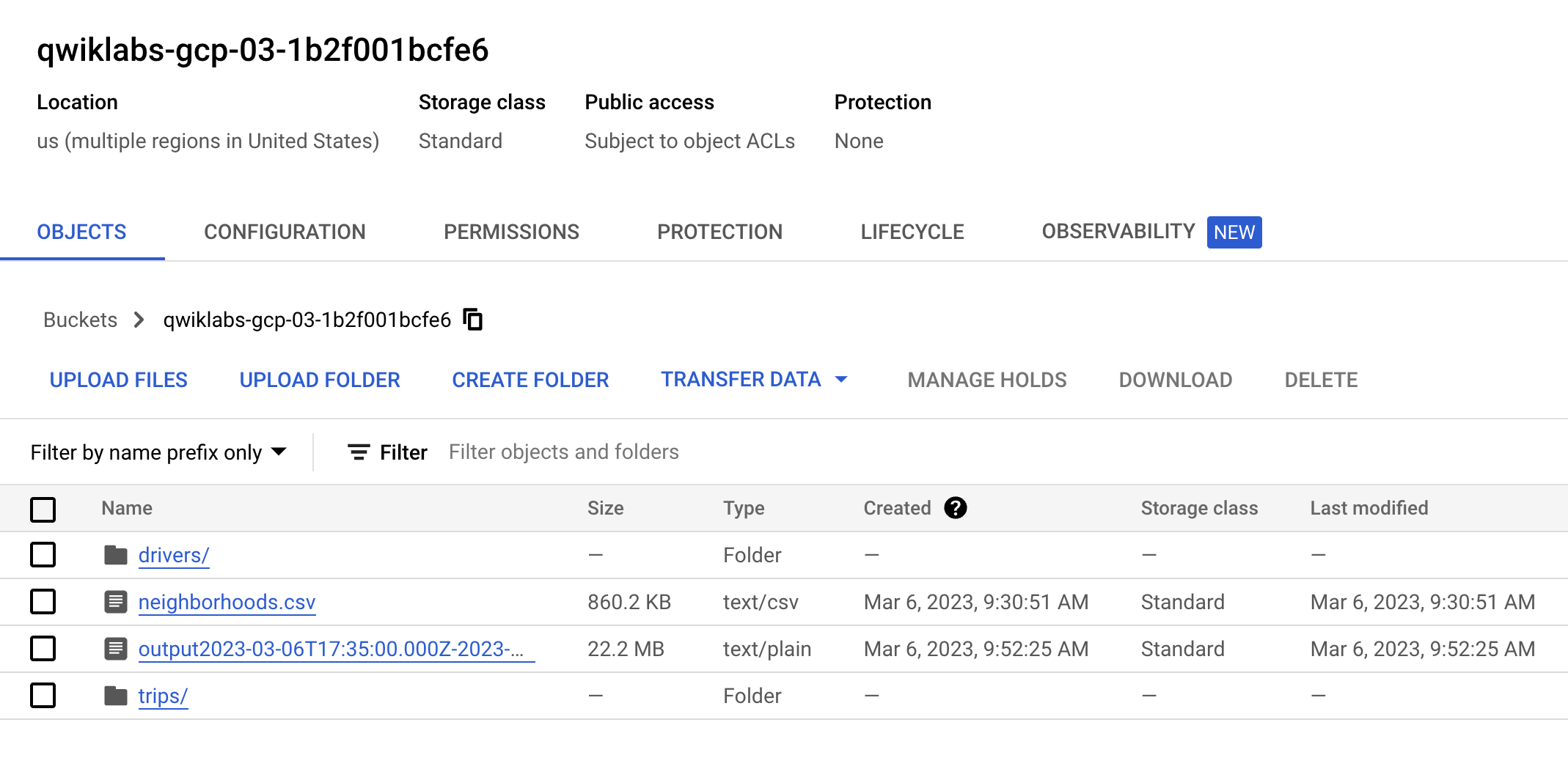

- Acesse Cloud Storage > Buckets, encontre seu bucket () e verifique se ele contém duas pastas e um arquivo CSV, que deve ser parecido com este:

Clique em Verificar meu progresso para conferir o objetivo.

Configurar o bucket do Cloud Storage

Tarefa 6: configurar o Pub/Sub e um job de streaming do Dataflow

Os recursos do Pub/Sub e do Dataflow já foram preenchidos no projeto. Para visualizá-los, use a caixa de pesquisa na parte de cima do console do Cloud para encontrar o Pub/Sub e o Dataflow, respectivamente.

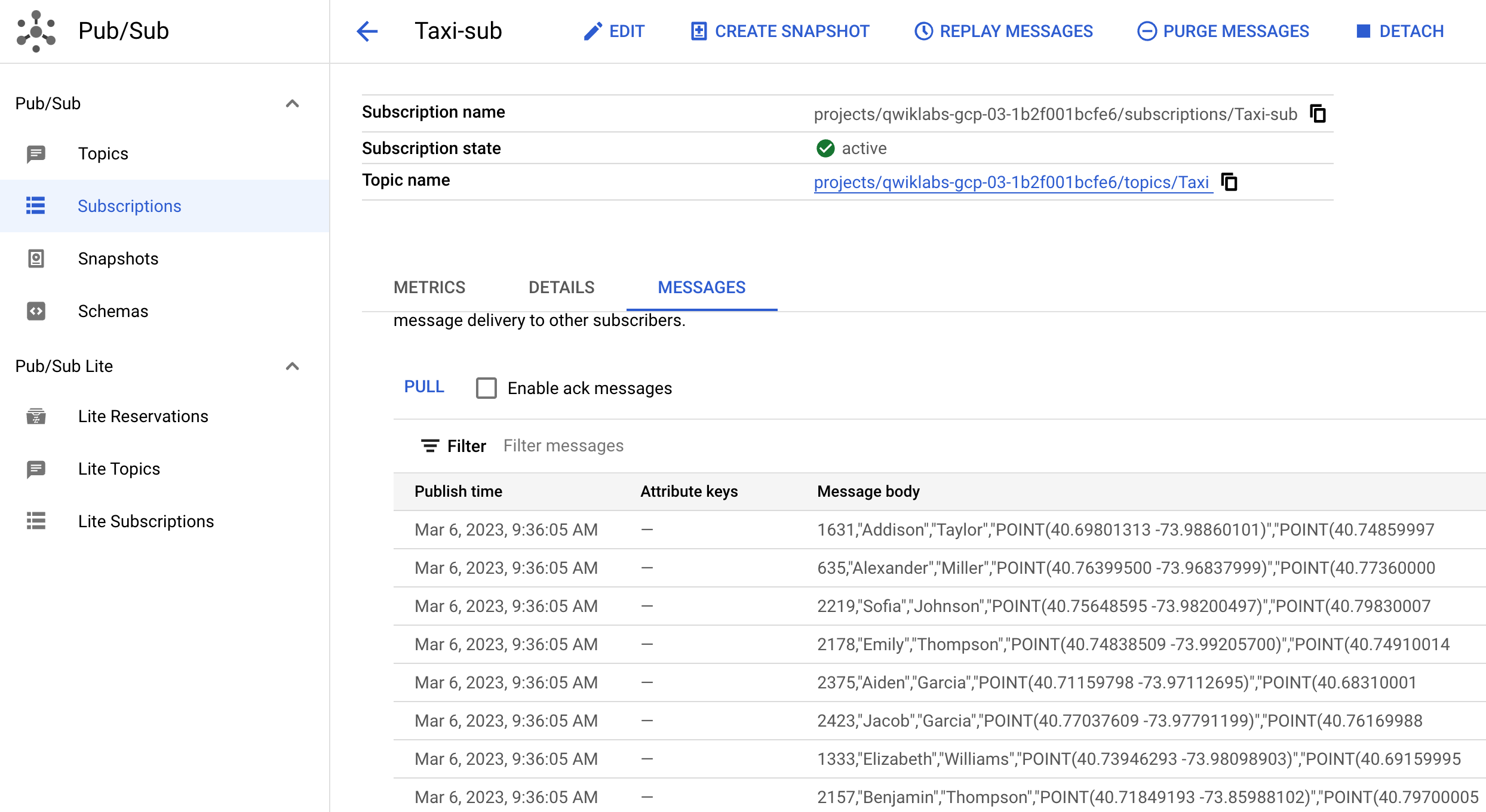

- Para o Pub/Sub, faça o seguinte:

- Verifique se há um tópico chamado Taxi.

- Verifique se há uma assinatura chamada Taxi-sub.

- Para o Dataflow, faça o seguinte:

- Verifique se há um job chamado GCStoPS com o status com falha.

-

Clique no job e em Clonar para executar esse job. Renomeie o job e verifique as informações dele (que você já preencheu durante a clonagem) para saber o que está sendo executado. Role para baixo e clique em Executar job.

-

Volte a Jobs do Dataflow e verifique se o status do job é Em execução.

Observação: pode levar de cinco a sete minutos para o job do Dataflow começar o streaming.

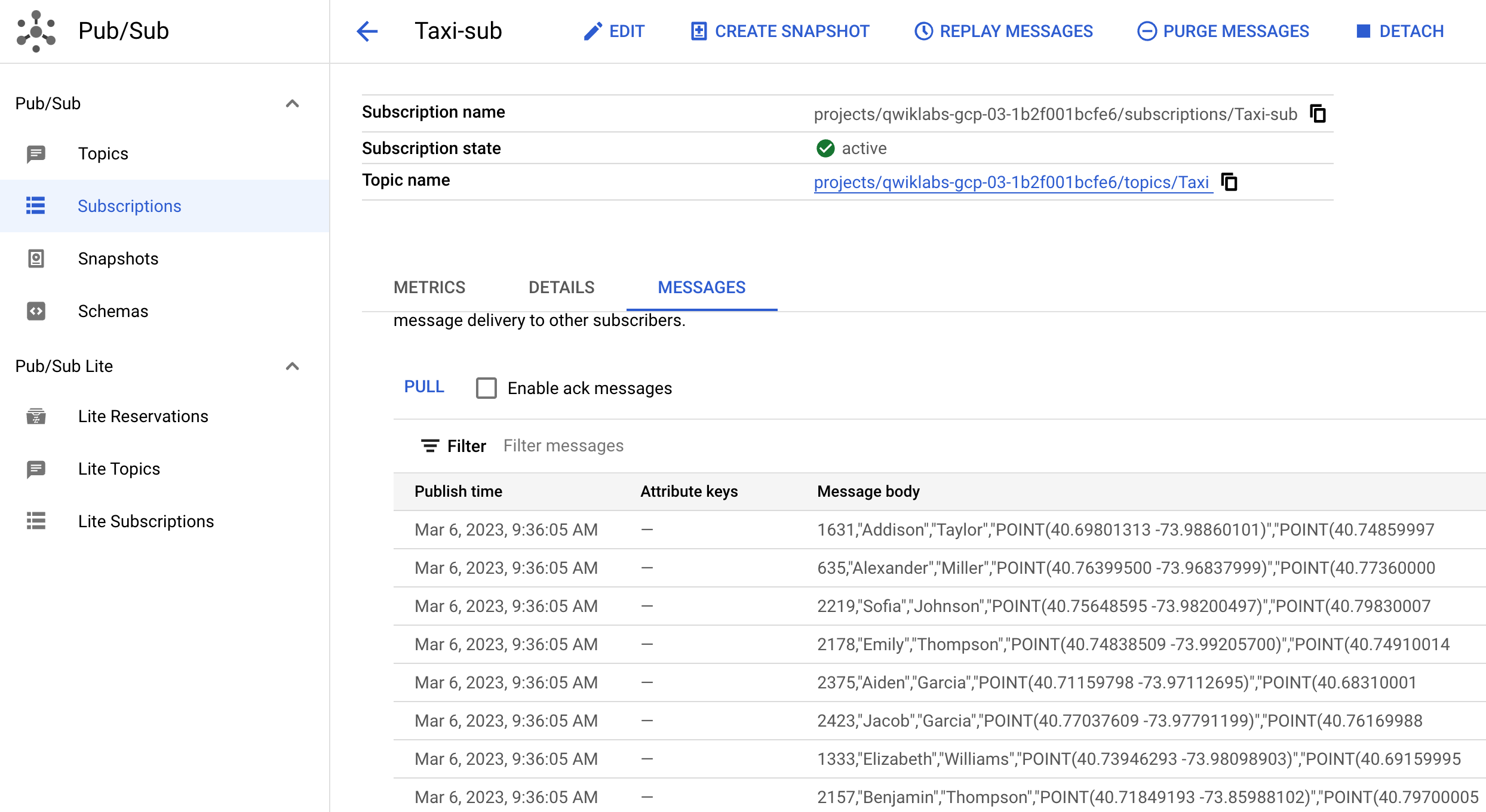

- Volte ao Pub/Sub, localize a assinatura Taxi-sub e clique em Mensagens e em Pull. As mensagens vão começar a chegar. Você vai ver algo parecido com isso:

Você simulou o streaming de dados em tempo real. Por exemplo, se você fizer upload de mais dados no GCS e os extrair no Pub/Sub, o Dataflow vai mover esses dados em tempo real.

Clique em Verificar meu progresso para conferir o objetivo.

Clonar o job do Dataflow

Tarefa 7: configurar uma arquitetura de streaming no Google Cloud

Uma arquitetura de streaming comum no Google Cloud consiste no seguinte: Pub/Sub > Dataflow > GCS. Nesta tarefa, você vai configurar essa arquitetura e conectar o SingleStore ao GCS.

-

Volte ao Dataflow.

-

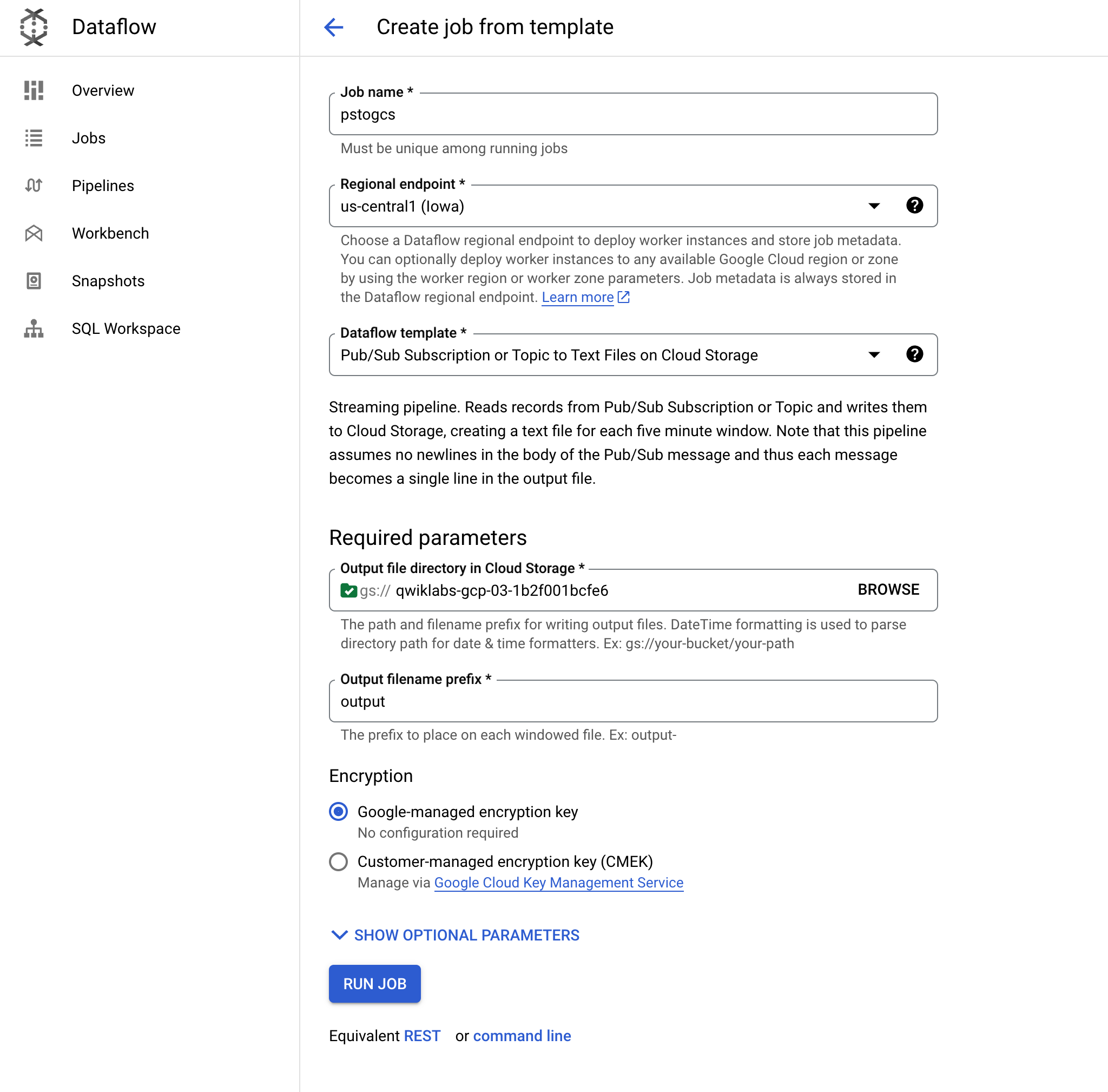

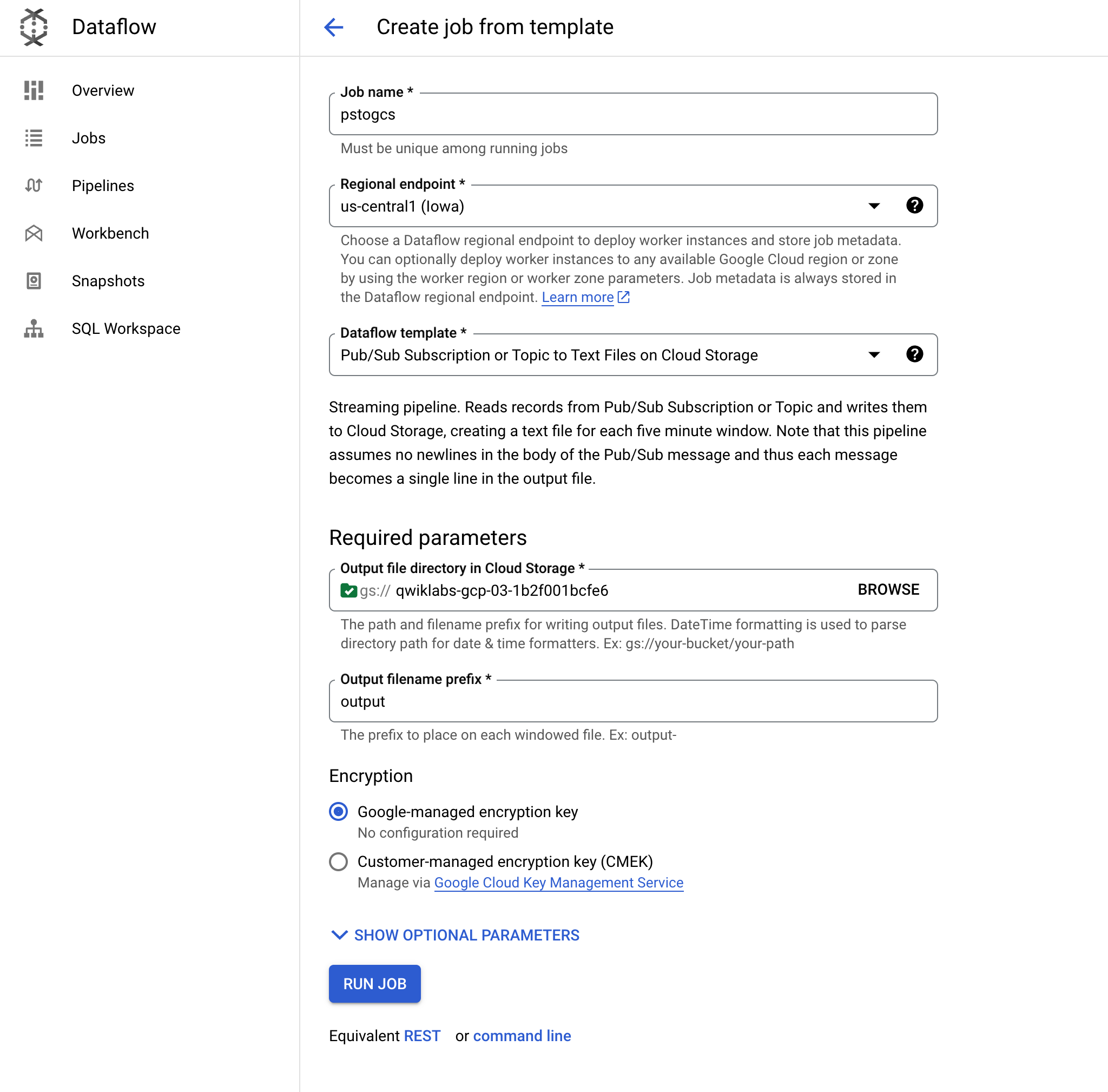

Clique em Criar job usando modelo e dê a ele o nome pstogcs (Pub/Sub para GCS).

-

Selecione como endpoint regional .

-

Selecione o seguinte modelo do Dataflow: Pub/Sub Subscription or Topic to Text Files on Cloud Storage. Como vão aparecer várias opções, aplique Filtrar para encontrar o que você quer.

-

Em Destino, clique em Procurar e selecione o bucket que você criou, chamado . O objetivo é que a saída do job seja colocada nesse bucket. Clique em Selecionar.

-

Mantenha o prefixo do nome do arquivo de saída como output. Isso ajuda a marcar com clareza os arquivos de saída.

-

Expanda Parâmetros de origem opcionais. Em Assinatura de entrada do Pub/Sub, selecione Taxi-sub, que é a assinatura em que as mensagens chegaram. Não é necessário incluir um tópico de entrada.

-

Mantenha os valores padrão para todo o restante, navegue até a parte de baixo da página e clique em EXECUTAR JOB.

Observação:

se você receber um erro ao tentar executar o job, verifique se os problemas estão nos campos de padrão personalizado para data e hora. Se esse for o caso, exclua os valores de todos esses campos e tente novamente.

Esse job do Dataflow deve ler as mensagens exibidas anteriormente no Pub/Sub e transmiti-las ao bucket do Cloud Storage.

Observação: pode levar de cinco a sete minutos para o job do Dataflow começar o streaming.

-

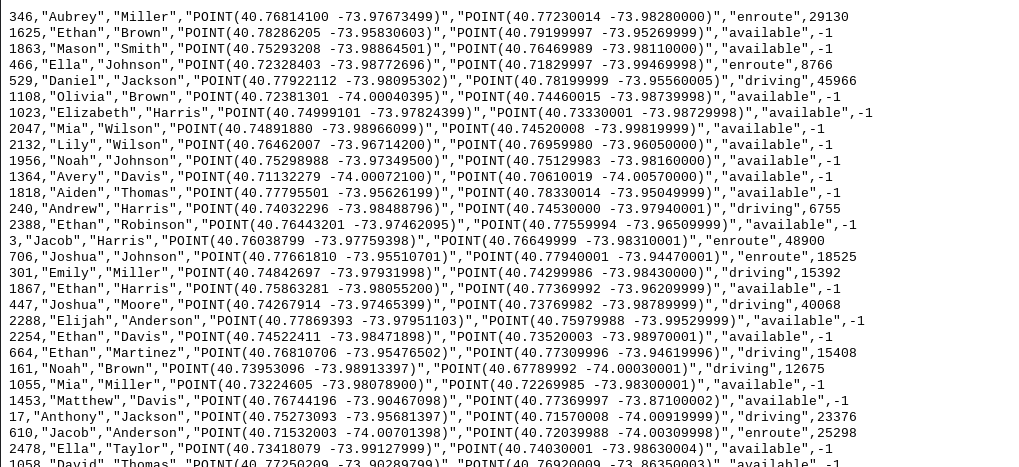

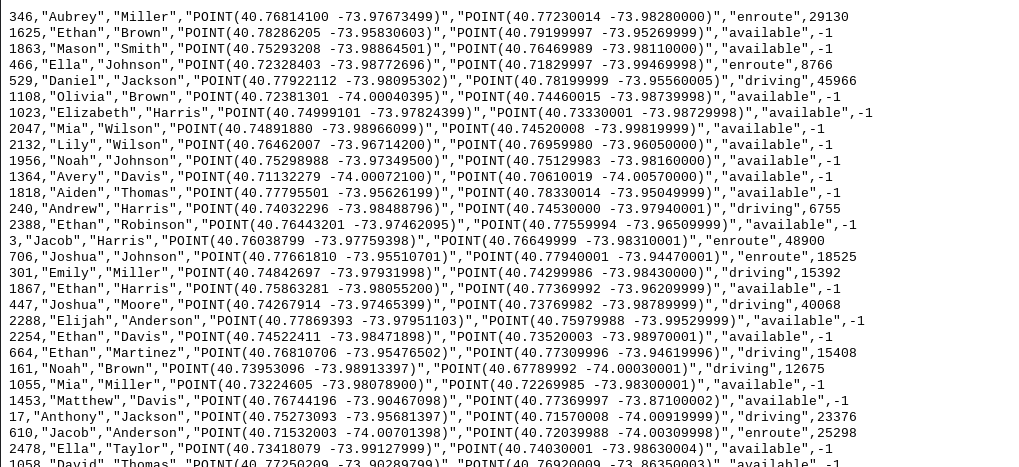

Acesse Cloud Storage > Buckets e abra o bucket . Você vai notar um arquivo de saída com carimbo de data/hora no bucket.

-

Clique nesse arquivo de saída e selecione Fazer download. Serão exibidos dados de táxi com nomes, coordenadas e horários.

Clique em Verificar meu progresso para conferir o objetivo.

Configurar uma arquitetura de streaming no Google Cloud

Ativar o Gemini Code Assist no Cloud Shell IDE

Você pode usar o Gemini Code Assist em um ambiente de desenvolvimento integrado (IDE), como o Cloud Shell, para receber orientações sobre o código ou resolver problemas com ele. Antes de começar a usar o Gemini Code Assist, você precisa ativá-lo.

- No Cloud Shell, ative a API Gemini para Google Cloud com o seguinte comando:

gcloud services enable cloudaicompanion.googleapis.com

- Clique em Abrir editor na barra de ferramentas do Cloud Shell.

Observação: para abrir o editor do Cloud Shell, clique em Abrir editor na barra de ferramentas do Cloud Shell. Você pode alternar o Cloud Shell e o editor de código clicando em Abrir editor ou Abrir terminal, conforme necessário.

-

Clique em Cloud Code - Sem projeto na barra de status na parte de baixo da tela.

-

Autorize o plug-in conforme instruído. Se um projeto não for selecionado automaticamente, clique em Selecionar um projeto do Google Cloud e escolha .

-

Verifique se o projeto do Google Cloud () aparece na mensagem de status do Cloud Code na barra de status.

Conectar o Cloud Storage ao SingleStore

Agora você precisa criar uma chave para conectar esse bucket privado do Cloud Storage ao SingleStore.

-

No Cloud Storage, acesse Configurações (no menu de navegação).

-

Clique na guia Interoperabilidade. Na parte de baixo, clique em Criar chave.

Em seguida, faça a ingestão dos dados no SingleStore com pipelines e inicie um procedimento armazenado.

- Volte à guia do Cloud Shell com o terminal do SingleStore aberto.

-

Para criar os pipelines iniciais do SingleStore, faça o seguinte:

- Na primeira guia do Cloud Shell, clique em Abrir editor. Se for solicitado, clique em Abrir em uma nova janela.

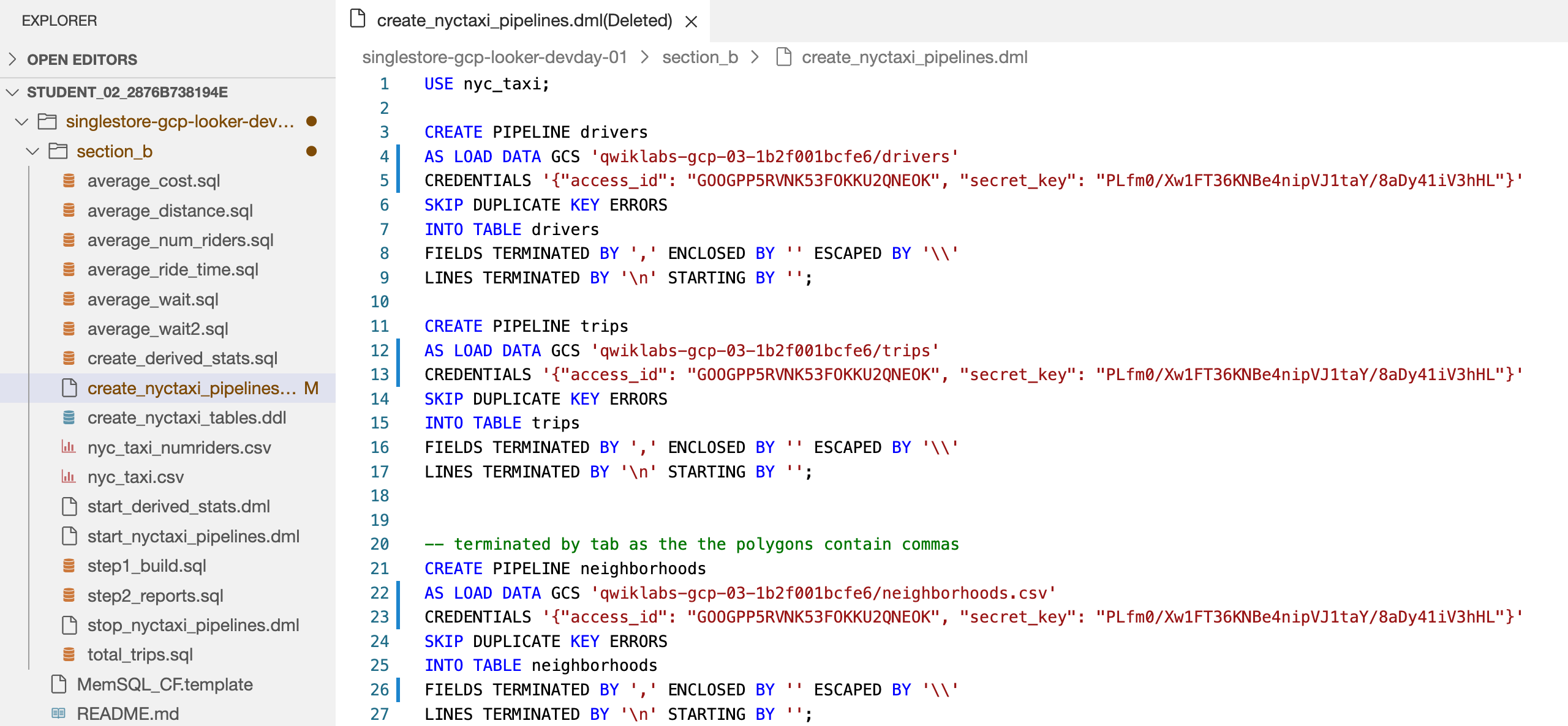

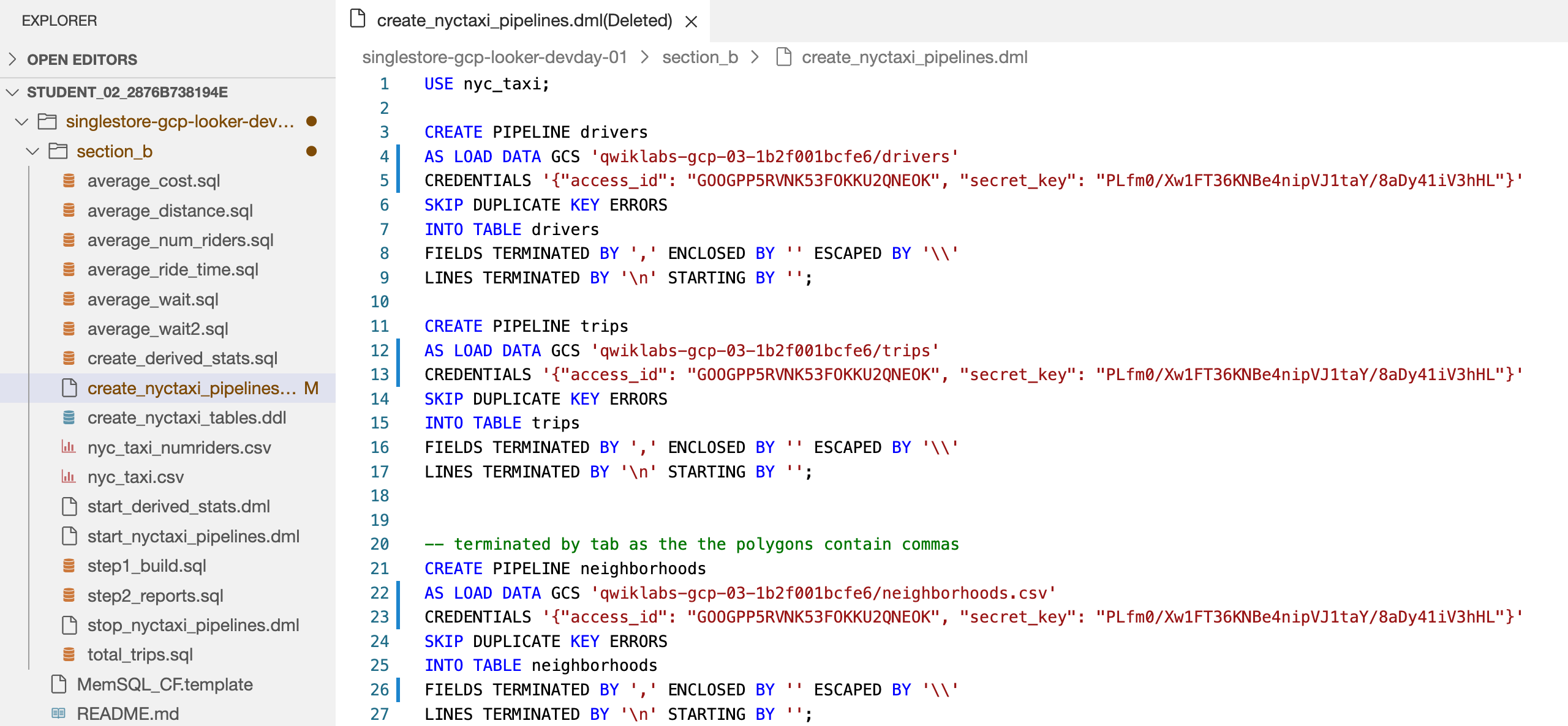

- Abra o arquivo singlestore-gcp-looker-devday-01 > section b > create_nyctaxi_pipelines.dml.

Essa ação ativa o Gemini Code Assist, como indicado pela presença do ícone  no canto superior direito do editor.

no canto superior direito do editor.

Usar o Gemini Code Assist para saber mais sobre um arquivo de pipeline do SingleStore

-

Clique no ícone Gemini Code Assist: ações inteligentes  e selecione Explain this.

e selecione Explain this.

-

O Gemini Code Assist abre um painel de chat com o comando Explain this preenchido. Na caixa de texto inline do chat do Code Assist, substitua o comando preenchido previamente pelo seguinte e clique em Enviar:

Você é um engenheiro de dados sênior na Cymbal AI. Um novo membro da equipe não conhece esse código do SingleStore Pipelines. Explique o arquivo create_nyctaxi_pipelines.dml em detalhes, incluindo os principais componentes usados no código.

Para as melhorias sugeridas, não atualize o arquivo.

A explicação do código presente no arquivo create_nyctaxi_pipelines.dml aparece no chat do Gemini Code Assist.

- Faça as seguintes atualizações no arquivo:

- Na linha 4, altere o nome do bucket para corresponder ao nome do seu bucket.

- Na linha 5, adicione o ID de acesso ao bucket do Storage e a chave secreta que você acabou de criar.

- Na linha 12, altere o nome do bucket para corresponder ao nome do seu bucket.

- Na linha 13, adicione o ID de acesso ao bucket do Storage e a chave secreta que você acabou de criar.

- Na linha 22, altere o nome do bucket para corresponder ao nome do seu bucket e faça a mudança de

.tsv para .csv.

- Na linha 23, adicione o ID de acesso ao bucket do Storage e a chave secreta que você acabou de criar.

- Na linha 26, mude

/t para ,.

O arquivo deve ser semelhante ao seguinte:

- Clique em Salvar.

-

Volte ao terminal do Cloud Shell. Conecte-se ao SingleStore usando o comando MySQL que você usou antes. Você pode usar o mesmo comando usado anteriormente para se conectar ao SingleStore.

-

No comando MySQL, execute o seguinte para criar os pipelines:

source create_nyctaxi_pipelines.dml;

show pipelines;

A saída será parecida com o seguinte:

Saída:

| Pipelines_in_nyc_taxi | State | Scheduled |

| --------------------- | ------- | --------- |

| neighborhoods | Stopped | False |

| drivers | Stopped | False |

| trips | Stopped | False |

Tarefa 8: iniciar os pipelines

- Execute os comandos abaixo para iniciar os pipelines:

source start_nyctaxi_pipelines.dml;

show pipelines;

Saída:

| Pipelines_in_nyc_taxi | State | Scheduled |

| --------------------- | ------- | --------- |

| neighborhoods | Running | False |

| drivers | Running | False |

| trips | Running | False |

- Verifique se o status dos três pipelines é Em execução.

Tarefa 9: executar consultas de análise operacional

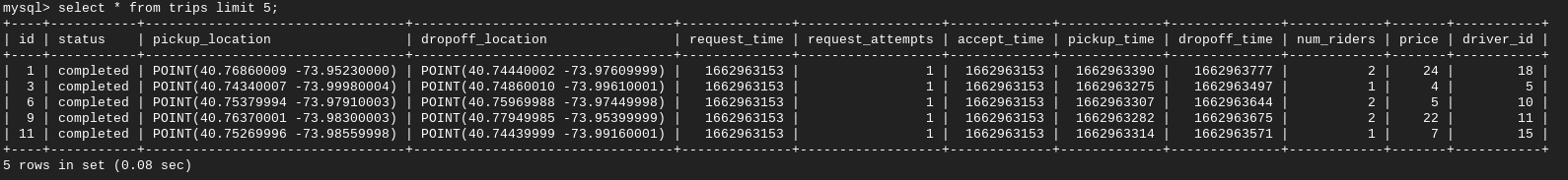

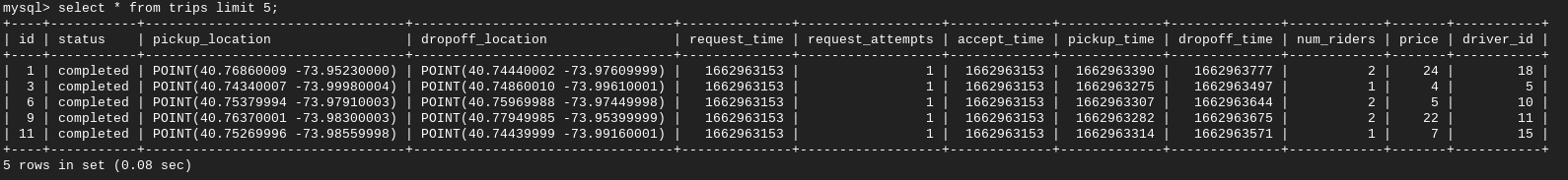

- Execute os comandos abaixo para executar as consultas de análise operacional:

select * from trips limit 5;

select * from drivers limit 5;

select * from neighborhoods limit 5;

Relatório 1: número total de viagens para cada bairro.

- Depois, execute:

source total_trips.sql;

Relatório 2: o tempo médio entre o pedido da viagem e o embarque do passageiro.

- Depois execute:

source average_wait.sql;

Relatório 3: a distância média de uma viagem.

- Execute este comando:

source average_distance.sql;

Relatório 4: o tempo médio entre o embarque e o desembarque de um passageiro.

- Execute este comando:

source average_ride_time.sql;

Relatório 5: o custo médio de uma viagem.

- Execute este comando:

source average_cost.sql;

Relatório 6: o tempo médio entre o recebimento do pedido da viagem pelo motorista e o embarque do passageiro.

- Execute este comando:

source average_wait2.sql;

Relatório 7: o número médio de passageiros por viagem.

- Por fim, execute o seguinte:

source average_num_riders.sql;

Parabéns!

Parabéns! Neste laboratório, você implantou o SingleStoreDB e o combinou com produtos nativos da nuvem do Google Cloud, como o Pub/Sub, o Dataflow e o Cloud Storage. Você também usou o pipeline nativo do SingleStoreDB para ingerir dados do Cloud Storage e executar consultas de análise operacional.

Saiba mais sobre o SingleStore em SingleStore.com.

Treinamento e certificação do Google Cloud

Esses treinamentos ajudam você a aproveitar as tecnologias do Google Cloud ao máximo. Nossas aulas incluem habilidades técnicas e práticas recomendadas para ajudar você a alcançar rapidamente o nível esperado e continuar sua jornada de aprendizado. Oferecemos treinamentos que vão do nível básico ao avançado, com opções de aulas virtuais, sob demanda e por meio de transmissões ao vivo para que você possa encaixá-las na correria do seu dia a dia. As certificações validam sua experiência e comprovam suas habilidades com as tecnologias do Google Cloud.

Manual atualizado em 4 de setembro de 2025.

Laboratório testado em 4 de setembro de 2025.

Copyright 2026 Google LLC. Todos os direitos reservados. Google e o logotipo do Google são marcas registradas da Google LLC. Todos os outros nomes de produtos e empresas podem ser marcas registradas das respectivas empresas a que estão associados.

) no canto superior direito do console. Se for solicitado, clique em Continuar e em Autorizar.

) no canto superior direito do console. Se for solicitado, clique em Continuar e em Autorizar.

no canto superior direito do editor.

no canto superior direito do editor.