GSP1088

Visão geral

O Cloud Logging é um serviço totalmente gerenciado que permite armazenar, pesquisar, analisar, monitorar e alertar sobre dados e eventos de geração de registros do Google Cloud.

Neste laboratório, você vai conhecer os recursos e as ferramentas que o Cloud Logging oferece para gerar insights sobre seus aplicativos.

O que você vai aprender

Neste laboratório, você vai aprender a:

- Usar o Cloud Logging de forma eficaz e aproveitar os insights sobre os aplicativos em execução no Google Kubernetes Engine (GKE).

- Criar e executar consultas SQL de forma eficaz usando a Análise de Dados de Registros.

O aplicativo de demonstração usado no laboratório

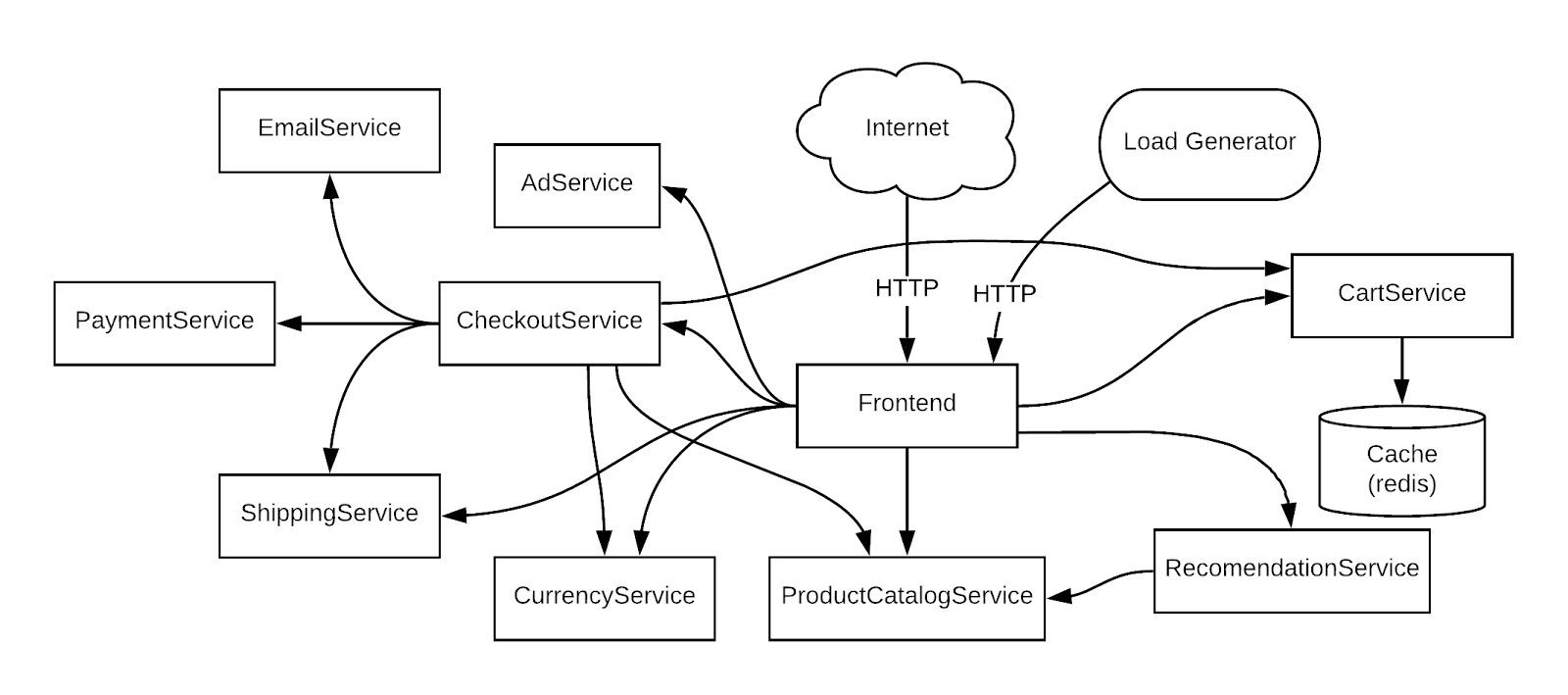

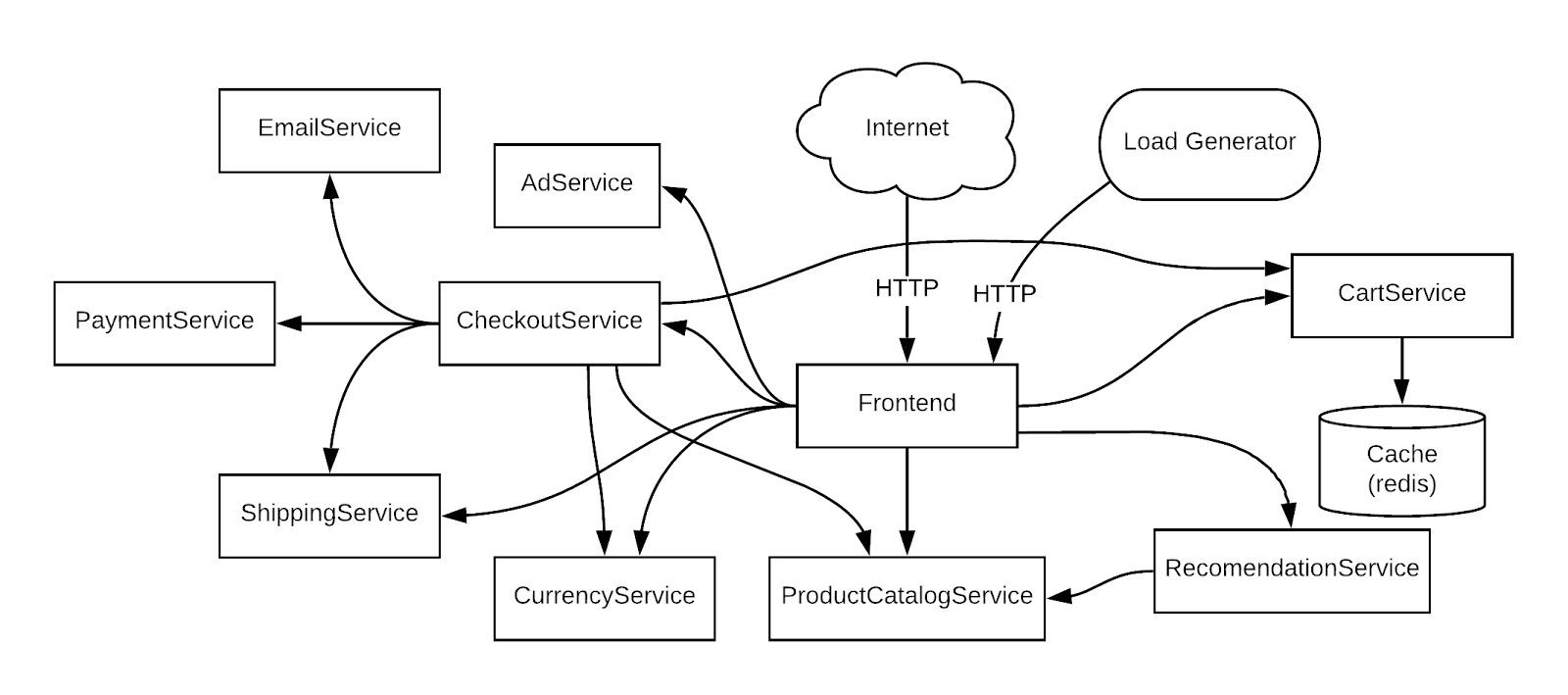

Neste laboratório, você vai trabalhar em um cenário baseado no app de demonstração de microsserviços implantado em um cluster do GKE. Esse app de demonstração tem vários microsserviços e dependências incorporados.

Configuração e requisitos

Antes de clicar no botão Começar o Laboratório

Leia estas instruções. Os laboratórios são cronometrados e não podem ser pausados. O timer é ativado quando você clica em Iniciar laboratório e mostra por quanto tempo os recursos do Google Cloud vão ficar disponíveis.

Este laboratório prático permite que você realize as atividades em um ambiente real de nuvem, e não em uma simulação ou demonstração. Você vai receber novas credenciais temporárias para fazer login e acessar o Google Cloud durante o laboratório.

Confira os requisitos para concluir o laboratório:

- Acesso a um navegador de Internet padrão (recomendamos o Chrome).

Observação: para executar este laboratório, use o modo de navegação anônima (recomendado) ou uma janela anônima do navegador. Isso evita conflitos entre sua conta pessoal e de estudante, o que poderia causar cobranças extras na sua conta pessoal.

- Tempo para concluir o laboratório: não se esqueça que, depois de começar, não será possível pausar o laboratório.

Observação: use apenas a conta de estudante neste laboratório. Se usar outra conta do Google Cloud, você poderá receber cobranças nela.

Como iniciar seu laboratório e fazer login no console do Google Cloud

-

Clique no botão Começar o laboratório. Se for preciso pagar por ele, uma caixa de diálogo vai aparecer para você selecionar a forma de pagamento.

No painel Detalhes do Laboratório, à esquerda, você vai encontrar o seguinte:

- O botão Abrir Console do Google Cloud

- O tempo restante

- As credenciais temporárias que você vai usar neste laboratório

- Outras informações, se forem necessárias

-

Se você estiver usando o navegador Chrome, clique em Abrir console do Google Cloud ou clique com o botão direito do mouse e selecione Abrir link em uma janela anônima.

O laboratório ativa os recursos e depois abre a página Fazer Login em outra guia.

Dica: coloque as guias em janelas separadas lado a lado.

Observação: se aparecer a caixa de diálogo Escolher uma conta, clique em Usar outra conta.

-

Se necessário, copie o Nome de usuário abaixo e cole na caixa de diálogo Fazer login.

{{{user_0.username | "Username"}}}

Você também encontra o nome de usuário no painel Detalhes do Laboratório.

-

Clique em Próxima.

-

Copie a Senha abaixo e cole na caixa de diálogo de Olá.

{{{user_0.password | "Password"}}}

Você também encontra a senha no painel Detalhes do Laboratório.

-

Clique em Próxima.

Importante: você precisa usar as credenciais fornecidas no laboratório, e não as da sua conta do Google Cloud.

Observação: se você usar sua própria conta do Google Cloud neste laboratório, é possível que receba cobranças adicionais.

-

Acesse as próximas páginas:

- Aceite os Termos e Condições.

- Não adicione opções de recuperação nem autenticação de dois fatores (porque essa é uma conta temporária).

- Não se inscreva em testes gratuitos.

Depois de alguns instantes, o console do Google Cloud será aberto nesta guia.

Observação: para acessar os produtos e serviços do Google Cloud, clique no Menu de navegação ou digite o nome do serviço ou produto no campo Pesquisar.

Ativar o Cloud Shell

O Cloud Shell é uma máquina virtual com várias ferramentas de desenvolvimento. Ele tem um diretório principal permanente de 5 GB e é executado no Google Cloud. O Cloud Shell oferece acesso de linha de comando aos recursos do Google Cloud.

-

Clique em Ativar o Cloud Shell  na parte de cima do console do Google Cloud.

na parte de cima do console do Google Cloud.

-

Clique nas seguintes janelas:

- Continue na janela de informações do Cloud Shell.

- Autorize o Cloud Shell a usar suas credenciais para fazer chamadas de APIs do Google Cloud.

Depois de se conectar, você verá que sua conta já está autenticada e que o projeto está configurado com seu Project_ID, . A saída contém uma linha que declara o projeto PROJECT_ID para esta sessão:

Your Cloud Platform project in this session is set to {{{project_0.project_id | "PROJECT_ID"}}}

A gcloud é a ferramenta de linha de comando do Google Cloud. Ela vem pré-instalada no Cloud Shell e aceita preenchimento com tabulação.

- (Opcional) É possível listar o nome da conta ativa usando este comando:

gcloud auth list

- Clique em Autorizar.

Saída:

ACTIVE: *

ACCOUNT: {{{user_0.username | "ACCOUNT"}}}

To set the active account, run:

$ gcloud config set account `ACCOUNT`

- (Opcional) É possível listar o ID do projeto usando este comando:

gcloud config list project

Saída:

[core]

project = {{{project_0.project_id | "PROJECT_ID"}}}

Observação: consulte a documentação completa da gcloud no Google Cloud no guia de visão geral da gcloud CLI.

Tarefa 1: configuração da infraestrutura

Verificar o cluster do GKE

Conecte-se a um cluster do GKE e confirme se ele foi criado corretamente.

- No Cloud Shell, defina a zona no

gcloud:

gcloud config set compute/zone {{{project_0.default_zone|placeholder}}}

- Use este comando para ver o status do cluster:

gcloud container clusters list

Você verá um status parecido com este:

NAME: day2-ops

LOCATION: us-west1

MASTER_VERSION: 1.31.5-gke.1023000

MASTER_IP: 34.169.197.173

MACHINE_TYPE: e2-standard-2

NODE_VERSION: 1.31.5-gke.1023000

NUM_NODES: 3

STATUS: RUNNING

O status do cluster deve ser "EM EXECUÇÃO". Se ele ainda for "PROVISIONAMENTO", aguarde um pouco e execute o comando acima outra vez. Repita até que o status mude para "EM EXECUÇÃO".

Você também pode verificar o progresso no console do Google Cloud. No Menu de navegação ( ), clique em Kubernetes Engine > Clusters.

), clique em Kubernetes Engine > Clusters.

- Quando o status mudar para "EM EXECUÇÃO", consulte as credenciais do cluster:

gcloud container clusters get-credentials day2-ops --region {{{project_0.default_region|placeholder}}}

A saída será parecida com esta:

Fetching cluster endpoint and auth data.

kubeconfig entry generated for day2-ops.

- Verifique se os nós foram criados:

kubectl get nodes

A saída será parecida com esta:

NAME STATUS ROLES AGE VERSION

gke-day2-ops-day2-ops-node-pool-0d9c7ef3-xc44 Ready <none> 11m v1.31.5-gke.1023000

gke-day2-ops-day2-ops-node-pool-b17ac6d6-tch7 Ready <none> 11m v1.31.5-gke.1023000

gke-day2-ops-day2-ops-node-pool-ed506ae8-wsc5 Ready <none> 11m v1.31.5-gke.1023000

Tarefa 2: implantar o aplicativo

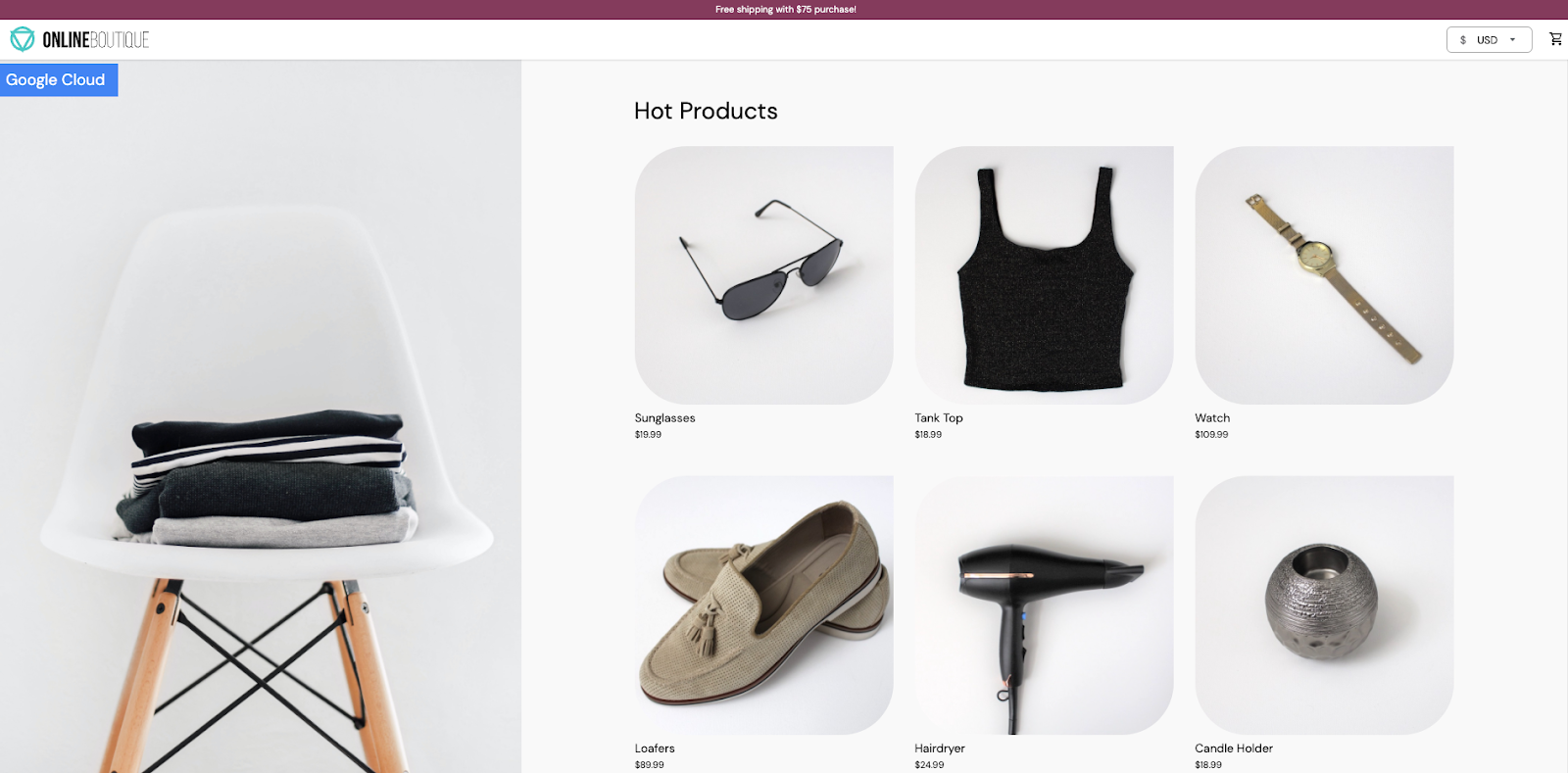

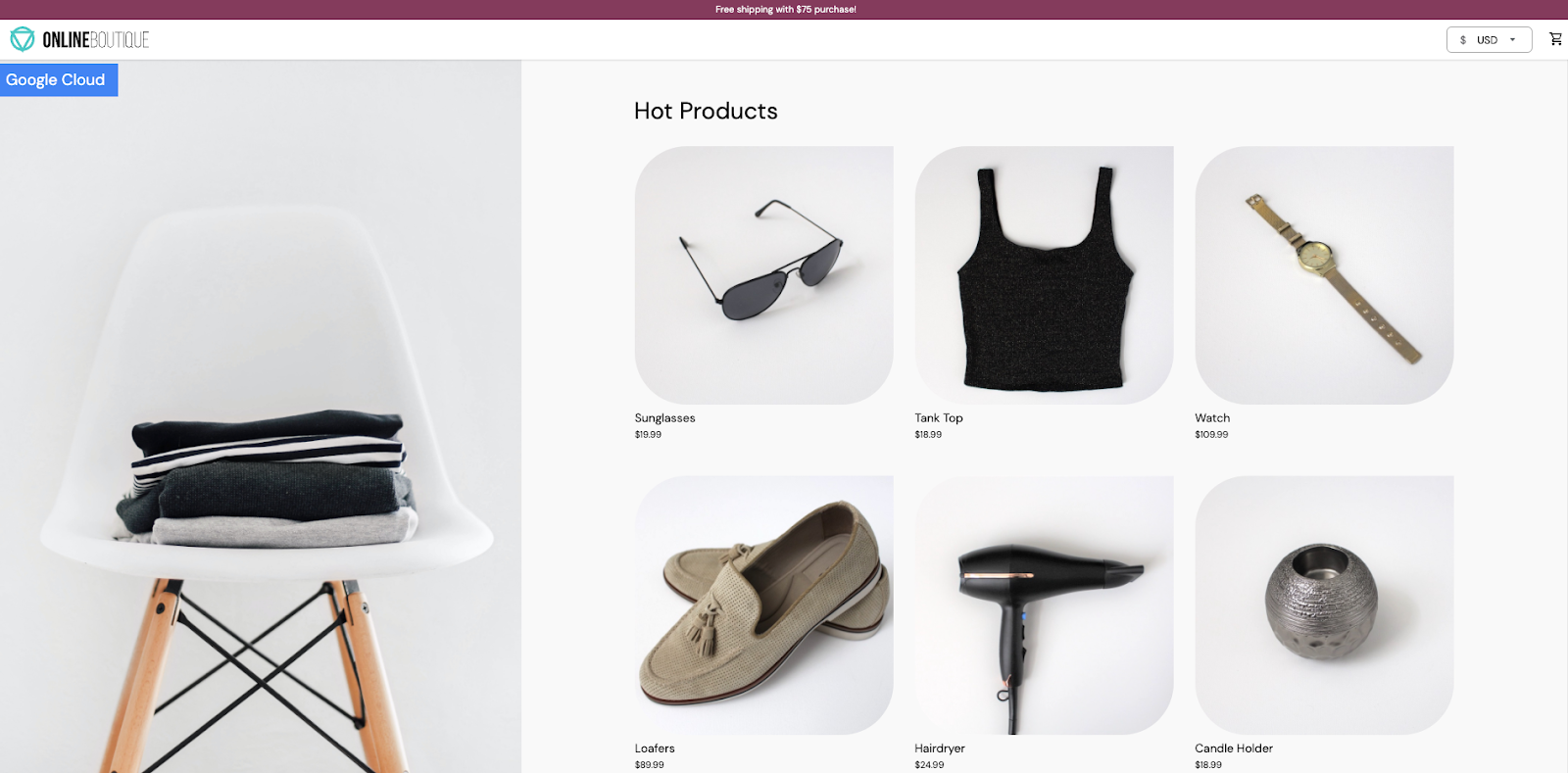

Em seguida, você vai implantar um aplicativo de microsserviços chamado Online Boutique no seu cluster para criar um fluxo de trabalho que pode ser monitorado.

- Execute o seguinte comando para clonar o repositório:

git clone https://github.com/GoogleCloudPlatform/microservices-demo.git

- Navegue até o diretório

microservices-demo:

cd microservices-demo

- Instale o app usando

kubectl:

kubectl apply -f release/kubernetes-manifests.yaml

- Confirme se tudo está funcionando corretamente:

kubectl get pods

A saída será parecida com o exemplo a seguir. Antes de passar para a próxima etapa, execute o comando até que todos os pods estejam com o status "Em execução".

NAME READY STATUS RESTARTS AGE

adservice-55f94cfd9c-4lvml 1/1 Running 0 20m

cartservice-6f4946f9b8-6wtff 1/1 Running 2 20m

checkoutservice-5688779d8c-l6crl 1/1 Running 0 20m

currencyservice-665d6f4569-b4sbm 1/1 Running 0 20m

emailservice-684c89bcb8-h48sq 1/1 Running 0 20m

frontend-67c8475b7d-vktsn 1/1 Running 0 20m

loadgenerator-6d646566db-p422w 1/1 Running 0 20m

paymentservice-858d89d64c-hmpkg 1/1 Running 0 20m

productcatalogservice-bcd85cb5-d6xp4 1/1 Running 0 20m

recommendationservice-685d7d6cd9-pxd9g 1/1 Running 0 20m

redis-cart-9b864d47f-c9xc6 1/1 Running 0 20m

shippingservice-5948f9fb5c-vndcp 1/1 Running 0 20m

- Execute o código a seguir para exibir o IP externo do aplicativo.

export EXTERNAL_IP=$(kubectl get service frontend-external -o jsonpath="{.status.loadBalancer.ingress[0].ip}")

echo $EXTERNAL_IP

O endereço IP só é retornado depois que o serviço é implantado. Por isso, talvez seja necessário repetir os comandos até que um endereço IP externo seja atribuído.

Quando o endereço IP for atribuído, a saída será parecida com esta:

35.222.235.86

- Por fim, verifique se o app está em execução:

curl -o /dev/null -s -w "%{http_code}\n" http://${EXTERNAL_IP}

A confirmação será parecida com esta:

200

Depois que o aplicativo for implantado, acesse o console e confira o status.

-

Na página do Kubernetes Engine, no painel à esquerda, clique em Cargas de trabalho para conferir se todos os pods estão com o status "OK".

-

No painel à esquerda, clique em Gateways, serviços e entrada e depois na guia Serviços para verificar se todos os serviços mostram o status "OK".

Abra o aplicativo

Em Gateways, serviços e entrada > Serviços , clique no IP do Endpoint do serviço frontend-external.

Isso vai abrir uma página da web de demonstração parecida com esta:

Observação: se solicitado, talvez seja necessário clicar em um botão "Continuar para o site".

Clique em Verificar meu progresso para conferir o objetivo.

Implantar o aplicativo

Tarefa 3: gerenciar buckets de registros

Há duas formas de ativar a Análise de Dados de Registros. Uma delas é fazer upgrade de um bucket que já foi criado, e a outra é criar um novo bucket de registros com a Análise de Dados de Registros ativada.

Faça upgrade de um bucket

As etapas a seguir podem ser usadas para fazer upgrade de um bucket de registros que já foi criado.

-

No console, no Menu de navegação ( ), clique em Ver todos os produtos > Observabilidade > Logging. Clique em Favorito para facilitar o acesso depois no laboratório.

), clique em Ver todos os produtos > Observabilidade > Logging. Clique em Favorito para facilitar o acesso depois no laboratório.

-

Clique em Armazenamento de registros.

-

Clique em Fazer upgrade de um bucket atual, Bucket padrão.

-

Clique em Fazer upgrade na caixa de diálogo de confirmação.

-

Aguarde a mudança do status para Com upgrade.

-

Clique em Abrir e selecione a visualização _AllLogs.

A página Análise de Dados de Registros é aberta.

Crie um novo bucket de registros

Siga estas etapas para criar um novo bucket de registros.

-

No painel à esquerda, clique em Armazenamento de registros e depois em Criar bucket de registros na parte de cima da janela "Armazenamento de registros".

-

Dê um nome ao bucket. Por exemplo, day2ops-log.

-

Marque Fazer upgrade para usar a Análise de Dados de Registros e Criar um novo conjunto de dados do BigQuery vinculado a este bucket.

-

Digite um nome para o conjunto de dados do BigQuery. Por exemplo, day2ops_log.

-

No campo "Região", selecione a opção Global.

Selecionar Criar um conjunto de dados vinculado no BigQuery vai criar um conjunto de dados para você no BigQuery, se ainda não houver. Isso vai permitir a realização de consultas no BigQuery.

- Por fim, clique em Criar bucket para criar o bucket de registros.

Clique em Verificar meu progresso para conferir o objetivo.

Criar um bucket de registros

Faça gravações no novo bucket de registros

Há algumas maneiras de criar um coletor de registros para rotear entradas no novo bucket:

- Diretamente do Roteador de registros.

- Em Análise de registros. Ao criar um coletor, você pode executar consultas para selecionar e filtrar os registros necessários. A vantagem disso é que a consulta é automaticamente copiada como filtro para a configuração do coletor.

-

Clique em Análise de registros no painel à esquerda.

-

No canto superior direito, ative a opção Mostrar consulta e execute a seguinte consulta no campo correspondente:

resource.type="k8s_container"

-

Clique em Ações > Criar coletor.

-

Em nome do coletor, digite day2ops-sink.

-

Clique em Avançar.

-

Selecione bucket do Logging na lista suspensa do serviço de coletor.

-

Selecione o novo bucket de registros que você acabou de criar.

Seu novo bucket vai ficar parecido com este:

projects/qwiklabs-gcp-00-xxxxxxx/locations/global/buckets/day2ops-log

- Clique em Avançar.

A consulta do tipo de recurso já estará visível no filtro.

- Clique em Criar coletor.

Espere cerca de um minuto até o coletor ser criado.

Clique em Verificar meu progresso para conferir o objetivo.

Criar o coletor de registro

Faça leituras no novo bucket de registros

No painel à esquerda, acesse Análise de registros. Observe que, na lista Campos na seção Tipo de recurso, há vários tipos de recursos para os registros.

-

Para ver os registros no novo bucket, vá para o canto superior esquerdo da janela "Análise de registros", clique em Registros do projeto > Visualização de registro > o novo bucket de registros (que você acabou de criar).

-

Clique em Aplicar.

Você vai perceber que os contêineres do Kubernetes são o único tipo de recurso restante e que há menos entradas. Isso ocorre porque apenas os registros filtrados são enviados para o bucket.

Tarefa 4: Análise de Dados de Registros

- No painel esquerdo, clique em Análise de dados de registros para abrir a página.

Se o campo da consulta ficar em branco ou se você esquecer a tabela que quer usar, clique no botão Executar consulta para retomar a consulta de amostra.

Agora você já pode executar suas próprias consultas no campo correspondente. Esta tarefa fornece alguns exemplos.

Importante: o nome da visualização de registro na cláusula FROM varia conforme o bucket. Não se esqueça de usar o nome de visualização correto. A etapa anterior pode ser usada para verificação.

Consulta de exemplo para encontrar as latências mínima, máxima e média

No painel à direita, selecione <> SQL. Clique no botão Limpar para remover qualquer conteúdo do editor de consultas. Cole a consulta no editor e selecione Executar consulta para recuperar os erros mais recentes dos contêineres.

Use a consulta para encontrar as latências mínima, máxima e média em um período para o serviço de front-end:

SELECT

hour,

MIN(took_ms) AS min,

MAX(took_ms) AS max,

AVG(took_ms) AS avg

FROM (

SELECT

FORMAT_TIMESTAMP("%H", timestamp) AS hour,

CAST( JSON_VALUE(json_payload,

'$."http.resp.took_ms"') AS INT64 ) AS took_ms

FROM

`{{{project_0.project_id | "PROJECT_ID"}}}.global.day2ops-log._AllLogs`

WHERE

timestamp > TIMESTAMP_SUB(CURRENT_TIMESTAMP(), INTERVAL 24 HOUR)

AND json_payload IS NOT NULL

AND SEARCH(labels,

"frontend")

AND JSON_VALUE(json_payload.message) = "request complete"

ORDER BY

took_ms DESC,

timestamp ASC )

GROUP BY

1

ORDER BY

1

Exemplo de consulta para encontrar o número de visitas à página do produto

Use a consulta para descobrir quantas vezes os usuários acessaram uma determinada página de produto na última hora:

SELECT

count(*)

FROM

`{{{project_0.project_id | "PROJECT_ID"}}}.global.day2ops-log._AllLogs`

WHERE

text_payload like "GET %/product/L9ECAV7KIM %"

AND

timestamp > TIMESTAMP_SUB(CURRENT_TIMESTAMP(), INTERVAL 1 HOUR)

Exemplo de consulta para descobrir quantas sessões terminam com a finalização da compra no carrinho

Use a consulta para descobrir quantas sessões terminam em finalização de compra (chamada POST para o serviço "/cart/checkout"):

SELECT

JSON_VALUE(json_payload.session),

COUNT(*)

FROM

`{{{project_0.project_id | "PROJECT_ID"}}}.global.day2ops-log._AllLogs`

WHERE

JSON_VALUE(json_payload['http.req.method']) = "POST"

AND JSON_VALUE(json_payload['http.req.path']) = "/cart/checkout"

AND timestamp > TIMESTAMP_SUB(CURRENT_TIMESTAMP(), INTERVAL 1 HOUR)

GROUP BY

JSON_VALUE(json_payload.session)

Parabéns!

Agora você tem experiência no uso do Cloud Logging para receber insights sobre os aplicativos em execução no GKE, além de criar e executar consultas usando a Análise de Dados de Registros.

Treinamento e certificação do Google Cloud

Esses treinamentos ajudam você a aproveitar as tecnologias do Google Cloud ao máximo. Nossas aulas incluem habilidades técnicas e práticas recomendadas para ajudar você a alcançar rapidamente o nível esperado e continuar sua jornada de aprendizado. Oferecemos treinamentos que vão do nível básico ao avançado, com opções de aulas virtuais, sob demanda e por meio de transmissões ao vivo para que você possa encaixá-las na correria do seu dia a dia. As certificações validam sua experiência e comprovam suas habilidades com as tecnologias do Google Cloud.

Manual atualizado em 15 de janeiro de 2026

Laboratório testado em 15 de janeiro de 2026

Copyright 2026 Google LLC. Todos os direitos reservados. Google e o logotipo do Google são marcas registradas da Google LLC. Todos os outros nomes de produtos e empresas podem ser marcas registradas das respectivas empresas a que estão associados.

na parte de cima do console do Google Cloud.

na parte de cima do console do Google Cloud. ), clique em Kubernetes Engine > Clusters.

), clique em Kubernetes Engine > Clusters.