GSP367

Visão geral

Nos laboratórios com desafio, apresentamos uma situação e um conjunto de tarefas. Para concluí-las, em vez de seguir instruções detalhadas, você usará o que aprendeu nos laboratórios do curso. Um sistema automático de pontuação (mostrado nesta página) vai avaliar seu desempenho.

Nos laboratórios com desafio, não ensinamos novos conceitos do Google Cloud. O objetivo dessas tarefas é aprimorar aquilo que você já aprendeu, como a alteração de valores padrão ou a leitura e pesquisa de mensagens para corrigir seus próprios erros.

Para alcançar a pontuação de 100%, você precisa concluir todas as tarefas no tempo definido.

Este laboratório é recomendado para estudantes inscritos no curso com selo de habilidade Automatize a captura de dados em escala com Document AI. Tudo pronto para começar o desafio?

Cenário do desafio

Você trabalha com engenharia de dados em uma grande empresa de gerenciamento de infraestrutura e recebeu a atribuição de trabalhar em um projeto interno com o departamento financeiro. A empresa precisa processar uma montanha cada vez maior de documentos, que exige processamento manual individual para validação e autorização, numa tarefa cara e que envolve muitas pessoas. O plano é usar as ferramentas do Google Cloud para automatizar o processo de coleta, categorização e verificação de documentos de maneira eficiente e com menos trabalho.

Seu desafio

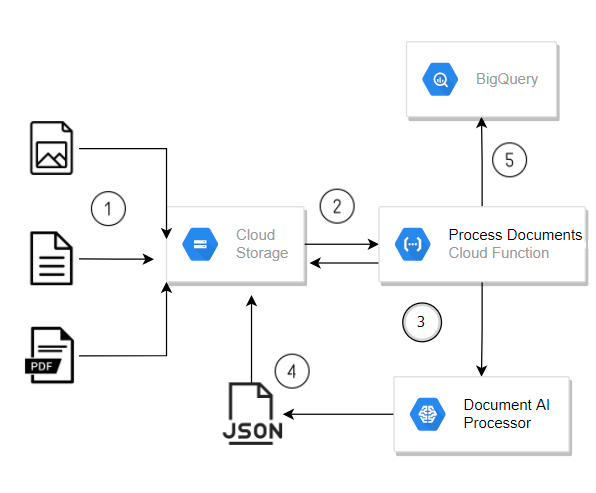

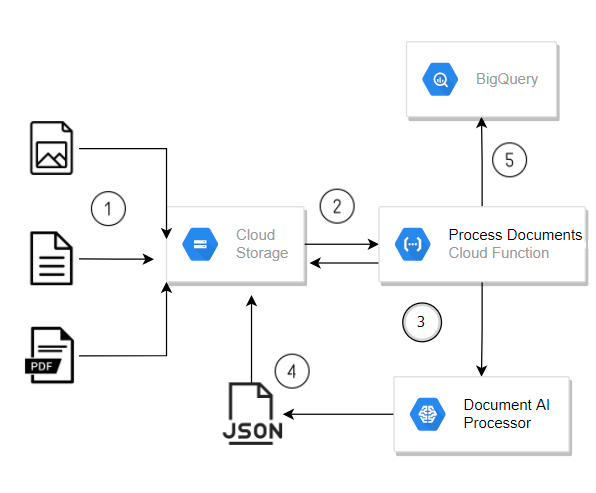

Você precisa criar um pipeline de processamento de documentos que trabalhe automaticamente com os documentos enviados ao Cloud Storage. O pipeline consiste em uma função principal do Cloud Run, que processa novos arquivos usando um processador de formulários da Document AI para extrair os dados do documento. A função salva os dados do formulário detectados nesses arquivos no BigQuery.

Você recebe o código-fonte de uma função do Cloud Run que vai realizar o processamento e precisa implantar o pipeline de processamento de documentos conforme mostrado na arquitetura abaixo, configurando corretamente os componentes para seu pipeline específico.

Tarefa 1: Ativar a API Document AI do Cloud e copiar os arquivos de origem do laboratório.

Nesta tarefa, você vai ativar a API Document AI do Cloud e copiar os arquivos iniciais para o Cloud Shell.

Ativar a API Document AI do Cloud

- Ativar a API Document AI do Cloud.

Ativar a API Document AI do Cloud

Copie os arquivos de origem do laboratório para o Cloud Shell

As funções do Cloud Run com código predefinido ficam em um bucket remoto do Cloud Storage. Copie esses arquivos de origem para o Cloud Shell. Eles incluem o código-fonte das funções do Cloud Run e o esquema da tabela do BigQuery que você vai criar no laboratório.

- No Cloud Shell, digite o comando a seguir para clonar o repositório de origem do laboratório:

mkdir ./document-ai-challenge

gsutil -m cp -r gs://spls/gsp367/* \

~/document-ai-challenge/

Tarefa 2: Criar um processador de formulários

Crie uma instância do processador de formulários geral usando o processador Analisador de formulários do Document AI na seção Geral (não especializada). O processador de formulários geral vai rodar todos os tipos de documento e extrair o conteúdo de texto que identificar no documento, bem como as informações de formulário que inferir do layout.

- Crie o processador usando os seguintes detalhes de configuração:

| Propriedade |

Valor |

| Tipo de processador |

Analisador de formulários |

| Nome do processador |

|

| Região |

EUA |

Observação: você vai configurar uma função do Cloud Run mais tarde neste laboratório com o ID DO PROCESSADOR e o LOCAL DO ANALISADOR deste processador para que as funções do Cloud Run usem esse processador específico na hora de processar faturas. Clique no processador criado e anote o ID DO PROCESSADOR, lembrando que a região do processador é o LOCAL DO ANALISADOR.

Criar um processador de formulários

Tarefa 3: Criar recursos do Google Cloud

Prepare seu ambiente criando os recursos do Google Cloud Storage e do BigQuery necessários para o pipeline de processamento de documentos.

Criar buckets de entrada, saída e arquivo do Cloud Storage

- Nesta etapa, você vai criar os três buckets do Cloud Storage abaixo com o acesso uniforme no nível do bucket ativado.

| Nome do bucket |

Finalidade |

Classe de armazenamento |

Local |

|

Para faturas de entrada |

Padrão |

|

|

Para armazenar dados processados |

Padrão |

|

|

Para arquivar faturas |

Padrão |

|

Observação: um bucket pode ser criado usando a ferramenta gsutil com o parâmetro -mb, além do parâmetro -c para definir a classe de armazenamento, -l para definir o local (regional) e a flag -b com o valor "on" ou "off" para definir o acesso uniforme no nível do bucket. Leia a referência mb - Make buckets para saber mais sobre como criar buckets usando a gsutil.

Criar um conjunto de dados e tabelas do BigQuery

- Nesta etapa, você precisa criar um conjunto de dados do BigQuery e a tabela de saída necessária para seu pipeline de processamento de dados.

Conjunto de dados

| Nome do conjunto de dados |

Local |

| invoice_parser_results |

EUA |

Observação: use bq mk para criar recursos do BigQuery. O parâmetro de opção de linha de comando -d é usado para criar um conjunto de dados, e --location é usado para definir o local do recurso. Leia o Guia de criação de conjuntos de dados para saber mais sobre como criar conjuntos de dados usando a ferramenta de linha de comando bq.

Tabela

O esquema da tabela para as informações extraídas consta no arquivo JSON document-ai-challenge/scripts/table-schema/doc_ai_extracted_entities.json. Use esse esquema para criar a tabela doc_ai_extracted_entities no conjunto de dados invoice_parser_results.

Observação: use bq mk para criar recursos do BigQuery. A opção de linha de comando --table é usada para criar uma tabela. Para mais informações sobre como criar tabelas com uma definição de esquema usando a ferramenta de linha de comando bq, leia o guia Criar e usar tabelas.

Você pode acessar o BigQuery no console do Cloud e inspecionar o esquema das tabelas no conjunto de dados invoice_parser_results usando o espaço de trabalho SQL do BigQuery.

Criar recursos do Google Cloud

Tarefa 4: Implantar as funções do Cloud Run para processamento de documentos

Como conclusão, você precisa implantar as funções do Cloud Run que seu pipeline de processamento de dados usa para processar faturas enviadas ao Cloud Storage. Essa função vai usar um processador de formulário genérico da API Document AI para extrair dados de formulários dos documentos brutos.

Você pode examinar o código-fonte das funções do Cloud Run usando o editor de código ou qualquer outro editor de sua preferência. As funções do Cloud Run ficam armazenadas nas seguintes pastas no Cloud Shell:

- Processar faturas:

scripts/cloud-functions/process-invoices

As funções do Cloud Run, process-invoices, precisam ser acionadas quando os arquivos são enviados para o bucket de armazenamento de arquivos de entrada que você criou.

Implantar as funções do Cloud Run para processar documentos enviados ao Cloud Storage

Implante uma função do Cloud Run que usa um processador de formulários da Document AI para analisar documentos de formulários que foram enviados para um bucket do Cloud Storage.

- Navegue até o diretório

scripts:

cd ~/document-ai-challenge/scripts

- Atribua o papel de leitor do Artifact Registry à conta de serviço do Compute Engine:

PROJECT_ID=$(gcloud config get-value project)

PROJECT_NUMBER=$(gcloud projects list --filter="project_id:$PROJECT_ID" --format='value(project_number)')

SERVICE_ACCOUNT=$(gcloud storage service-agent --project=$PROJECT_ID)

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member serviceAccount:$SERVICE_ACCOUNT \

--role roles/pubsub.publisher

- Implante as funções do Cloud Run:

export CLOUD_FUNCTION_LOCATION={{{ project_0.default_region | "REGION" }}}

gcloud functions deploy process-invoices \

--gen2 \

--region=${CLOUD_FUNCTION_LOCATION} \

--entry-point=process_invoice \

--runtime=python313 \

--service-account=${PROJECT_ID}@appspot.gserviceaccount.com \

--source=cloud-functions/process-invoices \

--timeout=400 \

--env-vars-file=cloud-functions/process-invoices/.env.yaml \

--trigger-resource=gs://${PROJECT_ID}-input-invoices \

--trigger-event=google.storage.object.finalize\

--service-account $PROJECT_NUMBER-compute@developer.gserviceaccount.com \

--allow-unauthenticated

Observação: se surgir um erro de permissão ao implantar a função, espere uns três minutos e execute os comandos novamente.

Se você inspecionar o código-fonte das funções do Cloud Run, vai notar que a função recebe os detalhes do processador da Document AI por duas variáveis de ambiente de execução.

- Você terá que reconfigurar a implantação das funções do Cloud Run para que as variáveis de ambiente

PROCESSOR_ID e PARSER_LOCATION contenham os valores corretos para o processador Form Parser que você implantou em uma etapa anterior.

- Verifique se o valor de

PARSER_LOCATION está em letras minúsculas.

- Não se esqueça de atualizar a variável de ambiente

PROJECT_ID com o ID do seu projeto.

Aguarde a função ser totalmente reaplicada.

Implantar funções do Cloud Run para processamento de documentos

Tarefa 5: Testar e validar a solução

Na última tarefa, você precisa usar seu pipeline para processar o conjunto de faturas disponível na pasta ~/document-ai-challenge/invoices.

-

Faça upload dessas faturas para o bucket de entrada do Cloud Storage e monitore o progresso do pipeline.

-

Acompanhe os eventos até ver um evento final indicando que a execução da função terminou com o status OK.

Depois que o pipeline processa totalmente os documentos, as informações do formulário extraídas das faturas pelo processador da Document AI são gravadas na tabela do BigQuery.

Observação: para monitorar o progresso, clique em Registros na seção "Gerenciamento" das funções do Cloud Run para visualizar os registros.

Observação: neste laboratório, você pode encontrar alguns erros, que apesar disso não afetam o processamento de documentos de forma significativa, principalmente os tempos limite. Se os dados não forem gravados no BigQuery, verifique se os parâmetros definidos na guia Variáveis e secrets do console do Cloud Run estão corretos e tente de novo.

Em particular, verifique se as variáveis de ID e local do processador que você definiu são válidas, lembrando que o parâmetro de local precisa estar em letras minúsculas.

A atualização da lista de eventos não ocorre automaticamente.

Validar os dados processados pelo pipeline

Parabéns!

Parabéns! Neste laboratório, você criou um pipeline de processamento de documentos para processar automaticamente os documentos enviados para o Cloud Storage usando a API Document AI. Você criou um processador de formulários, implantou uma função do Cloud Run para processar documentos e validou a solução integralmente processando um conjunto de faturas.

Treinamento e certificação do Google Cloud

Esses treinamentos ajudam você a aproveitar as tecnologias do Google Cloud ao máximo. Nossas aulas incluem habilidades técnicas e práticas recomendadas para ajudar você a alcançar rapidamente o nível esperado e continuar sua jornada de aprendizado. Oferecemos treinamentos que vão do nível básico ao avançado, com opções de aulas virtuais, sob demanda e por meio de transmissões ao vivo para que você possa encaixá-las na correria do seu dia a dia. As certificações validam sua experiência e comprovam suas habilidades com as tecnologias do Google Cloud.

Manual atualizado em 14 de novembro de 2025

Laboratório testado em 14 de novembro de 2025

Copyright 2026 Google LLC. Todos os direitos reservados. Google e o logotipo do Google são marcas registradas da Google LLC. Todos os outros nomes de produtos e empresas podem ser marcas registradas das respectivas empresas a que estão associados.