GSP367

Ringkasan

Dalam challenge lab, Anda diberi sebuah skenario dan serangkaian tugas. Tidak ada petunjuk langkah demi langkah. Anda akan menggunakan keahlian yang dipelajari dari lab dalam kursus untuk mencari cara menyelesaikan sendiri tugas-tugas tersebut. Sistem pemberian skor otomatis (ditampilkan pada halaman ini) akan memberikan masukan tentang apakah Anda telah menyelesaikan tugas dengan benar atau tidak.

Saat mengikuti challenge lab, Anda tidak akan diajari konsep-konsep baru Google Cloud. Anda diharapkan dapat memperluas keahlian yang dipelajari, seperti mengubah nilai default dan membaca serta mengkaji pesan error untuk memperbaiki kesalahan Anda sendiri.

Untuk meraih skor 100%, Anda harus berhasil menyelesaikan semua tugas dalam jangka waktu tertentu.

Lab ini direkomendasikan bagi siswa yang sudah menyelesaikan kursus badge keahlian Mengotomatiskan Pengambilan Data Berskala Besar dengan Document AI. Apakah Anda siap menghadapi tantangan ini?

Skenario tantangan

Anda adalah seorang data engineer di perusahaan besar di bidang manajemen infrastruktur dan telah ditugaskan untuk mengerjakan project internal dengan divisi keuangan perusahaan. Perusahaan harus memproses tumpukan dokumen yang terus bertambah, yang semuanya memerlukan pemrosesan manual satu per satu untuk validasi dan otorisasi. Tentu saja ini merupakan tugas yang mahal dan membutuhkan banyak staf. Perusahaan berencana memanfaatkan alat Google Cloud untuk mengotomatiskan proses pengumpulan, pengkategorian, dan verifikasi dokumen secara efisien dan mengurangi pekerjaan manual.

Tantangan Anda

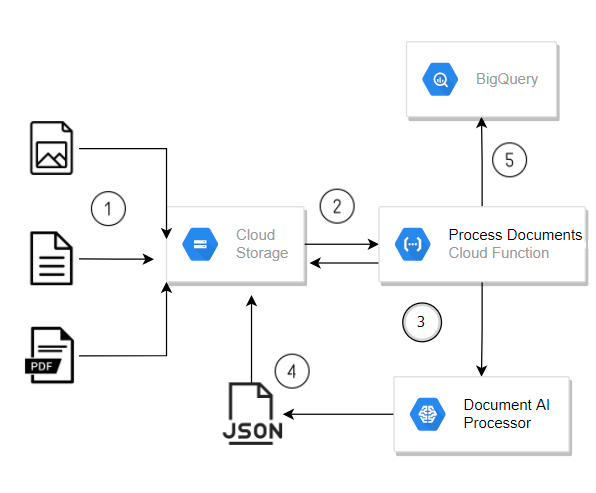

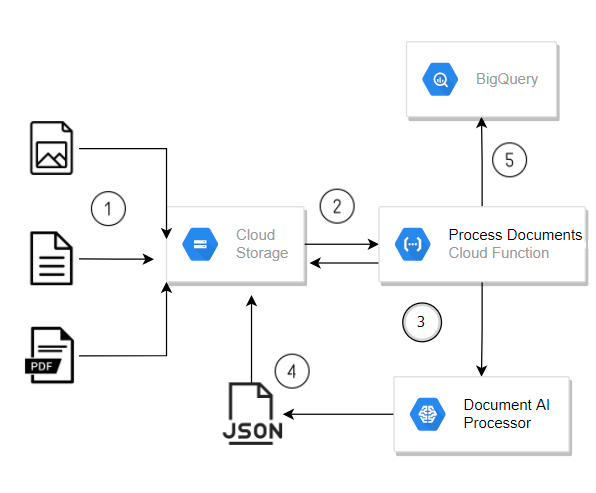

Anda harus membuat pipeline pemrosesan dokumen yang akan memproses dokumen yang diupload ke Cloud Storage secara otomatis. Pipeline ini terdiri dari fungsi Cloud Run utama yang memproses file baru menggunakan pemroses formulir Document AI untuk mengekstrak data dari dokumen. Fungsi ini kemudian menyimpan data formulir yang terdeteksi dalam file tersebut ke BigQuery.

Anda akan diberi kode sumber untuk fungsi Cloud Run yang akan melakukan pemrosesan, dan Anda diharapkan untuk men-deploy pipeline pemrosesan dokumen seperti yang ditunjukkan dalam arsitektur di bawah, dengan memastikan konfigurasi komponen untuk pipeline spesifik Anda sudah benar.

Tugas 1. Mengaktifkan Cloud Document AI API dan menyalin file sumber lab.

Dalam tugas ini, Anda akan mengaktifkan Cloud Document AI API dan menyalin file starter ke Cloud Shell.

Mengaktifkan Cloud Document AI API

- Aktifkan Cloud Document AI API.

Mengaktifkan Cloud Document AI API

Menyalin file sumber lab ke Cloud Shell Anda

Fungsi Cloud Run dengan kode yang sebelumnya telah ditentukan dihosting di bucket Cloud Storage jarak jauh. Salin file sumber ini ke Cloud Shell Anda. File ini mencakup kode sumber untuk fungsi Cloud Run dan skema untuk Tabel BigQuery yang akan Anda buat di lab.

- Di Cloud Shell, masukkan perintah berikut untuk membuat clone repositori sumber untuk lab:

mkdir ./document-ai-challenge

gsutil -m cp -r gs://spls/gsp367/* \

~/document-ai-challenge/

Tugas 2. Membuat pemroses formulir

Buat instance pemroses formulir umum menggunakan pemroses Form Parser Document AI di bagian General (tidak terspesialisasi). Pemroses formulir umum akan memproses semua jenis dokumen dan mengekstrak semua konten teks yang dapat diidentifikasi dalam dokumen tersebut serta informasi formulir yang disimpulkan dari tata letaknya.

- Buat pemroses menggunakan detail konfigurasi berikut:

| Properti |

Nilai |

| Processor Type |

Form Parser |

| Processor Name |

|

| Region |

US |

Catatan: Anda akan mengonfigurasi fungsi Cloud Run nanti di lab ini dengan PROCESSOR ID dan PARSER LOCATION dari pemroses ini sehingga fungsi Cloud Run akan menggunakan pemroses khusus ini untuk memproses invoice. Klik pemroses yang dibuat dan catat PROCESSOR ID-nya. Namun, region pemrosesnya adalah PARSER LOCATION.

Membuat pemroses formulir

Tugas 3. Membuat resource Google Cloud

Siapkan lingkungan Anda dengan membuat resource Google Cloud Storage dan BigQuery yang diperlukan untuk pipeline pemrosesan dokumen Anda.

Membuat bucket Cloud Storage input, output, dan arsip

- Pada langkah ini, Anda harus membuat tiga bucket Cloud Storage yang tercantum di bawah dengan akses level bucket seragam diaktifkan.

| Nama Bucket |

Tujuan |

Kelas penyimpanan |

Lokasi |

|

Untuk invoice input |

Standard |

|

|

Untuk menyimpan data yang diproses |

Standard |

|

|

Untuk mengarsipkan invoice |

Standard |

|

Catatan: Bucket dapat dibuat menggunakan alat gsutil dengan parameter -mb, bersama dengan parameter -c untuk menetapkan kelas penyimpanan, -l untuk menetapkan lokasi (regional), dan flag -b dengan nilai on atau off untuk menetapkan akses tingkat bucket seragam. Baca mb - Make buckets reference untuk mengetahui lebih lanjut cara membuat bucket menggunakan gsutil.

Membuat set data dan tabel BigQuery

- Pada langkah ini, Anda harus membuat set data BigQuery dan tabel output yang diperlukan untuk pipeline pemrosesan data Anda.

Set data

| Nama Set Data |

Lokasi |

| invoice_parser_results |

US |

Catatan: Gunakan bq mk untuk membuat resource BigQuery. Parameter switch command line -d digunakan untuk membuat set data dan --location digunakan untuk menetapkan lokasi resource. Baca panduan Membuat set data untuk mengetahui informasi selengkapnya tentang membuat set data menggunakan alat command line bq.

Tabel

Skema tabel untuk informasi yang diekstrak telah disediakan untuk Anda dalam file JSON document-ai-challenge/scripts/table-schema/doc_ai_extracted_entities.json. Gunakan skema ini untuk membuat tabel bernama doc_ai_extracted_entities di set data invoice_parser_results.

Catatan: Gunakan bq mk untuk membuat resource BigQuery. Switch command line --table digunakan untuk membuat tabel. Untuk informasi selengkapnya tentang membuat tabel dengan definisi skema menggunakan alat command line bq, baca panduan Membuat dan menggunakan tabel.

Anda dapat membuka BigQuery di Konsol Cloud dan memeriksa skema tabel di set data invoice_parser_results menggunakan ruang kerja BigQuery SQL.

Membuat resource Google Cloud

Tugas 4. Men-deploy fungsi Cloud Run pemrosesan dokumen

Untuk menyelesaikan tugas ini, Anda harus men-deploy fungsi Cloud Run yang digunakan pipeline pemrosesan data Anda untuk memproses invoice yang diupload ke Cloud Storage. Fungsi ini akan menggunakan pemroses Generic Form Document AI API untuk mengekstrak data formulir dari dokumen mentah.

Anda dapat memeriksa kode sumber fungsi Cloud Run menggunakan Code Editor atau editor lain pilihan Anda. Fungsi Cloud Run disimpan di folder berikut di Cloud Shell:

- Process Invoices -

scripts/cloud-functions/process-invoices

Fungsi Cloud Run, process-invoices, harus dipicu saat file diupload ke bucket penyimpanan file input yang Anda buat sebelumnya.

Men-deploy fungsi Cloud Run untuk memproses dokumen yang diupload ke Cloud Storage

Men-deploy fungsi Cloud Run yang menggunakan pemroses formulir Document AI untuk mengurai dokumen formulir yang telah diupload ke bucket Cloud Storage.

- Buka direktori

scripts:

cd ~/document-ai-challenge/scripts

- Tetapkan peran Artifact Registry Reader ke akun layanan Compute Engine:

PROJECT_ID=$(gcloud config get-value project)

PROJECT_NUMBER=$(gcloud projects list --filter="project_id:$PROJECT_ID" --format='value(project_number)')

SERVICE_ACCOUNT=$(gcloud storage service-agent --project=$PROJECT_ID)

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member serviceAccount:$SERVICE_ACCOUNT \

--role roles/pubsub.publisher

- Deploy fungsi Cloud Run:

export CLOUD_FUNCTION_LOCATION={{{ project_0.default_region | "REGION" }}}

gcloud functions deploy process-invoices \

--gen2 \

--region=${CLOUD_FUNCTION_LOCATION} \

--entry-point=process_invoice \

--runtime=python313 \

--service-account=${PROJECT_ID}@appspot.gserviceaccount.com \

--source=cloud-functions/process-invoices \

--timeout=400 \

--env-vars-file=cloud-functions/process-invoices/.env.yaml \

--trigger-resource=gs://${PROJECT_ID}-input-invoices \

--trigger-event=google.storage.object.finalize\

--service-account $PROJECT_NUMBER-compute@developer.gserviceaccount.com \

--allow-unauthenticated

Catatan: Jika Anda mendapatkan error izin saat men-deploy fungsi, tunggu 2-3 menit, lalu jalankan kembali perintah.

Jika Anda memeriksa kode sumber Cloud Run Functions, Anda akan melihat bahwa fungsi tersebut mendapatkan detail pemroses Document AI melalui dua variabel lingkungan runtime.

- Anda harus mengonfigurasi ulang deployment fungsi Cloud Run agar variabel lingkungan

PROCESSOR_ID dan PARSER_LOCATION berisi nilai yang benar untuk pemroses Form Parser yang Anda deploy pada langkah sebelumnya.

- Pastikan nilai PARSER_LOCATION

harus dalam huruf kecil.

- Pastikan untuk juga memperbarui variabel lingkungan

PROJECT_ID dengan project ID Anda.

Tunggu hingga fungsi di-deploy ulang sepenuhnya.

Men-deploy fungsi Cloud Run Pemrosesan Dokumen

Tugas 5. Menguji dan memvalidasi solusi end-to-end

Untuk tugas terakhir, Anda harus berhasil memproses serangkaian invoice yang tersedia di folder ~/document-ai-challenge/invoices menggunakan pipeline Anda.

-

Upload invoice ini ke bucket Cloud Storage input dan pantau progres pipeline-nya.

-

Amati peristiwa hingga Anda melihat peristiwa akhir yang menunjukkan bahwa eksekusi fungsi selesai dengan status OK.

Setelah pipeline memproses dokumen sepenuhnya, Anda akan melihat bahwa informasi formulir yang diekstrak dari invoice oleh pemroses Document AI telah ditulis ke dalam Tabel BigQuery.

Catatan: Untuk memantau progres, klik Logs di bagian Management Cloud Run Functions untuk melihat log.

Catatan: Anda mungkin melihat beberapa error yang tidak terlalu memengaruhi pemrosesan dokumen, terutama waktu tunggu, di lab ini. Jika Anda tidak melihat data dilaporkan sebagai data yang ditulis ke BigQuery, periksa kembali apakah parameter yang ditetapkan di tab Variables & Secrets Konsol Cloud Run sudah benar, lalu coba lagi.

Secara khusus, pastikan variabel ID Pemroses dan lokasi yang Anda tetapkan valid dan perhatikan bahwa parameter lokasi harus menggunakan huruf kecil.

Perhatikan juga bahwa daftar peristiwa tidak otomatis diperbarui.

Memvalidasi data yang diproses oleh pipeline

Selamat!

Selamat! Di lab ini, Anda telah berhasil membuat pipeline pemrosesan dokumen yang secara otomatis memproses dokumen yang diupload ke Cloud Storage menggunakan Document AI API. Anda telah membuat pemroses formulir, men-deploy fungsi Cloud Run untuk memproses dokumen, dan memvalidasi solusi end-to-end dengan memproses serangkaian invoice.

Sertifikasi dan pelatihan Google Cloud

...membantu Anda mengoptimalkan teknologi Google Cloud. Kelas kami mencakup keterampilan teknis dan praktik terbaik untuk membantu Anda memahami dengan cepat dan melanjutkan proses pembelajaran. Kami menawarkan pelatihan tingkat dasar hingga lanjutan dengan opsi on demand, live, dan virtual untuk menyesuaikan dengan jadwal Anda yang sibuk. Sertifikasi membantu Anda memvalidasi dan membuktikan keterampilan serta keahlian Anda dalam teknologi Google Cloud.

Manual Terakhir Diperbarui pada 14 November 2025

Lab Terakhir Diuji pada 14 November 2025

Hak cipta 2026 Google LLC. Semua hak dilindungi undang-undang. Google dan logo Google adalah merek dagang dari Google LLC. Semua nama perusahaan dan produk lain mungkin adalah merek dagang masing-masing perusahaan yang bersangkutan.