GSP367

Übersicht

In einem Challenge-Lab geht es um ein bestimmtes Szenario mit mehreren Aufgaben. Anders als bei einem normalen Lab erhalten Sie jedoch keine Schritt-für-Schritt-Anleitung, sondern nutzen die in den Labs des jeweiligen Kurses erlernten Fähigkeiten, um die Aufgaben selbst zu lösen. Ihre Lösungen werden automatisch bewertet. Die erzielten Punkte finden Sie rechts oben auf dieser Seite.

In Challenge-Labs werden keine neuen Grundlagen zu Google Cloud vermittelt. Sie sollen dabei Ihr Wissen erweitern und es wird erwartet, dass Sie beispielsweise Standardwerte ändern und Fehlermeldungen lesen und recherchieren, um Ihre eigenen Fehler zu beheben.

Die volle Punktzahl erreichen Sie nur, wenn Sie alle Aufgaben innerhalb der vorgegebenen Zeit lösen.

Dieses Lab wird allen empfohlen, die sich für den Skill-Logo-Kurs Datenerfassung mit Document AI automatisieren angemeldet haben. Sind Sie bereit?

Das Szenario

Sie sind Data Engineer bei einem großen Unternehmen für Infrastrukturmanagement und sollen an einem internen Projekt mit der Finanzabteilung des Unternehmens mitarbeiten. Das Unternehmen sieht sich mit einem steigenden Volumen von Dokumenten konfrontiert, die alle einzeln manuell validiert und autorisiert werden müssen. Das ist kostspielig und bindet viel Personal. Daher plant das Unternehmen, mithilfe der Google Cloud-Tools die Erfassung, Kategorisierung und Verifizierung der Dokumente zu automatisieren und den Prozess dadurch effizienter sowie weniger arbeitsintensiv zu gestalten.

Die Aufgabe

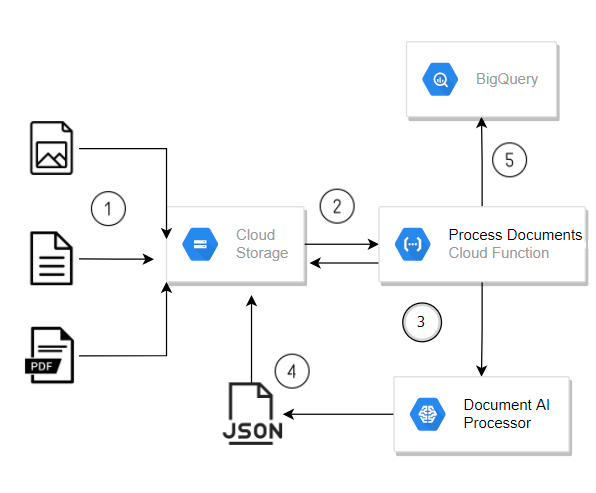

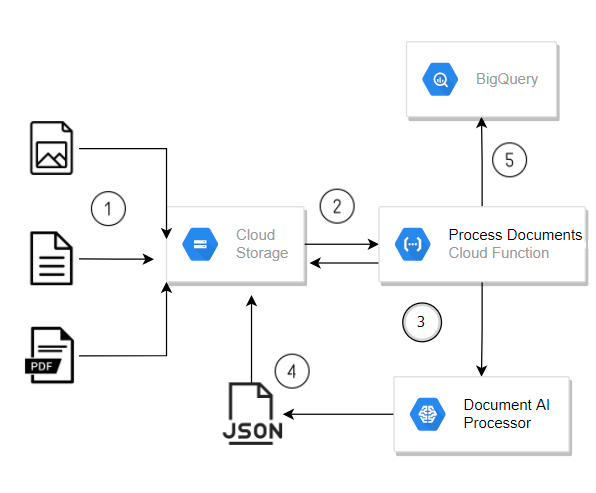

Sie müssen eine Pipeline zur Dokumentenverarbeitung erstellen, die in Cloud Storage hochgeladene Dokumente automatisch verarbeitet. Die Pipeline besteht aus einer primären Cloud Run-Funktion, die neue Dateien mithilfe eines Document AI-Formularprozessors verarbeitet und dabei Daten aus den Dokumenten extrahiert. Die Funktion speichert die in den Dateien erkannten Formulardaten anschließend in BigQuery.

Sie erhalten den Quellcode für eine Cloud Run-Funktion, die die Verarbeitung durchführt. Darauf aufbauend sollen Sie die Dokumentenverarbeitungspipeline wie in der Architektur unten dargestellt bereitstellen und dabei sicherstellen, dass die Komponenten passend zu Ihrer spezifischen Pipeline konfiguriert werden.

Aufgabe 1: Cloud Document AI API aktivieren und Quelldateien für das Lab kopieren

In dieser Aufgabe aktivieren Sie die Cloud Document AI API und kopieren Ihre Startdateien in die Cloud Shell.

Cloud Document AI API aktivieren

- Aktivieren Sie die Cloud Document AI API.

Cloud Document AI API aktivieren

Quelldateien für das Lab in die Cloud Shell kopieren

Die Cloud Run-Funktion mit dem vordefinierten Code wird in einem Remote-Bucket in Cloud Storage gehostet. Kopieren Sie die Quelldateien in Ihre Cloud Shell. Die Dateien enthalten den Quellcode für die Cloud Run-Funktion und das Schema für die BigQuery-Tabelle, die Sie im Lab erstellen.

- Geben Sie in der Cloud Shell den folgenden Befehl ein, um das Quell-Repository für das Lab zu klonen:

mkdir ./document-ai-challenge

gsutil -m cp -r gs://spls/gsp367/* \

~/document-ai-challenge/

Aufgabe 2: Formularprozessor erstellen

Erstellen Sie eine Instanz des allgemeinen Formularprozessors mithilfe des Document AI-Prozessors Form Parser im Abschnitt Allgemein (nicht spezialisiert). Der allgemeine Formularprozessor verarbeitet jedes beliebige Dokument und extrahiert sämtliche Textinhalte, die er erkennt, sowie Formularinformationen, die er aus dem Layout ableitet.

- Erstellen Sie den Prozessor mit den folgenden Konfigurationsdetails:

| Eigenschaft |

Wert |

| Prozessortyp |

Form Parser |

| Prozessorname |

|

| Region |

USA |

Hinweis: Später in diesem Lab konfigurieren Sie eine Cloud Run-Funktion mit den Variablenwerten für PROCESSOR ID und PARSER LOCATION dieses Prozessors, damit die Cloud Run-Funktion genau diesen Prozessor zum Verarbeiten der Rechnungen verwendet. Klicken Sie auf den erstellten Prozessor und notieren Sie sich den Wert unter „PROCESSOR ID“. Die Region des Prozessors ist der Wert unter „PARSER LOCATION“.

Formularprozessor erstellen

Aufgabe 3: Google Cloud-Ressourcen erstellen

Bereiten Sie Ihre Umgebung vor, indem Sie die Google Cloud Storage- und BigQuery-Ressourcen erstellen, die für Ihre Dokumentenverarbeitungspipeline erforderlich sind.

Cloud Storage-Buckets für Eingang, Ausgang und Archiv erstellen

- In diesem Schritt müssen Sie die drei unten aufgeführten Cloud Storage-Buckets mit jeweils einheitlichen Zugriffsrechten auf Bucket-Ebene erstellen.

| Bucket-Name |

Zweck |

Speicherklasse |

Standort |

|

Speicher für Eingangsrechnungen |

Standard |

|

|

Speicher für verarbeitete Daten |

Standard |

|

|

Archiv für Rechnungen |

Standard |

|

Hinweis: Buckets können mit dem Tool „gsutil“ und dem Parameter -mb erstellt werden. Mit dem Parameter -c wird zusätzlich die Speicherklasse festgelegt, mit -l der (regionale) Standort. Das Flag -b mit den Werten „on“ und „off“ definiert einheitliche Zugriffsrechte auf Bucket-Ebene. Weitere Informationen zum Erstellen von Buckets mit „gsutil“ finden Sie in der Referenz zum Befehl „mb“ für die Erstellung von Buckets.

BigQuery-Dataset und ‑Tabellen erstellen

- In diesem Schritt müssen Sie ein BigQuery-Dataset und die für Ihre Datenverarbeitungspipeline erforderliche Ausgabetabelle erstellen.

Dataset

| Dataset-Name |

Standort |

| invoice_parser_results |

USA |

Hinweis: Verwenden Sie bq mk, um BigQuery-Ressourcen zu erstellen. Mit dem Befehlszeilenparameter -d wird ein Dataset erstellt und mit --location der Standort der Ressource festgelegt. Weitere Informationen zum Erstellen von Datasets mit dem Befehlszeilentool „bq“ finden Sie in der Anleitung Datasets erstellen.

Tabelle

Das Tabellenschema für die extrahierten Informationen finden Sie in der JSON-Datei document-ai-challenge/scripts/table-schema/doc_ai_extracted_entities.json. Nutzen Sie dieses Schema, um eine Tabelle mit dem Namen doc_ai_extracted_entities im Dataset invoice_parser_results zu erstellen.

Hinweis: Verwenden Sie bq mk, um BigQuery-Ressourcen zu erstellen. Mit dem Befehlszeilenparameter --table wird eine Tabelle erstellt. Weitere Informationen zum Erstellen von Tabellen mit einer Schemadefinition über das Befehlszeilentool „bq“ finden Sie im Leitfaden Tabellen erstellen und verwenden.

Sie können in der Cloud Console zu BigQuery wechseln und das Schema der Tabellen im Dataset invoice_parser_results im BigQuery SQL-Arbeitsbereich überprüfen.

Google Cloud-Ressourcen erstellen

Aufgabe 4: Cloud Run-Funktion für die Dokumentenverarbeitung bereitstellen

In dieser Aufgabe müssen Sie die Cloud Run-Funktion bereitstellen, die von Ihrer Datenverarbeitungspipeline zum Verarbeiten von in Cloud Storage hochgeladenen Rechnungen verwendet wird. Diese Funktion nutzt einen generischen Formularprozessor der Document AI API, um Formulardaten aus den Rohdokumenten zu extrahieren.

Sie können den Quellcode der Cloud Run-Funktion im Code-Editor oder einem anderen Editor Ihrer Wahl durchgehen. Die Cloud Run-Funktion wird in der Cloud Shell in den folgenden Ordnern gespeichert:

- Rechnungen verarbeiten:

scripts/cloud-functions/process-invoices

Die Cloud Run-Funktion process-invoices muss ausgelöst werden, sobald Dateien in den Speicher-Bucket für Eingangsdateien hochgeladen werden, den Sie vorhin erstellt haben.

Cloud Run-Funktion zur Verarbeitung der in Cloud Storage hochgeladenen Dokumente bereitstellen

Stellen Sie eine Cloud Run-Funktion bereit, die einen Document AI-Formularprozessor verwendet, um in einen Cloud Storage-Bucket hochgeladene Formulardokumente zu parsen.

- Rufen Sie das Verzeichnis

scripts auf:

cd ~/document-ai-challenge/scripts

- Weisen Sie dem Compute Engine-Dienstkonto die Rolle „Artifact Registry Reader“ zu:

PROJECT_ID=$(gcloud config get-value project)

PROJECT_NUMBER=$(gcloud projects list --filter="project_id:$PROJECT_ID" --format='value(project_number)')

SERVICE_ACCOUNT=$(gcloud storage service-agent --project=$PROJECT_ID)

gcloud projects add-iam-policy-binding $PROJECT_ID \

--member serviceAccount:$SERVICE_ACCOUNT \

--role roles/pubsub.publisher

- Stellen Sie die Cloud Run-Funktion bereit:

export CLOUD_FUNCTION_LOCATION={{{ project_0.default_region | "REGION" }}}

gcloud functions deploy process-invoices \

--gen2 \

--region=${CLOUD_FUNCTION_LOCATION} \

--entry-point=process_invoice \

--runtime=python313 \

--service-account=${PROJECT_ID}@appspot.gserviceaccount.com \

--source=cloud-functions/process-invoices \

--timeout=400 \

--env-vars-file=cloud-functions/process-invoices/.env.yaml \

--trigger-resource=gs://${PROJECT_ID}-input-invoices \

--trigger-event=google.storage.object.finalize\

--service-account $PROJECT_NUMBER-compute@developer.gserviceaccount.com \

--allow-unauthenticated

Hinweis: Wenn beim Bereitstellen der Funktion ein Berechtigungsfehler gemeldet wird, warten Sie 2–3 Minuten und führen Sie die Befehle noch einmal aus.

Wenn Sie sich den Quellcode der Cloud Run-Funktion ansehen, wird Ihnen auffallen, dass die Funktion die Details des Document AI-Prozessors über zwei Laufzeitumgebungsvariablen abruft.

- Sie müssen das Deployment der Cloud-Funktion neu konfigurieren, damit die Umgebungsvariablen

PROCESSOR_ID und PARSER_LOCATION die richtigen Werte für den Form Parser-Prozessor enthalten, den Sie in einem der vorherigen Schritte bereitgestellt haben.

- Der Wert von PARSER_LOCATION muss

in Kleinbuchstaben geschrieben werden.

- Achten Sie darauf, dass Sie auch die Umgebungsvariable

PROJECT_ID mit Ihrer Projekt-ID aktualisieren.

Warten Sie, bis die Funktion vollständig erneut bereitgestellt wurde.

Cloud Run-Funktion für die Dokumentverarbeitung bereitstellen

Aufgabe 5: End-to-End-Lösung testen und validieren

Für die letzte Aufgabe müssen Sie die Rechnungen im Ordner ~/document-ai-challenge/invoices erfolgreich mit Ihrer Pipeline verarbeiten.

-

Laden Sie die Rechnungen in den als Eingang eingerichteten Cloud Storage-Bucket hoch und beobachten Sie den Fortschritt der Pipeline.

-

Beobachten Sie die Pipeline weiter, bis das letzte Ereignis meldet, dass die Funktionsausführung mit dem Status OK abgeschlossen wurde.

Sobald die Pipeline die Dokumente vollständig verarbeitet hat, werden die Formularinformationen, die vom Document AI-Prozessor aus den Rechnungen extrahiert wurden, in die BigQuery-Tabelle geschrieben.

Hinweis: Klicken Sie im Abschnitt „Verwaltung“ der Cloud Run-Funktion auf Logs, um die Logs aufzurufen und den Fortschritt zu beobachten.

Hinweis: In diesem Lab werden möglicherweise einige Fehler angezeigt, die die Dokumentenverarbeitung nicht wesentlich beeinträchtigen, insbesondere Zeitüberschreitungen. Sollte nicht gemeldet werden, dass Daten in BigQuery geschrieben werden, überprüfen Sie, ob die in der Cloud Run Console auf dem Tab Variablen und Secrets festgelegten Parameter korrekt sind. Versuchen Sie es dann noch einmal.

Achten Sie insbesondere darauf, dass die von Ihnen festgelegten Variablen für die Prozessor-ID und den Standort gültig sind. Der Standortparameter muss in Kleinbuchstaben angegeben werden.

Die Ereignisliste wird nicht automatisch aktualisiert.

Von der Pipeline verarbeitete Daten validieren

Geschafft!

Sie haben das Lab erfolgreich absolviert. Dabei haben Sie eine Pipeline zur Dokumentenverarbeitung erstellt, die in Cloud Storage hochgeladene Dokumente automatisch mithilfe der Document AI API verarbeitet. Sie haben einen Formularprozessor erstellt, eine Cloud Run-Funktion zur Verarbeitung der Dokumente bereitgestellt und zur Validierung der End-to-End-Lösung eine Reihe von Rechnungen verarbeiten lassen.

Google Cloud-Schulungen und -Zertifizierungen

In unseren Schulungen erfahren Sie alles zum optimalen Einsatz unserer Google Cloud-Technologien und können sich entsprechend zertifizieren lassen. Unsere Kurse vermitteln technische Fähigkeiten und Best Practices, damit Sie möglichst schnell mit Google Cloud loslegen und Ihr Wissen fortlaufend erweitern können. Wir bieten On-Demand-, Präsenz- und virtuelle Schulungen für Anfänger wie Fortgeschrittene an, die Sie individuell in Ihrem eigenen Zeitplan absolvieren können. Mit unseren Zertifizierungen weisen Sie nach, dass Sie Experte im Bereich Google Cloud-Technologien sind.

Anleitung zuletzt aktualisiert am 14. November 2025

Lab zuletzt getestet am 14. November 2025

© 2026 Google LLC. Alle Rechte vorbehalten. Google und das Google-Logo sind Marken von Google LLC. Alle anderen Unternehmens- und Produktnamen können Marken der jeweils mit ihnen verbundenen Unternehmen sein.