GSP075

Übersicht

In diesem Lab untersuchen wir die Möglichkeiten des maschinellen Lernens, indem wir mehrere APIs zum maschinellen Lernen zusammen verwenden. Wir beginnen mit der Texterkennung der Cloud Vision API, um Text mithilfe der optischen Zeichenerkennung (Optical Character Recognition, OCR) aus Bildern zu extrahieren. Anschließend lernen wir, wie dieser Text mit der Translation API übersetzt und mit der Natural Language API analysiert wird.

Ziele

Aufgaben in diesem Lab:

- Eine Cloud Vision API-Anfrage erstellen und die API mit curl aufrufen

- Texterkennung (OCR) der Vision API verwenden

- Bildtext mithilfe der Translation API übersetzen

- Mit der Natural Language API Texte analysieren

Einrichtung und Anforderungen

Vor dem Klick auf „Start Lab“ (Lab starten)

Lesen Sie diese Anleitung. Labs sind zeitlich begrenzt und können nicht pausiert werden. Der Timer beginnt zu laufen, wenn Sie auf Lab starten klicken, und zeigt Ihnen, wie lange Google Cloud-Ressourcen für das Lab verfügbar sind.

In diesem praxisorientierten Lab können Sie die Lab-Aktivitäten in einer echten Cloud-Umgebung durchführen – nicht in einer Simulations- oder Demo-Umgebung. Dazu erhalten Sie neue, temporäre Anmeldedaten, mit denen Sie für die Dauer des Labs auf Google Cloud zugreifen können.

Für dieses Lab benötigen Sie Folgendes:

- Einen Standardbrowser (empfohlen wird Chrome)

Hinweis: Nutzen Sie den privaten oder Inkognitomodus (empfohlen), um dieses Lab durchzuführen. So wird verhindert, dass es zu Konflikten zwischen Ihrem persönlichen Konto und dem Teilnehmerkonto kommt und zusätzliche Gebühren für Ihr persönliches Konto erhoben werden.

- Zeit für die Durchführung des Labs – denken Sie daran, dass Sie ein begonnenes Lab nicht unterbrechen können.

Hinweis: Verwenden Sie für dieses Lab nur das Teilnehmerkonto. Wenn Sie ein anderes Google Cloud-Konto verwenden, fallen dafür möglicherweise Kosten an.

Lab starten und bei der Google Cloud Console anmelden

-

Klicken Sie auf Lab starten. Wenn Sie für das Lab bezahlen müssen, wird ein Dialogfeld geöffnet, in dem Sie Ihre Zahlungsmethode auswählen können.

Auf der linken Seite befindet sich der Bereich „Details zum Lab“ mit diesen Informationen:

- Schaltfläche „Google Cloud Console öffnen“

- Restzeit

- Temporäre Anmeldedaten für das Lab

- Ggf. weitere Informationen für dieses Lab

-

Klicken Sie auf Google Cloud Console öffnen (oder klicken Sie mit der rechten Maustaste und wählen Sie Link in Inkognitofenster öffnen aus, wenn Sie Chrome verwenden).

Im Lab werden Ressourcen aktiviert. Anschließend wird ein weiterer Tab mit der Seite „Anmelden“ geöffnet.

Tipp: Ordnen Sie die Tabs nebeneinander in separaten Fenstern an.

Hinweis: Wird das Dialogfeld Konto auswählen angezeigt, klicken Sie auf Anderes Konto verwenden.

-

Kopieren Sie bei Bedarf den folgenden Nutzernamen und fügen Sie ihn in das Dialogfeld Anmelden ein.

{{{user_0.username | "Username"}}}

Sie finden den Nutzernamen auch im Bereich „Details zum Lab“.

-

Klicken Sie auf Weiter.

-

Kopieren Sie das folgende Passwort und fügen Sie es in das Dialogfeld Willkommen ein.

{{{user_0.password | "Password"}}}

Sie finden das Passwort auch im Bereich „Details zum Lab“.

-

Klicken Sie auf Weiter.

Wichtig: Sie müssen die für das Lab bereitgestellten Anmeldedaten verwenden. Nutzen Sie nicht die Anmeldedaten Ihres Google Cloud-Kontos.

Hinweis: Wenn Sie Ihr eigenes Google Cloud-Konto für dieses Lab nutzen, können zusätzliche Kosten anfallen.

-

Klicken Sie sich durch die nachfolgenden Seiten:

- Akzeptieren Sie die Nutzungsbedingungen.

- Fügen Sie keine Wiederherstellungsoptionen oder Zwei-Faktor-Authentifizierung hinzu (da dies nur ein temporäres Konto ist).

- Melden Sie sich nicht für kostenlose Testversionen an.

Nach wenigen Augenblicken wird die Google Cloud Console in diesem Tab geöffnet.

Hinweis: Wenn Sie auf Google Cloud-Produkte und ‑Dienste zugreifen möchten, klicken Sie auf das Navigationsmenü oder geben Sie den Namen des Produkts oder Dienstes in das Feld Suchen ein.

Cloud Shell aktivieren

Cloud Shell ist eine virtuelle Maschine, auf der Entwicklertools installiert sind. Sie bietet ein Basisverzeichnis mit 5 GB nichtflüchtigem Speicher und läuft auf Google Cloud. Mit Cloud Shell erhalten Sie Befehlszeilenzugriff auf Ihre Google Cloud-Ressourcen.

-

Klicken Sie oben in der Google Cloud Console auf Cloud Shell aktivieren  .

.

-

Klicken Sie sich durch die folgenden Fenster:

- Fahren Sie mit dem Informationsfenster zu Cloud Shell fort.

- Autorisieren Sie Cloud Shell, Ihre Anmeldedaten für Google Cloud API-Aufrufe zu verwenden.

Wenn eine Verbindung besteht, sind Sie bereits authentifiziert und das Projekt ist auf Project_ID, eingestellt. Die Ausgabe enthält eine Zeile, in der die Project_ID für diese Sitzung angegeben ist:

Ihr Cloud-Projekt in dieser Sitzung ist festgelegt als {{{project_0.project_id | "PROJECT_ID"}}}

gcloud ist das Befehlszeilentool für Google Cloud. Das Tool ist in Cloud Shell vorinstalliert und unterstützt die Tab-Vervollständigung.

- (Optional) Sie können den aktiven Kontonamen mit diesem Befehl auflisten:

gcloud auth list

- Klicken Sie auf Autorisieren.

Ausgabe:

ACTIVE: *

ACCOUNT: {{{user_0.username | "ACCOUNT"}}}

Um das aktive Konto festzulegen, führen Sie diesen Befehl aus:

$ gcloud config set account `ACCOUNT`

- (Optional) Sie können die Projekt-ID mit diesem Befehl auflisten:

gcloud config list project

Ausgabe:

[core]

project = {{{project_0.project_id | "PROJECT_ID"}}}

Hinweis: Die vollständige Dokumentation für gcloud finden Sie in Google Cloud in der Übersicht zur gcloud CLI.

Aufgabe 1: API-Schlüssel erstellen

Da Sie die Anfragen an die Vision API über curl senden, müssen Sie einen API-Schlüssel generieren, um die Anfrage-URL zu übergeben.

-

Klicken Sie zum Erstellen eines API-Schlüssels auf das Navigationsmenü > APIs und Dienste > Anmeldedaten.

-

Klicken Sie auf + Anmeldedaten erstellen.

-

Wählen Sie im Drop-down-Menü API-Schlüssel aus.

-

Kopieren Sie dann den gerade erstellten Schlüssel und klicken Sie auf Schließen.

-

Speichern Sie den API-Schlüssel in einer Umgebungsvariablen, damit Sie dessen Wert nicht in jede Anfrage einfügen müssen.

-

Führen Sie in Cloud Shell den folgenden Befehl aus und ersetzen Sie dabei <your_api_key> durch den soeben kopierten Schlüssel:

export API_KEY=<YOUR_API_KEY>

Klicken Sie auf Fortschritt prüfen.

API-Schlüssel erstellen

Aufgabe 2: Bild in einen Cloud Storage-Bucket hochladen

Cloud Storage-Bucket erstellen

Es gibt zwei Möglichkeiten, ein Bild zur Bilderkennung an die Vision API zu senden: Entweder Sie senden der API einen Base64-codierten Bildstring oder Sie übergeben die URL einer in Cloud Storage gespeicherten Datei. In diesem Lab erstellen Sie einen Cloud Storage-Bucket zum Speichern der Bilder.

-

Gehen Sie in der Console zum Navigationsmenü > Cloud Storage-Browser und klicken Sie auf Bucket erstellen.

-

Geben Sie Ihrem Bucket einen eindeutigen Namen: -Bucket.

-

Klicken Sie anschließend auf Legen Sie fest, wie der Zugriff auf Objekte gesteuert wird.

-

Entfernen Sie das Häkchen bei Verhinderung des öffentlichen Zugriffs für diesen Bucket erzwingen.

-

Wählen Sie unter „Zugriffssteuerung“ die Option Detailgenau aus und klicken Sie auf Erstellen.

Bild in den Bucket hochladen

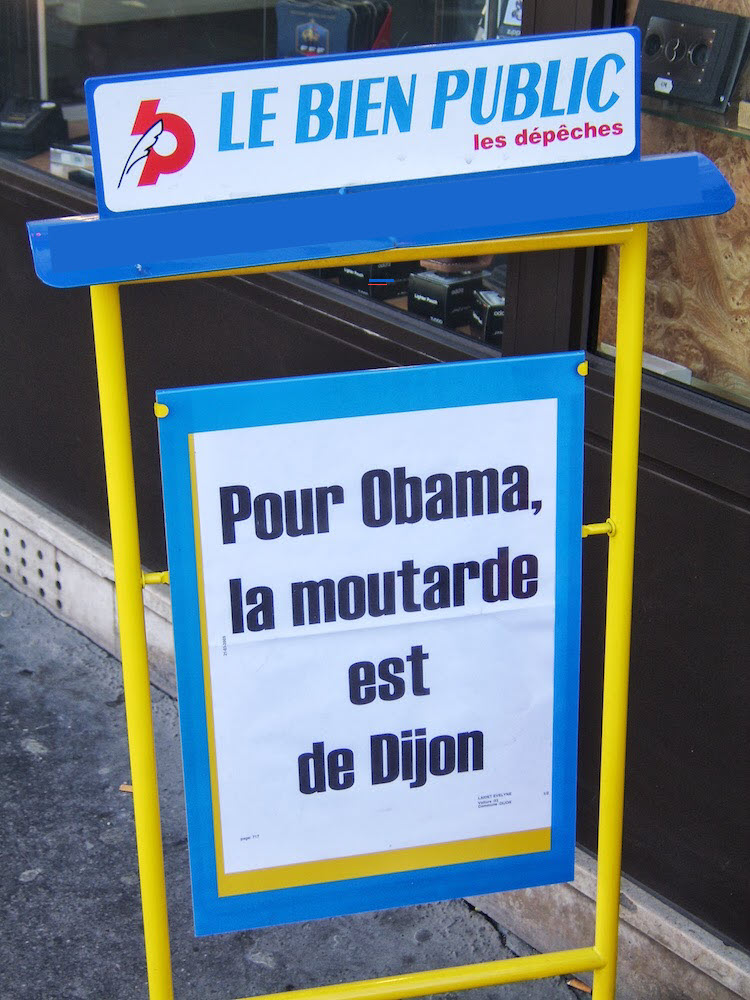

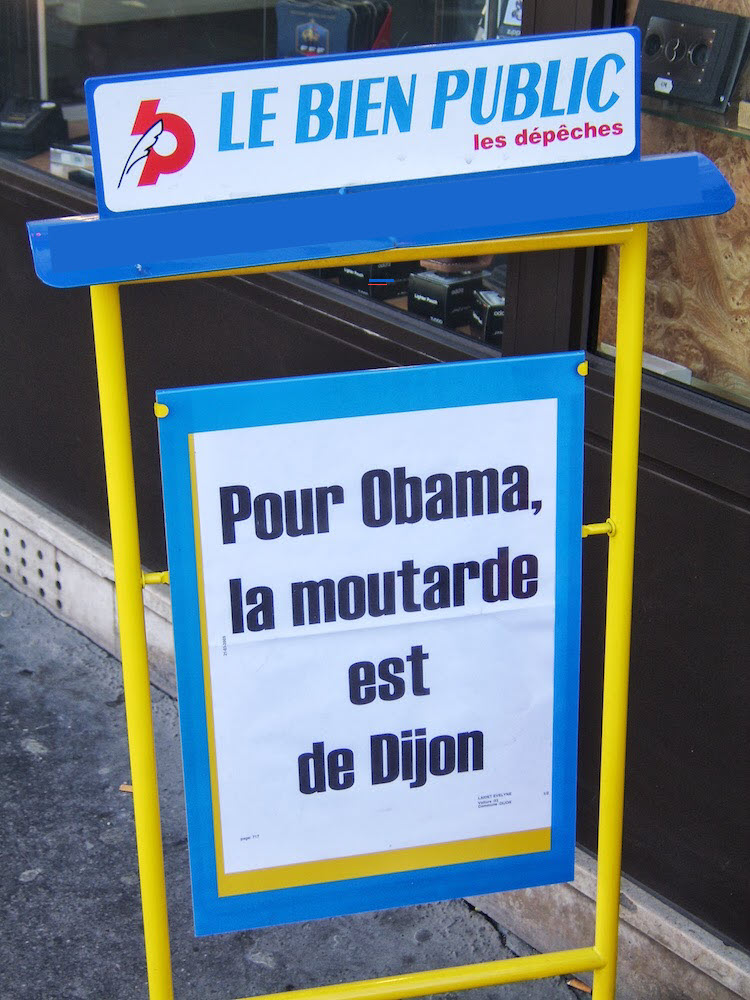

- Klicken Sie mit der rechten Maustaste auf das folgende Bild eines französischen Schildes. Klicken Sie dann auf Bild speichern unter und speichern Sie es als sign.jpg auf Ihrem Computer.

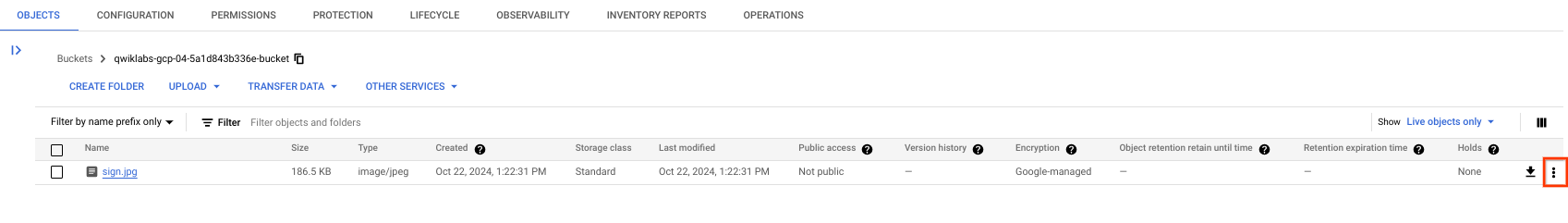

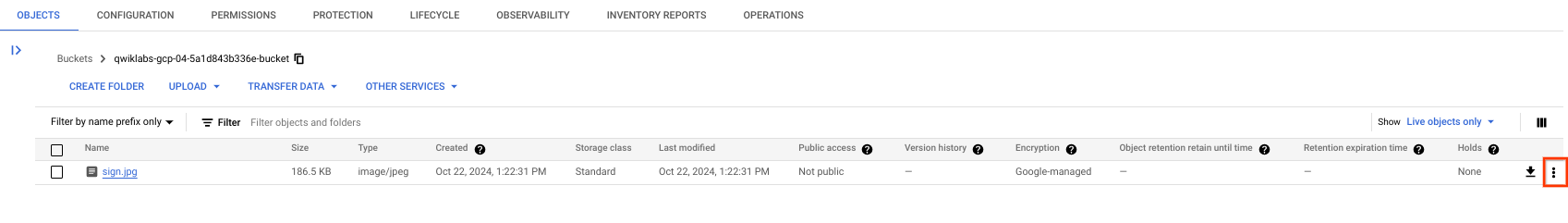

- Gehen Sie zu dem Bucket, den Sie gerade im Cloud Storage-Browser erstellt haben, und klicken Sie auf Hochladen > Dateien hochladen. Wählen Sie dann sign.jpg aus.

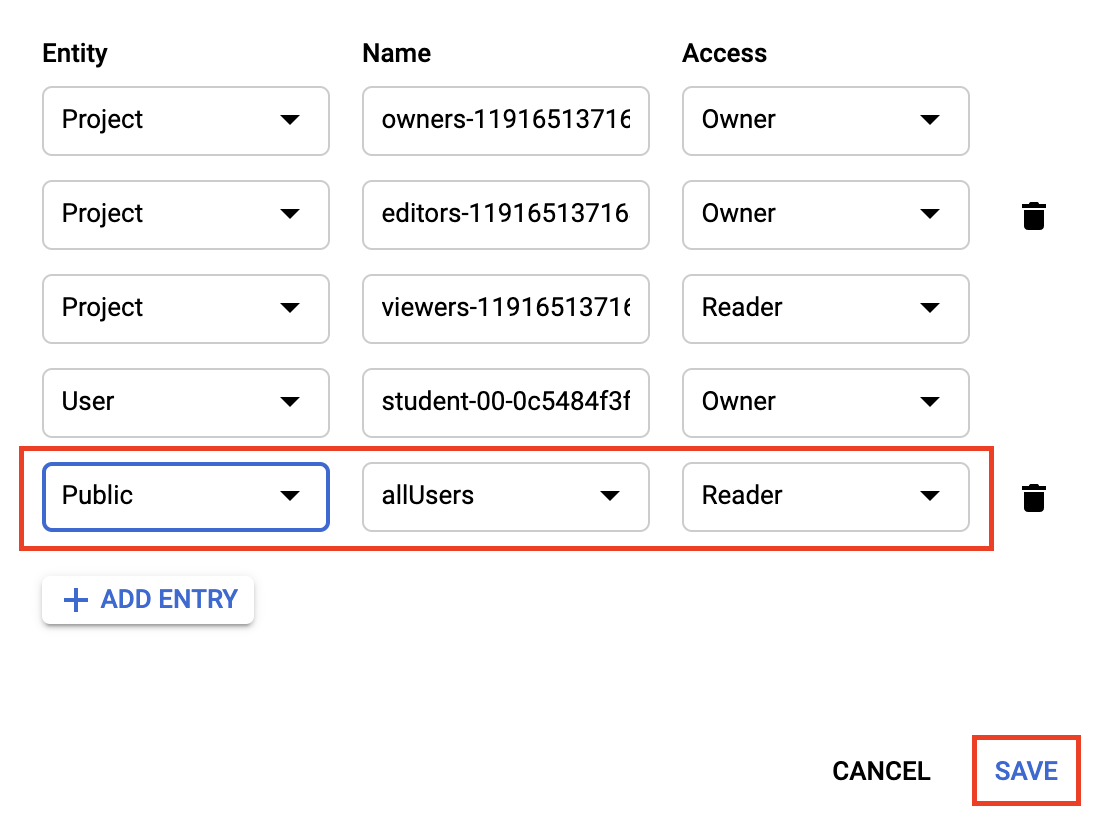

Erlauben Sie dann, dass die Datei öffentlich zugänglich ist, während der Zugriff auf den Bucket privat bleibt.

- Klicken Sie auf die drei Punkte für die Bilddatei:

-

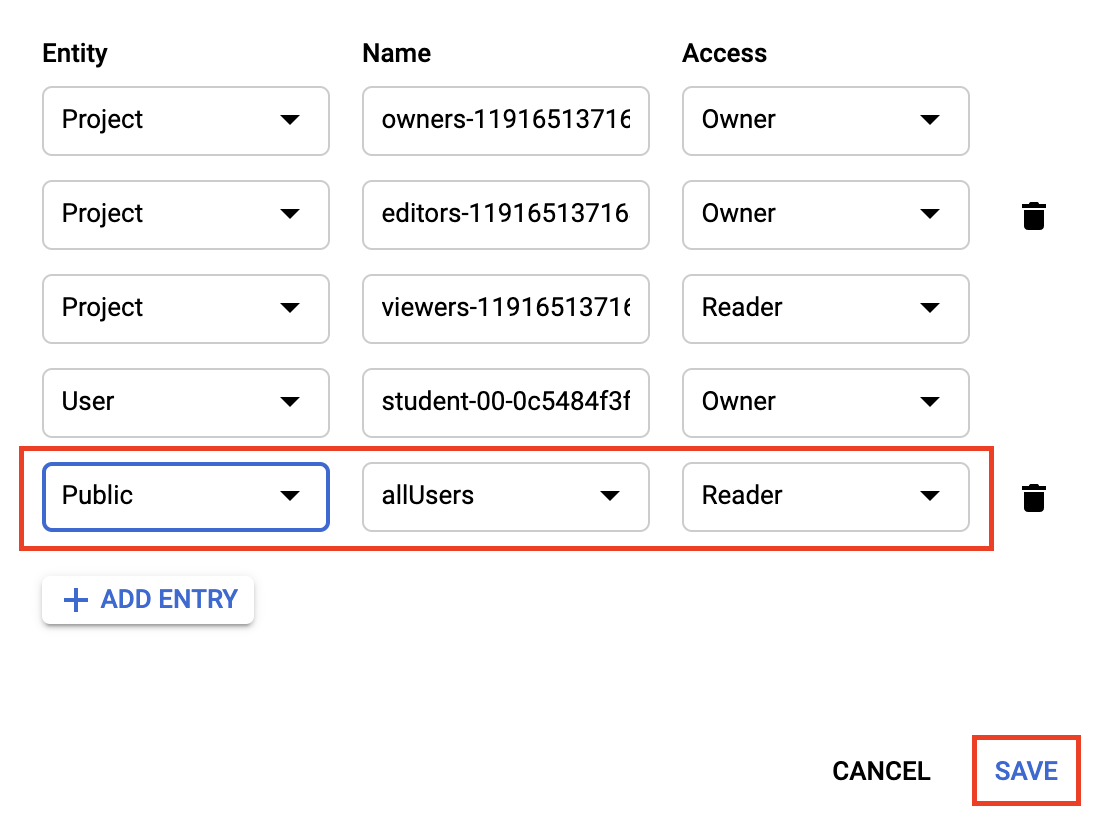

Wählen Sie Zugriff bearbeiten aus.

-

Klicken Sie auf Eintrag hinzufügen und legen Sie Folgendes fest:

- Wählen Sie für die Entität die Option Öffentlich aus.

- Achten Sie darauf, dass allUsers als Name angegeben ist.

- Wählen Sie Reader für den Zugriff aus.

- Klicken Sie auf Speichern.

Sie sehen nun, dass die Datei öffentlich zugänglich ist.

Nachdem Sie die Datei in Ihren Bucket hochgeladen haben, können Sie eine Vision API-Anfrage erstellen und die URL dieses Bildes übergeben.

Klicken Sie auf Fortschritt prüfen.

Bild in einen Bucket hochladen

Aufgabe 3: Cloud Vision API-Anfrage erstellen

- Erstellen Sie in der Cloud Shell-Umgebung

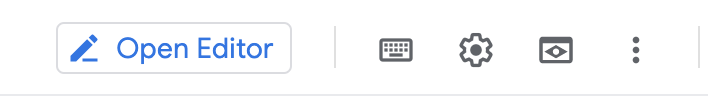

ocr-request.json und fügen Sie den folgenden Code zu der Datei hinzu. Ersetzen Sie dabei my-bucket-name durch den Namen des von Ihnen erstellten Buckets. Sie können die Datei mit dem Befehlszeilen-Editor Ihrer Wahl (nano, vim, emacs) erstellen. Alternativ klicken Sie auf das Stiftsymbol, um den Code-Editor in Cloud Shell zu öffnen:

- Fügen Sie Ihrer Datei

ocr-request.json Folgendes hinzu:

{

"requests": [

{

"image": {

"source": {

"gcsImageUri": "gs://my-bucket-name/sign.jpg"

}

},

"features": [

{

"type": "TEXT_DETECTION",

"maxResults": 10

}

]

}

]

}

Sie werden die Funktion TEXT_DETECTION der Cloud Vision API verwenden. Diese führt die OCR aus, um den Text aus dem Bild zu extrahieren.

Aufgabe 4: Methode zur Texterkennung aufrufen

- Rufen Sie in Cloud Shell mit

curl die Cloud Vision API auf:

curl -s -X POST -H "Content-Type: application/json" --data-binary @ocr-request.json https://vision.googleapis.com/v1/images:annotate?key=${API_KEY}

Der erste Teil Ihrer Antwort sollte folgendermaßen aussehen:

{

"responses": [

{

"textAnnotations": [

{

"locale": "fr",

"description": "LE BIEN PUBLIC\nles dépêches\nPour Obama,\nla moutarde\nest\nde Dijon\n",

"boundingPoly": {

"vertices": [

{

"x": 138,

"y": 40

},

{

"x": 622,

"y": 40

},

{

"x": 622,

"y": 795

},

{

"x": 138,

"y": 795

}

]

}

},

{

"description": "LE",

"boundingPoly": {

"vertices": [

{

"x": 138,

"y": 99

},

{

"x": 274,

"y": 82

},

{

"x": 283,

"y": 157

},

{

"x": 147,

"y": 173

}

]

}

},

{

"description": "BIEN",

"boundingPoly": {

"vertices": [

{

"x": 291,

"y": 79

},

{

"x": 413,

"y": 64

},

{

"x": 422,

"y": 139

},

{

"x": 300,

"y": 154

}

]

}

...

]

}]

}

Die OCR-Methode hat viel Text aus dem Bild herausgeholt.

Das erste Datenelement, das Sie von textAnnotations erhalten, ist der gesamte Textblock, den die API im Bild gefunden hat. Dazu zählen:

- der Sprachcode (in diesem Fall „fr“ für Französisch)

- ein Textstring

- ein Begrenzungsrahmen, der angibt, wo der Text im Bild gefunden wurde

Dann erhalten Sie ein Objekt für jedes im Text gefundene Wort mit einem Begrenzungsrahmen für dieses bestimmte Wort.

Hinweis: Für Bilder mit mehr Text bietet die Cloud Vision API auch die Funktion DOCUMENT_TEXT_DETECTION. Diese Antwort enthält zusätzliche Informationen und unterteilt den Text in Seiten, Blöcke, Absätze und Wörter.

Wenn Sie kein Französisch sprechen, verstehen Sie den Text wahrscheinlich nicht. Der nächste Schritt ist daher die Übersetzung.

- Führen Sie den folgenden

curl-Befehl aus, um die Antwort in der Datei ocr-response.json zu speichern, damit später darauf verwiesen werden kann:

curl -s -X POST -H "Content-Type: application/json" --data-binary @ocr-request.json https://vision.googleapis.com/v1/images:annotate?key=${API_KEY} -o ocr-response.json

Aufgabe 5: Text aus dem Bild an die Translation API senden

Die Translation API kann Text in über 100 Sprachen übersetzen. Sie kann auch die Sprache des eingegebenen Texts erkennen. Um den französischen Text ins Englische zu übersetzen, müssen Sie lediglich den Text und den Sprachcode für die Zielsprache (en-US) an die Translation API übergeben.

- Erstellen Sie zuerst die Datei

translation-request.json und fügen Sie Folgendes hinzu:

{

"q": "your_text_here",

"target": "en"

}

In q übergeben Sie den zu übersetzenden String.

-

Speichern Sie die Datei.

-

Führen Sie diesen Bash-Befehl in Cloud Shell aus, um den Bildtext aus dem vorherigen Schritt zu extrahieren und in eine neue Datei namens translation-request.json zu kopieren (alles in einem Befehl):

STR=$(jq .responses[0].textAnnotations[0].description ocr-response.json) && STR="${STR//\"}" && sed -i "s|your_text_here|$STR|g" translation-request.json

- Jetzt können Sie die Translation API aufrufen. Dieser Befehl kopiert auch die Antwort in eine Datei namens

translation-response.json:

curl -s -X POST -H "Content-Type: application/json" --data-binary @translation-request.json https://translation.googleapis.com/language/translate/v2?key=${API_KEY} -o translation-response.json

- Führen Sie diesen Befehl aus, um die Datei mit der Antwort der Translation API zu überprüfen:

cat translation-response.json

Jetzt wissen Sie, was auf dem Schild steht.

{

"data": {

"translations": [

{

"translatedText": "TO THE PUBLIC GOOD the dispatches For Obama, the mustard is from Dijon",

"detectedSourceLanguage": "fr"

}

]

}

}

Die Antwort sieht so aus:

-

translatedText enthält das Ergebnis der Übersetzung

-

detectedSourceLanguage lautet fr, der ISO-Sprachcode für Französisch.

Die Translation API unterstützt über 100 Sprachen, die alle hier aufgelistet sind.

Sie möchten den Text aus unserem Bild vielleicht nicht nur übersetzen, sondern noch weitere Analysen durchführen. Hier bietet sich die Natural Language API an. Weiter geht es zum nächsten Schritt.

Aufgabe 6: Bildtexte mit der Natural Language API analysieren

Die Natural Language API hilft uns, Text zu verstehen, indem Entitäten extrahiert, Stimmung und Syntax analysiert und Text in Kategorien klassifiziert werden. Mit der Methode analyzeEntities finden Sie heraus, welche Entitäten die Natural Language API im Text Ihres Bildes finden kann.

- Um die API-Anfrage einzurichten, erstellen Sie eine Datei namens

nl-request.json, die Folgendes enthält:

{

"document":{

"type":"PLAIN_TEXT",

"content":"your_text_here"

},

"encodingType":"UTF8"

}

In der Anfrage teilen Sie der Natural Language API Informationen zu dem von Ihnen gesendeten Text mit:

-

type: Unterstützt werden die Typwerte PLAIN_TEXT und HTML.

-

content: Übergeben Sie den zu analysierenden Text an die Natural Language API. Die Natural Language API unterstützt auch das Senden von Dateien aus Cloud Storage zur Textverarbeitung. Um eine Datei aus Cloud Storage zu senden, ersetzen Sie content durch gcsContentUri und verwenden den Wert des URI der Textdatei in Cloud Storage.

-

encodingType: Teilt der API mit, welche Art von Textcodierung bei der Verarbeitung des Textes verwendet werden soll. Die API berechnet damit, wo bestimmte Entitäten im Text erscheinen.

- Führen Sie diesen Bash-Befehl in Cloud Shell aus, um den übersetzten Text in den Inhaltsblock der Natural Language API-Anfrage zu kopieren:

STR=$(jq .data.translations[0].translatedText translation-response.json) && STR="${STR//\"}" && sed -i "s|your_text_here|$STR|g" nl-request.json

Die Datei nl-request.json enthält jetzt den übersetzten englischen Text aus dem Originalbild. Schauen wir uns den Text an.

- Rufen Sie mit dieser

curl-Anfrage den Endpunkt analyzeEntities der Natural Language API auf:

curl "https://language.googleapis.com/v1/documents:analyzeEntities?key=${API_KEY}" \

-s -X POST -H "Content-Type: application/json" --data-binary @nl-request.json

Wenn Sie durch die Antwort scrollen, sehen Sie die Entitäten, die die Natural Language API gefunden hat:

{

"entities": [

{

"name": "dispatches",

"type": "OTHER",

"metadata": {},

"salience": 0.3560996,

"mentions": [

{

"text": {

"content": "dispatches",

"beginOffset": 23

},

"type": "COMMON"

}

]

},

{

"name": "mustard",

"type": "OTHER",

"metadata": {},

"salience": 0.2878307,

"mentions": [

{

"text": {

"content": "mustard",

"beginOffset": 38

},

"type": "COMMON"

}

]

},

{

"name": "Obama",

"type": "PERSON",

"metadata": {

"mid": "/m/02mjmr",

"wikipedia_url": "https://en.wikipedia.org/wiki/Barack_Obama"

},

"salience": 0.16260329,

"mentions": [

{

"text": {

"content": "Obama",

"beginOffset": 31

},

"type": "PROPER"

}

]

},

{

"name": "Dijon",

"type": "LOCATION",

"metadata": {

"mid": "/m/0pbhz",

"wikipedia_url": "https://en.wikipedia.org/wiki/Dijon"

},

"salience": 0.08129317,

"mentions": [

{

"text": {

"content": "Dijon",

"beginOffset": 54

},

"type": "PROPER"

}

]

}

],

"language": "en"

}

Für Entitäten mit einer Wikipedia-Seite stellt die API Metadaten bereit, einschließlich der URL dieser Seite sowie der mid der Entität. Die mid ist eine ID, die dieser Entität im Knowledge Graph von Google zugeordnet ist. Wenn Sie weitere Informationen dazu erhalten möchten, können Sie die Knowledge Graph API aufrufen und diese ID übergeben. Die Natural Language API teilt uns zu allen Entitäten mit, an welchen Stellen sie im Text erscheinen (mentions), die Art der Entität (type) sowie den Auffälligkeitswert salience (ein Bereich von [0,1], der anzeigt, wie wichtig das Wort für den Text als Ganzes ist). Neben Englisch unterstützt die Natural Language API auch die hier aufgeführten Sprachen.

Wenn wir dieses Bild betrachten, ist es für uns relativ einfach, die wichtigen Entitäten auszuwählen. Bei einer Bibliothek mit Tausenden von Bildern wäre dies jedoch viel schwieriger. OCR, Übersetzung und Natural Language Processing können uns dabei unterstützen, die Bedeutung großer Bilddatensätze zu extrahieren.

Klicken Sie auf Fortschritt prüfen.

Bildtexte mit der Natural Language API analysieren

Glückwunsch!

Sie haben gelernt, drei verschiedene APIs für maschinelles Lernen zu kombinieren: Die OCR-Methode der Vision API extrahierte Text aus einem Bild, dann übersetzte die Translation API diesen Text ins Englische und die Natural Language API fand die Entitäten in diesem Text. Sie können diese APIs zusammen verwenden, um die Bedeutung großer Bilddatensätze zu extrahieren.

Weitere Informationen

Google Cloud-Schulungen und -Zertifizierungen

In unseren Schulungen erfahren Sie alles zum optimalen Einsatz unserer Google Cloud-Technologien und können sich entsprechend zertifizieren lassen. Unsere Kurse vermitteln technische Fähigkeiten und Best Practices, damit Sie möglichst schnell mit Google Cloud loslegen und Ihr Wissen fortlaufend erweitern können. Wir bieten On-Demand-, Präsenz- und virtuelle Schulungen für Anfänger wie Fortgeschrittene an, die Sie individuell in Ihrem eigenen Zeitplan absolvieren können. Mit unseren Zertifizierungen weisen Sie nach, dass Sie Experte im Bereich Google Cloud-Technologien sind.

Anleitung zuletzt am 22 Oktober 2024 aktualisiert

Lab zuletzt am 22. Oktober 2024 getestet

© 2026 Google LLC. Alle Rechte vorbehalten. Google und das Google-Logo sind Marken von Google LLC. Alle anderen Unternehmens- und Produktnamen können Marken der jeweils mit ihnen verbundenen Unternehmen sein.

.

.