GSP063

Übersicht

Mit der Cloud Natural Language API können Sie Entitäten aus Texten extrahieren, Sentiment- und Syntaxanalysen erstellen sowie Texte durch Klassifizierung kategorisieren. Der Schwerpunkt dieses Labs liegt auf der Textklassifizierung. Die API nutzt eine Datenbank mit mehr als 700 Kategorien, sodass auch große Text-Datasets mühelos klassifiziert werden können.

Ziele

Sie werden in diesem Lab die folgenden Aufgaben durcharbeiten:

- Anfrage an die Natural Language API erstellen und die API mit „curl“ aufrufen

- Textklassifizierungsfunktion der Natural Language API verwenden

- Dataset aus Nachrichtenartikeln mithilfe von Textklassifizierung analysieren

Einrichtung und Anforderungen

Vor dem Klick auf „Start Lab“ (Lab starten)

Lesen Sie diese Anleitung. Labs sind zeitlich begrenzt und können nicht pausiert werden. Der Timer beginnt zu laufen, wenn Sie auf Lab starten klicken, und zeigt Ihnen, wie lange Google Cloud-Ressourcen für das Lab verfügbar sind.

In diesem praxisorientierten Lab können Sie die Lab-Aktivitäten in einer echten Cloud-Umgebung durchführen – nicht in einer Simulations- oder Demo-Umgebung. Dazu erhalten Sie neue, temporäre Anmeldedaten, mit denen Sie für die Dauer des Labs auf Google Cloud zugreifen können.

Für dieses Lab benötigen Sie Folgendes:

- Einen Standardbrowser (empfohlen wird Chrome)

Hinweis: Nutzen Sie den privaten oder Inkognitomodus (empfohlen), um dieses Lab durchzuführen. So wird verhindert, dass es zu Konflikten zwischen Ihrem persönlichen Konto und dem Teilnehmerkonto kommt und zusätzliche Gebühren für Ihr persönliches Konto erhoben werden.

- Zeit für die Durchführung des Labs – denken Sie daran, dass Sie ein begonnenes Lab nicht unterbrechen können.

Hinweis: Verwenden Sie für dieses Lab nur das Teilnehmerkonto. Wenn Sie ein anderes Google Cloud-Konto verwenden, fallen dafür möglicherweise Kosten an.

Lab starten und bei der Google Cloud Console anmelden

-

Klicken Sie auf Lab starten. Wenn Sie für das Lab bezahlen müssen, wird ein Dialogfeld geöffnet, in dem Sie Ihre Zahlungsmethode auswählen können.

Auf der linken Seite befindet sich der Bereich „Details zum Lab“ mit diesen Informationen:

- Schaltfläche „Google Cloud Console öffnen“

- Restzeit

- Temporäre Anmeldedaten für das Lab

- Ggf. weitere Informationen für dieses Lab

-

Klicken Sie auf Google Cloud Console öffnen (oder klicken Sie mit der rechten Maustaste und wählen Sie Link in Inkognitofenster öffnen aus, wenn Sie Chrome verwenden).

Im Lab werden Ressourcen aktiviert. Anschließend wird ein weiterer Tab mit der Seite „Anmelden“ geöffnet.

Tipp: Ordnen Sie die Tabs nebeneinander in separaten Fenstern an.

Hinweis: Wird das Dialogfeld Konto auswählen angezeigt, klicken Sie auf Anderes Konto verwenden.

-

Kopieren Sie bei Bedarf den folgenden Nutzernamen und fügen Sie ihn in das Dialogfeld Anmelden ein.

{{{user_0.username | "Username"}}}

Sie finden den Nutzernamen auch im Bereich „Details zum Lab“.

-

Klicken Sie auf Weiter.

-

Kopieren Sie das folgende Passwort und fügen Sie es in das Dialogfeld Willkommen ein.

{{{user_0.password | "Password"}}}

Sie finden das Passwort auch im Bereich „Details zum Lab“.

-

Klicken Sie auf Weiter.

Wichtig: Sie müssen die für das Lab bereitgestellten Anmeldedaten verwenden. Nutzen Sie nicht die Anmeldedaten Ihres Google Cloud-Kontos.

Hinweis: Wenn Sie Ihr eigenes Google Cloud-Konto für dieses Lab nutzen, können zusätzliche Kosten anfallen.

-

Klicken Sie sich durch die nachfolgenden Seiten:

- Akzeptieren Sie die Nutzungsbedingungen.

- Fügen Sie keine Wiederherstellungsoptionen oder Zwei-Faktor-Authentifizierung hinzu (da dies nur ein temporäres Konto ist).

- Melden Sie sich nicht für kostenlose Testversionen an.

Nach wenigen Augenblicken wird die Google Cloud Console in diesem Tab geöffnet.

Hinweis: Wenn Sie auf Google Cloud-Produkte und ‑Dienste zugreifen möchten, klicken Sie auf das Navigationsmenü oder geben Sie den Namen des Produkts oder Dienstes in das Feld Suchen ein.

Cloud Shell aktivieren

Cloud Shell ist eine virtuelle Maschine, auf der Entwicklertools installiert sind. Sie bietet ein Basisverzeichnis mit 5 GB nichtflüchtigem Speicher und läuft auf Google Cloud. Mit Cloud Shell erhalten Sie Befehlszeilenzugriff auf Ihre Google Cloud-Ressourcen.

-

Klicken Sie oben in der Google Cloud Console auf Cloud Shell aktivieren  .

.

-

Klicken Sie sich durch die folgenden Fenster:

- Fahren Sie mit dem Informationsfenster zu Cloud Shell fort.

- Autorisieren Sie Cloud Shell, Ihre Anmeldedaten für Google Cloud API-Aufrufe zu verwenden.

Wenn eine Verbindung besteht, sind Sie bereits authentifiziert und das Projekt ist auf Project_ID, eingestellt. Die Ausgabe enthält eine Zeile, in der die Project_ID für diese Sitzung angegeben ist:

Ihr Cloud-Projekt in dieser Sitzung ist festgelegt als {{{project_0.project_id | "PROJECT_ID"}}}

gcloud ist das Befehlszeilentool für Google Cloud. Das Tool ist in Cloud Shell vorinstalliert und unterstützt die Tab-Vervollständigung.

- (Optional) Sie können den aktiven Kontonamen mit diesem Befehl auflisten:

gcloud auth list

- Klicken Sie auf Autorisieren.

Ausgabe:

ACTIVE: *

ACCOUNT: {{{user_0.username | "ACCOUNT"}}}

Um das aktive Konto festzulegen, führen Sie diesen Befehl aus:

$ gcloud config set account `ACCOUNT`

- (Optional) Sie können die Projekt-ID mit diesem Befehl auflisten:

gcloud config list project

Ausgabe:

[core]

project = {{{project_0.project_id | "PROJECT_ID"}}}

Hinweis: Die vollständige Dokumentation für gcloud finden Sie in Google Cloud in der Übersicht zur gcloud CLI.

Aufgabe 1: Cloud Natural Language API aktivieren

-

Maximieren Sie oben links auf dem Bildschirm das Navigationsmenü ( ).

).

-

Wählen Sie APIs und Dienste > Aktivierte APIs und Dienste aus.

- Klicken Sie auf APIs und Dienste aktivieren.

-

Geben Sie dann in das Suchfeld language ein.

-

Klicken Sie auf Cloud Natural Language API.

Wenn die API nicht aktiviert ist, wird der Button Aktivieren angezeigt.

- Klicken Sie auf Aktivieren, um die Cloud Natural Language API zu aktivieren.

Sobald die API aktiviert ist, werden Informationen zur API in Google Cloud angezeigt:

Aufgabe 2: API-Schlüssel erstellen

Da Sie die Anfrage an die Natural Language API mit curl senden, müssen Sie einen API-Schlüssel generieren und in der Anfrage-URL übergeben:

-

Klicken Sie zum Erstellen des API-Schlüssels in der Console auf das Navigationsmenü > APIs und Dienste > Anmeldedaten.

-

Klicken Sie auf Anmeldedaten erstellen.

-

Wählen Sie im Drop-down-Menü API-Schlüssel aus.

-

Kopieren Sie den gerade generierten Schlüssel und klicken Sie auf Schließen.

Klicken Sie auf Fortschritt prüfen.

API-Schlüssel erstellen

Speichern Sie den API-Schlüssel nun als Umgebungsvariable, damit Sie den Schlüsselwert nicht in jeder Anfrage separat einfügen müssen.

Für die nächsten Schritte müssen Sie über SSH eine Verbindung mit der für Sie bereitgestellten Instanz herstellen.

- Öffnen Sie das Navigationsmenü und wählen Sie Compute Engine > VM-Instanzen aus. Sie sollten eine bereitgestellte Instanz namens

linux-instance sehen.

-

Klicken Sie auf den Button SSH. Sie werden zu einer interaktiven Shell weitergeleitet.

-

Geben Sie in der Befehlszeile folgenden Befehl ein und ersetzen Sie dabei <YOUR_API_KEY> durch den gerade kopierten Schlüssel:

export API_KEY=<YOUR_API_KEY>

Aufgabe 3: Nachrichtenartikel klassifizieren

Mit der Methode „classifyText“ der Natural Language API können Sie Textdaten mit einem einzigen API-Aufruf kategorisieren. Die Methode gibt eine Liste der Inhaltskategorien zurück, die auf das betreffende Textdokument zutreffen.

Diese Kategorien reichen von sehr allgemeinen Kategorien wie /Computers & Electronics bis hin zu sehr spezifischen Kategorien wie /Computers & Electronics/Programming/Java (Programming Language). Eine vollständige Liste der über 700 möglichen Kategorien finden Sie auf der Seite Inhaltskategorien.

In diesem Lab klassifizieren Sie zuerst einen einzelnen Artikel und sehen sich dann an, wie Sie einen großen Artikelkorpus mit der Methode analysieren können.

- Beginnen Sie mit der folgenden Schlagzeile und Beschreibung eines Artikels aus dem Rezeptteil der New York Times:

A Smoky Lobster Salad With a Tapa Twist. This spin on the Spanish pulpo a la gallega skips the octopus, but keeps the sea salt, olive oil, pimentón and boiled potatoes.

- Erstellen Sie eine Datei namens

request.json und fügen Sie den nachfolgenden Code ein. Sie können die Datei mit einem beliebigen Befehlszeilen-Editor Ihrer Wahl erstellen (z. B. nano, vim oder emacs).

{

"document":{

"type":"PLAIN_TEXT",

"content":"A Smoky Lobster Salad With a Tapa Twist. This spin on the Spanish pulpo a la gallega skips the octopus, but keeps the sea salt, olive oil, pimentón and boiled potatoes."

}

}

Create a request to classify a news article

- Senden Sie diesen Text mit dem folgenden

curl-Befehl an die Methode classifyText der Natural Language API:

curl "https://language.googleapis.com/v1/documents:classifyText?key=${API_KEY}" \

-s -X POST -H "Content-Type: application/json" --data-binary @request.json

Sehen Sie sich das Ergebnis an:

{ categories:

[

{

name: '/Food & Drink/Cooking & Recipes',

confidence: 0.85

},

{

name: '/Food & Drink/Food/Meat & Seafood',

confidence: 0.63

}

]

}

Damit haben Sie eine Speech API-Anfrage erstellt und die Speech API aufgerufen.

- Führen Sie den folgenden Befehl aus, um die Antwort in einer Datei

result.json zu speichern:

curl "https://language.googleapis.com/v1/documents:classifyText?key=${API_KEY}" \

-s -X POST -H "Content-Type: application/json" --data-binary @request.json > result.json

Check the Entity Analysis response

Die API hat zwei Kategorien für diesen Text zurückgegeben:

/Food & Drink/Cooking & Recipes/Food & Drink/Food/Meat & Seafood

Im Text wird nicht ausdrücklich erwähnt, dass er ein Rezept ist oder dass Meeresfrüchte enthalten sind. Trotzdem ist die API in der Lage, ihn entsprechend zu kategorisieren. Nun mag es ganz nützlich sein, einen einzelnen Artikel zu klassifizieren. Die tatsächliche Stärke dieser Funktion liegt aber in der Klassifizierung großer Mengen von Textdaten.

Aufgabe 4: Großes Text-Dataset klassifizieren

Wir nutzen in diesem Lab ein öffentliches Dataset mit Nachrichtenartikeln der BBC, um Ihnen zu zeigen, wie Sie mit der Methode classifyText ein Dataset mit umfangreichen Textdaten analysieren können. Das Dataset umfasst 2.225 Artikel aus fünf Themenbereichen (Wirtschaft, Unterhaltung, Politik, Sport, Technik) aus den Jahren 2004 bis 2005. Ein Teil dieser Artikel befindet sich in einem öffentlichen Cloud Storage-Bucket. Alle Artikel sind jeweils als TXT-Datei gespeichert.

Diese Daten sollen nun zur Analyse an die Natural Language API gesendet werden. Hierfür schreiben Sie ein Python-Script, das jede Textdatei aus Cloud Storage liest, die Daten an den Endpunkt classifyText sendet und die Ergebnisse in einer BigQuery-Tabelle speichert. BigQuery ist das Big Data Warehouse-Tool von Google Cloud, mit dem Sie große Datasets unkompliziert speichern und analysieren können.

- Führen Sie den folgenden Befehl aus, um sich einen der Artikel anzusehen (

gsutil stellt eine Befehlszeile für Cloud Storage bereit):

gsutil cat gs://spls/gsp063/bbc_dataset/entertainment/001.txt

Als Nächstes erstellen Sie eine BigQuery-Tabelle für Ihre Daten.

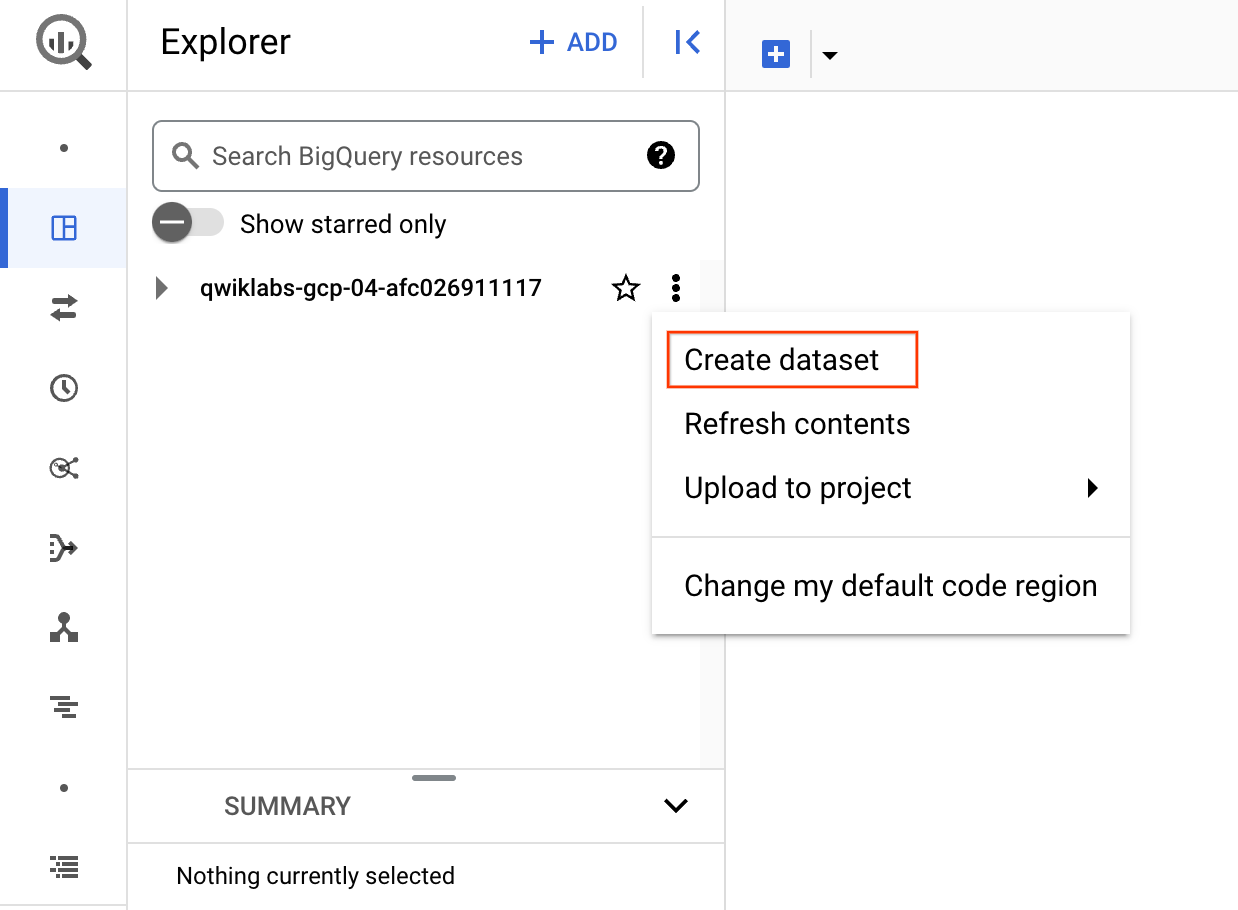

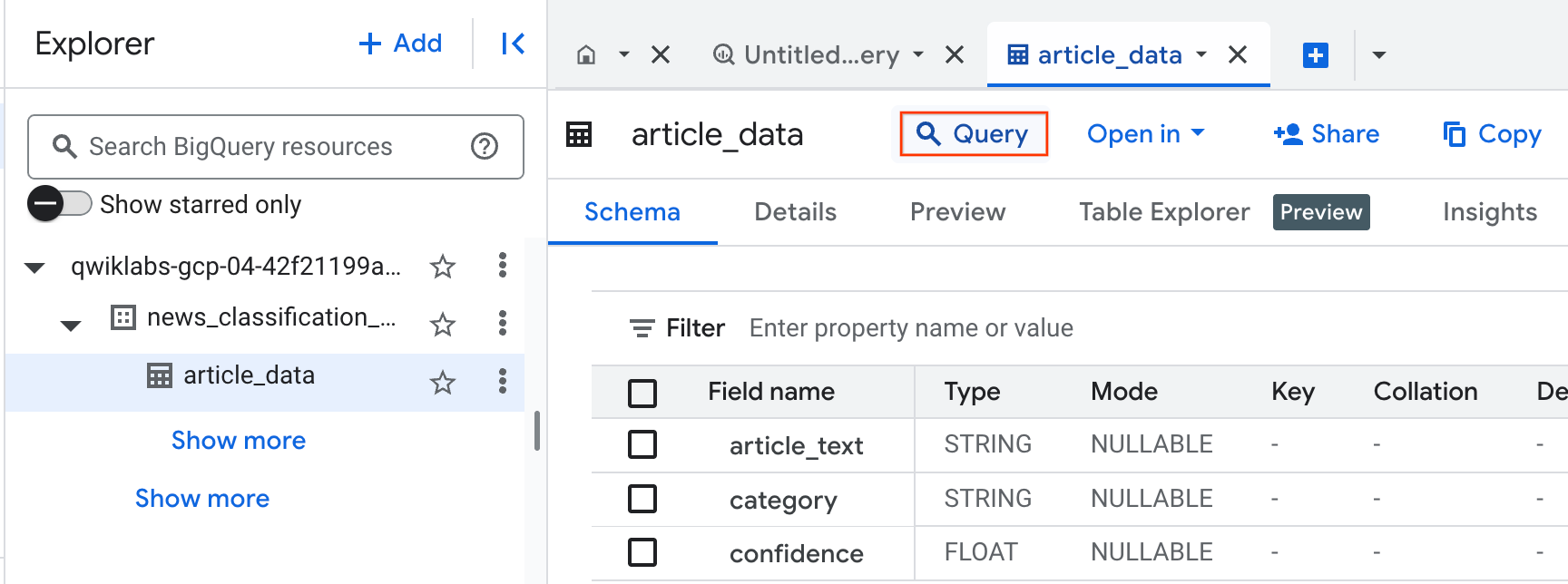

Aufgabe 5: BigQuery-Tabelle für die kategorisierten Textdaten erstellen

Vor dem Senden des Textes an die Natural Language API müssen Sie festlegen, wo der Text und die Kategorie des jeweiligen Artikels gespeichert werden sollen.

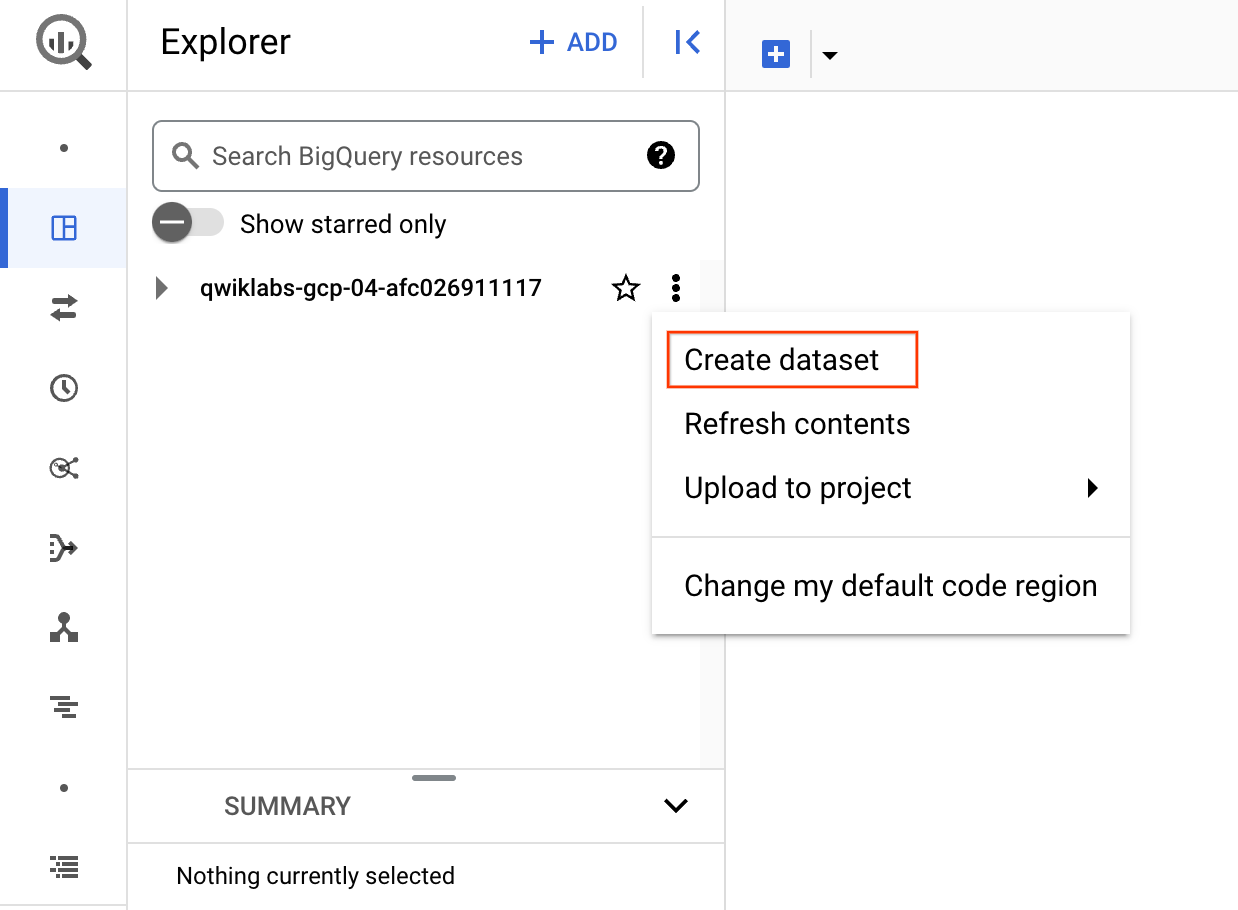

-

Gehen Sie in der Console zum Navigationsmenü > BigQuery.

-

Klicken Sie auf Fertig.

-

Klicken Sie neben der Projekt-ID auf das Symbol Aktionen ansehen und wählen Sie Dataset erstellen aus, um ein Dataset zu erstellen:

-

Geben Sie dem Dataset den Namen news_classification_dataset und klicken Sie auf Dataset erstellen.

-

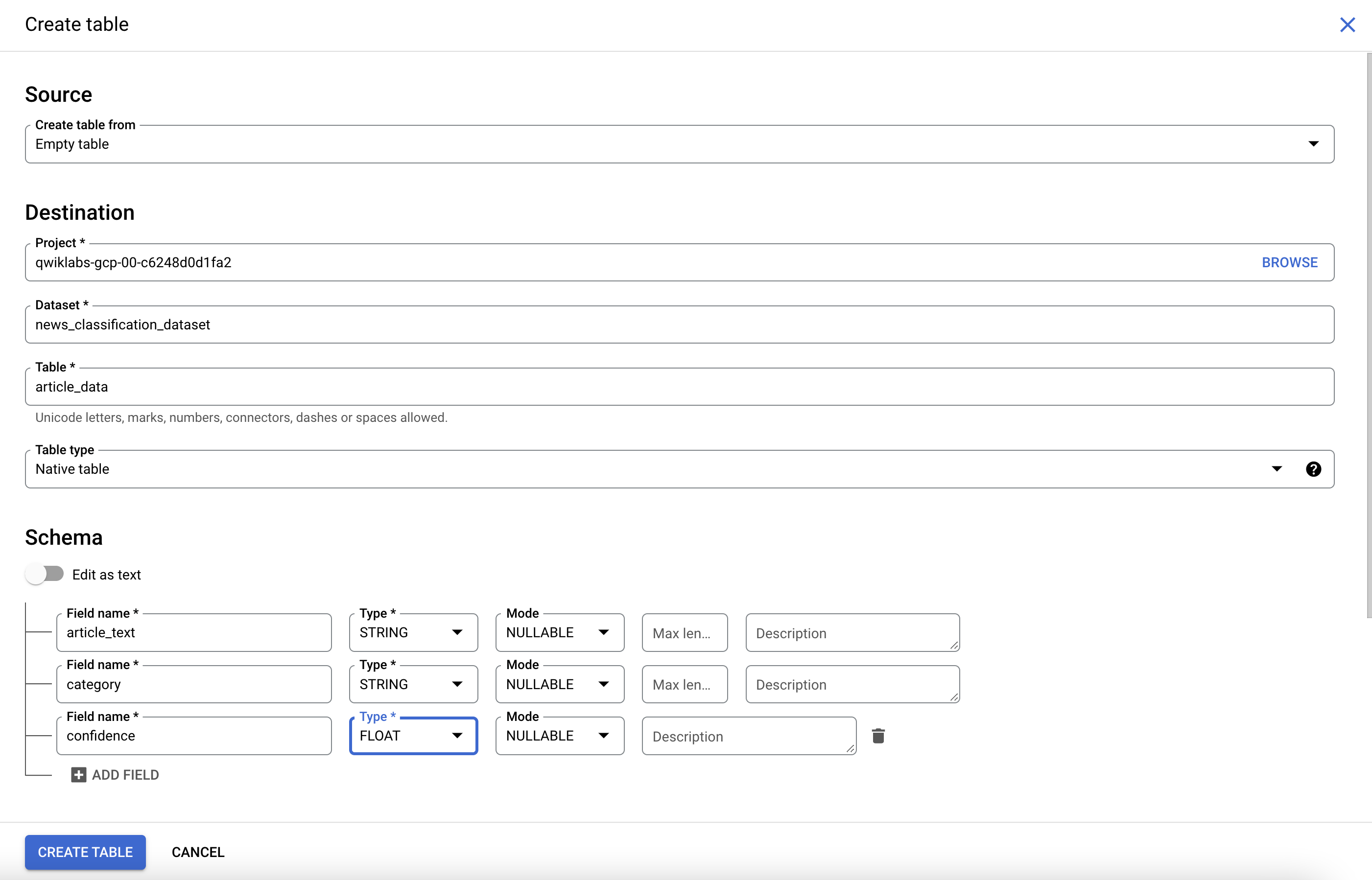

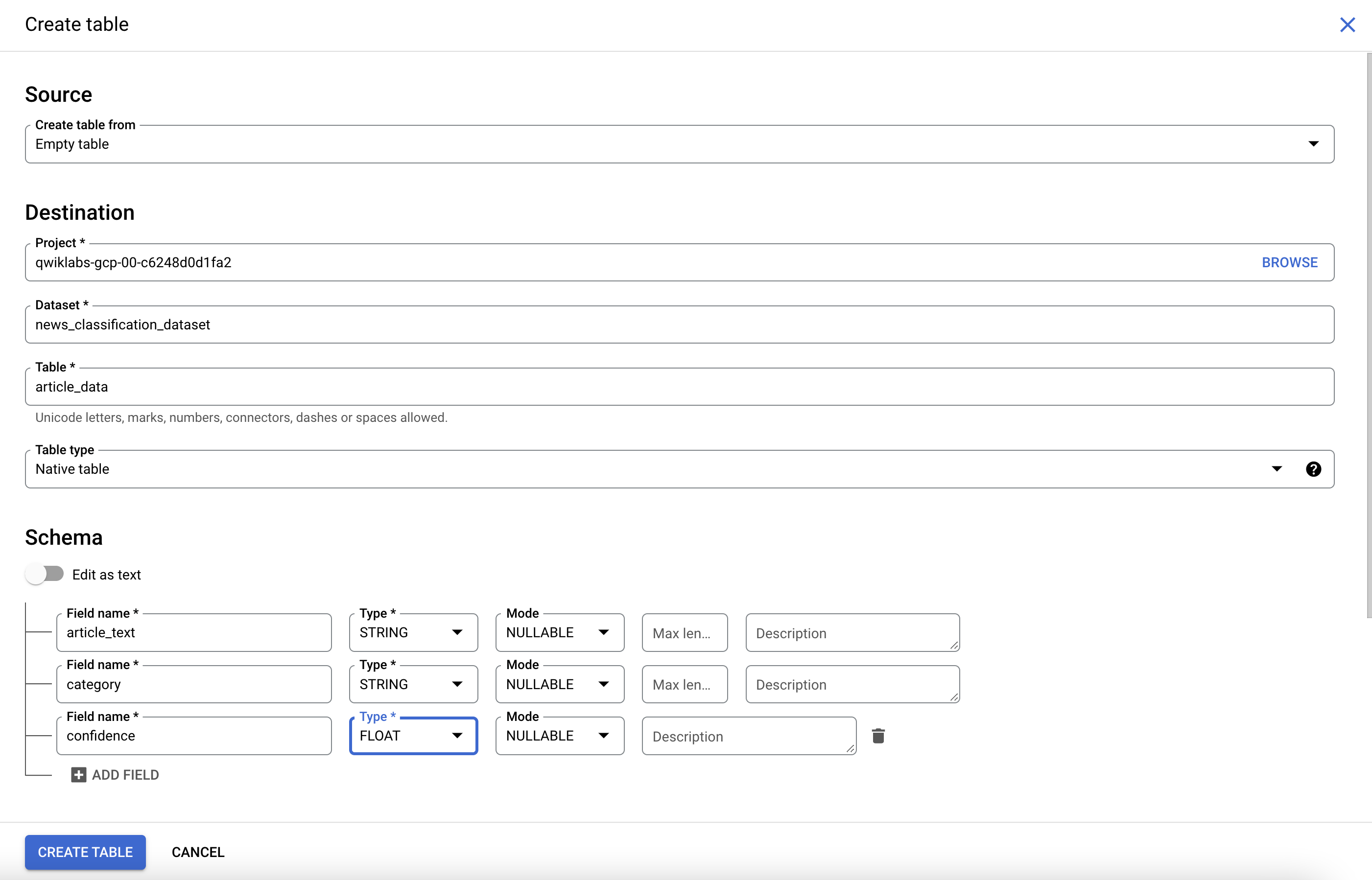

Klicken Sie auf das Symbol Aktionen ansehen neben news_classification_dataset und wählen Sie Tabelle erstellen aus, um eine Tabelle zu erstellen.

-

Verwenden Sie für die neue Tabelle die folgenden Einstellungen:

- Tabelle erstellen aus: Leere Tabelle

- Tabelle benennen: article_data

-

Klicken Sie unter „Schema“ auf Feld hinzufügen und fügen Sie die folgenden drei Felder hinzu:

| Feldname |

Typ |

Modus |

article_text |

STRING |

NULLABLE |

category |

STRING |

NULLABLE |

confidence |

FLOAT |

NULLABLE |

- Klicken Sie auf Tabelle erstellen.

Im Moment ist die Tabelle noch leer. Im nächsten Schritt werden die Artikel aus Cloud Storage gelesen und zur Klassifizierung an die Natural Language API gesendet. Das Ergebnis wird dann in BigQuery gespeichert.

Klicken Sie auf Fortschritt prüfen.

Neues Dataset und Tabelle für die kategorisierten Textdaten erstellen

Aufgabe 6: Artikeldaten klassifizieren und Ergebnis in BigQuery speichern

Für die nächsten Schritte müssen Sie eine Verbindung mit der Cloud Shell herstellen. Klicken Sie bei Aufforderung auf Weiter.

Bevor Sie das Script schreiben können, über das die Artikeldaten an die Natural Language API gesendet werden, müssen Sie ein Dienstkonto erstellen. Mit diesem Konto authentifiziert sich Ihr Python-Script bei der Natural Language API und Big Query.

- Exportieren Sie Ihre Projekt-ID als Umgebungsvariable:

export PROJECT={{{project_0.project_id | Project ID}}}

- Führen Sie die folgenden Befehle aus, um ein Dienstkonto zu erstellen:

gcloud iam service-accounts create my-account --display-name my-account

gcloud projects add-iam-policy-binding $PROJECT --member=serviceAccount:my-account@$PROJECT.iam.gserviceaccount.com --role=roles/bigquery.admin

gcloud projects add-iam-policy-binding $PROJECT --member=serviceAccount:my-account@$PROJECT.iam.gserviceaccount.com --role=roles/serviceusage.serviceUsageConsumer

gcloud iam service-accounts keys create key.json --iam-account=my-account@$PROJECT.iam.gserviceaccount.com

export GOOGLE_APPLICATION_CREDENTIALS=key.json

Nun ist alles bereit und Sie können die Textdaten an die Natural Language API senden.

- Schreiben Sie ein Python-Script mit dem Python-Modul für Google Cloud.

Sie können auch jede andere Programmiersprache verwenden. Die Auswahl an entsprechenden Cloud-Clientbibliotheken ist groß.

- Erstellen Sie eine Datei mit dem Namen

classify-text.py und kopieren Sie den nachfolgenden Code in die Datei. Auch diese Datei können Sie mit einem beliebigen Befehlszeilen-Editor Ihrer Wahl erstellen (z. B. nano, vim oder emacs).

from google.cloud import storage, language, bigquery

# Set up your GCS, NL, and BigQuery clients

storage_client = storage.Client()

nl_client = language.LanguageServiceClient()

bq_client = bigquery.Client(project='{{{project_0.project_id | Project ID}}}')

dataset_ref = bq_client.dataset('news_classification_dataset')

dataset = bigquery.Dataset(dataset_ref)

table_ref = dataset.table('article_data')

table = bq_client.get_table(table_ref)

# Send article text to the NL API's classifyText method

def classify_text(article):

response = nl_client.classify_text(

document=language.Document(

content=article,

type=language.Document.Type.PLAIN_TEXT

)

)

return response

rows_for_bq = []

files = storage_client.bucket('qwiklabs-test-bucket-gsp063').list_blobs()

print("Got article files from GCS, sending them to the NL API (this will take ~2 minutes)...")

# Send files to the NL API and save the result to send to BigQuery

for file in files:

if file.name.endswith('txt'):

article_text = file.download_as_bytes().decode('utf-8') # Decode bytes to string

nl_response = classify_text(article_text)

if len(nl_response.categories) > 0:

rows_for_bq.append((article_text, nl_response.categories[0].name, nl_response.categories[0].confidence))

print("Writing NL API article data to BigQuery...")

# Write article text + category data to BQ

if rows_for_bq:

errors = bq_client.insert_rows(table, rows_for_bq)

if errors:

print("Encountered errors while writing to BigQuery:", errors)

else:

print("No articles found in the specified bucket.")

Jetzt können Sie mit der Klassifizierung der Artikel und dem Import in BigQuery beginnen.

- Führen Sie das folgende Script aus:

python3 classify-text.py

Die Ausführung des Scripts dauert etwa zwei Minuten. In der Zwischenzeit sehen wir uns an, was dabei genau passiert.

Sie verwenden die Python-Clientbibliothek von Google Cloud, um auf Cloud Storage, die Natural Language API und BigQuery zuzugreifen. Zuerst wird für jeden Dienst ein Client erstellt, danach Verweise auf die BigQuery-Tabelle. files ist ein Verweis auf jede Datei des BBC-Datasets im öffentlichen Bucket. Die Dateien werden gelesen, die Artikel als Strings heruntergeladen und jeder String einzeln mit der Funktion classify_text an die Natural Language API gesendet. Jeder Artikel, für den die Natural Language API eine Kategorie zurückgibt, wird zusammen mit seinen Kategoriedaten in der Liste rows_for_bq gespeichert. Sobald alle Artikel klassifiziert sind, werden die Daten mithilfe von insert_rows() in BigQuery eingefügt.

Hinweis: Die Natural Language API kann pro Dokument mehrere Kategorien zurückgeben. In diesem Lab speichern Sie der Einfachheit halber aber nur die erste übergebene Kategorie.

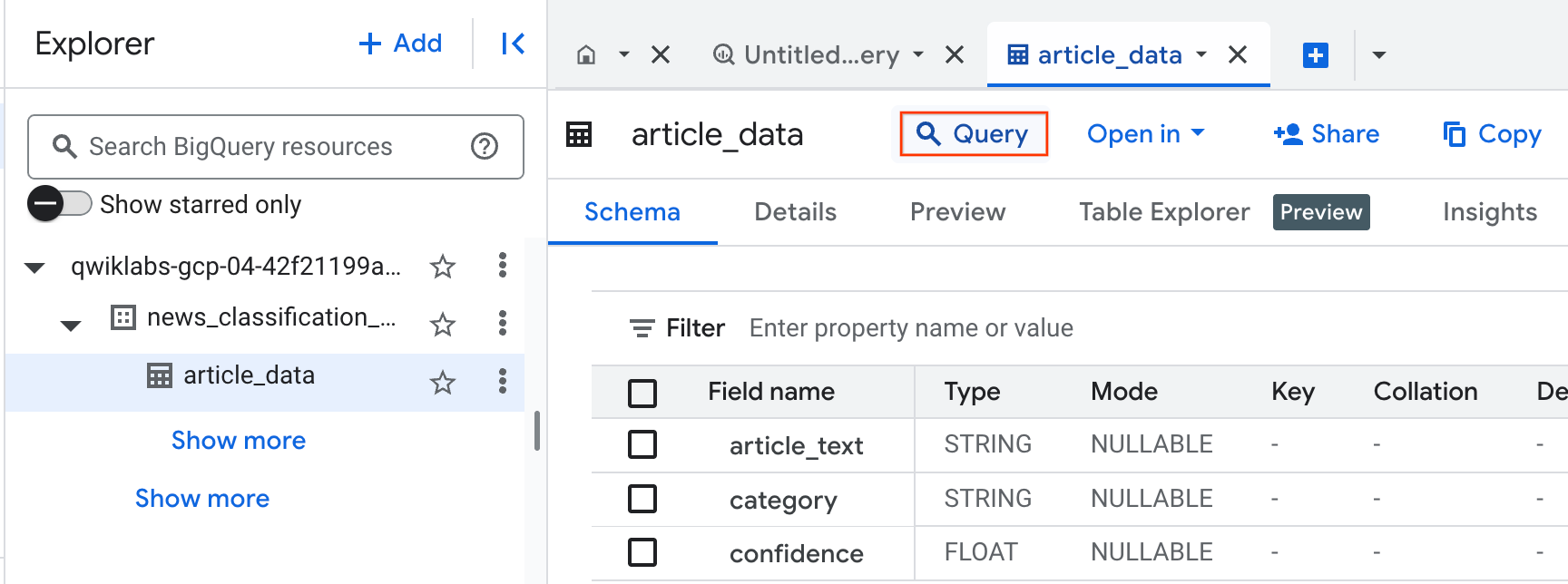

Nach der Ausführung des Scripts müssen Sie überprüfen, ob die Artikeldaten in BigQuery gespeichert wurden.

- Gehen Sie in BigQuery auf dem Tab „Explorer“ zur Tabelle

article_data und klicken Sie auf Abfrage, um die Tabelle abzufragen:

- Bearbeiten Sie die Ergebnisse im Feld Nicht gespeicherte Abfrage, indem Sie zwischen SELECT und FROM ein Sternchen einfügen:

SELECT * FROM `{{{project_0.project_id | Project ID}}}.news_classification_dataset.article_data`

- Klicken Sie auf Ausführen.

Sobald die Abfrage abgeschlossen wurde, sehen Sie Ihre Daten.

- Scrollen Sie nach rechts zur Kategoriespalte.

Die Kategoriespalte hat den Namen der ersten von der Natural Language API für den Artikel zurückgegebenen Kategorie. Die Konfidenz (confidence) ist ein Wert zwischen 0 und 1 und gibt an, wie sicher die API ist, den Artikel korrekt kategorisiert zu haben.

Wie sich komplexere Datenabfragen ausführen lassen, lernen Sie im nächsten Schritt.

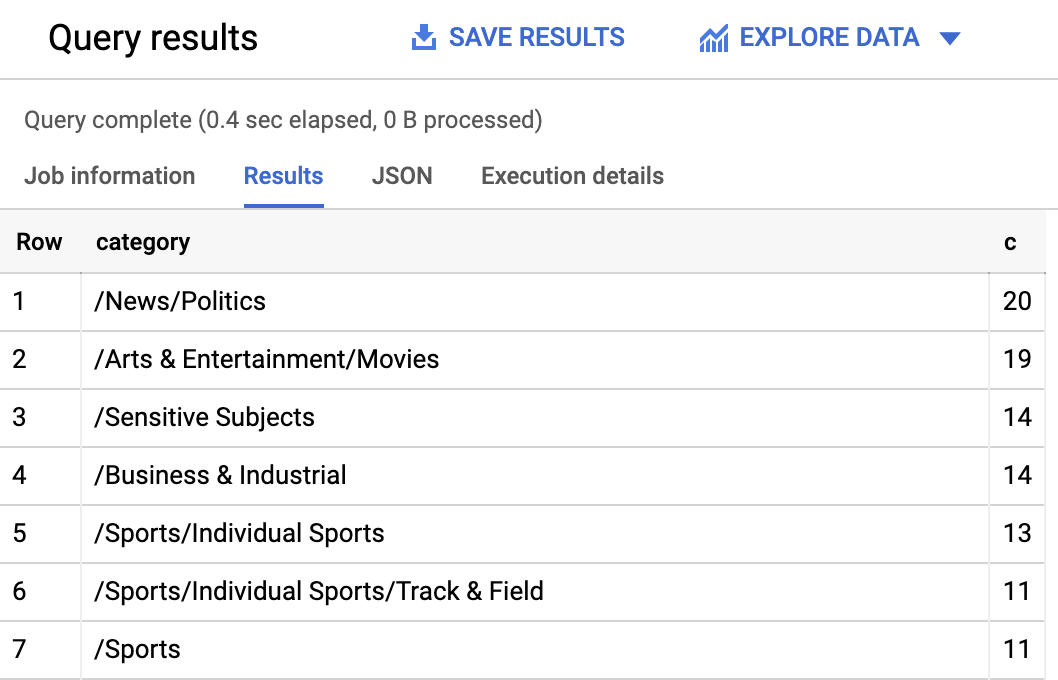

Aufgabe 7: Kategorisierte Artikeldaten in BigQuery analysieren

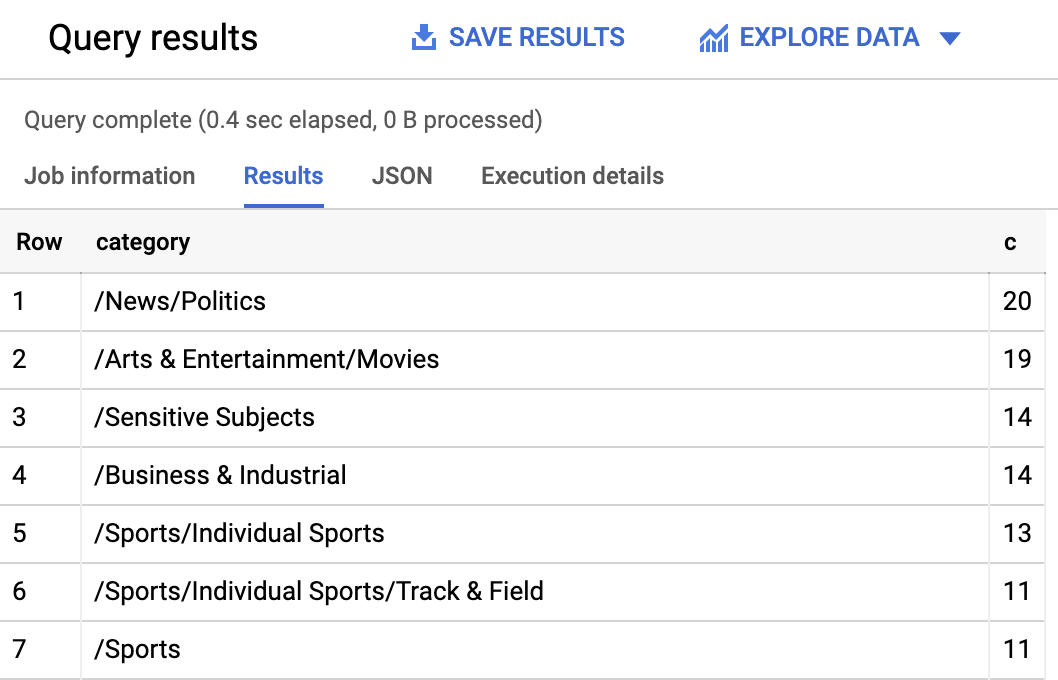

Als Erstes sehen Sie sich an, welche Kategorien im Dataset am häufigsten sind.

-

Klicken Sie in der BigQuery Console auf + SQL-Abfrage.

-

Geben Sie die folgende Abfrage ein:

SELECT

category,

COUNT(*) c

FROM

`{{{project_0.project_id | Project ID}}}.news_classification_dataset.article_data`

GROUP BY

category

ORDER BY

c DESC

- Klicken Sie auf Ausführen.

Die Ergebnisse der Abfrage sollten in etwa so aussehen:

Wenn Sie einen Artikel finden möchten, für den eine spezifischere Kategorie zurückgegeben wurde, etwa /Arts & Entertainment/Music & Audio/Classical Music, könnten Sie die folgende Abfrage verwenden:

SELECT * FROM `{{{project_0.project_id | Project ID}}}.news_classification_dataset.article_data`

WHERE category = "/Arts & Entertainment/Music & Audio/Classical Music"

Sie können sich auch nur die Artikel ausgeben lassen, bei denen die Natural Language API den Konfidenzwert ihrer Kategorisierung auf mehr als 90 % schätzt:

SELECT

article_text,

category

FROM `{{{project_0.project_id | Project ID}}}.news_classification_dataset.article_data`

WHERE cast(confidence as float64) > 0.9

Welche Abfragen noch möglich sind, können Sie in der BigQuery-Dokumentation nachlesen. BigQuery lässt sich auch in viele Visualisierungstools integrieren. Wie Sie Ihre kategorisierten Artikeldaten visuell aufbereiten können, erfahren Sie unter Daten mit Looker Studio visualisieren.

Geschafft!

Sie haben gelernt, wie Sie mit der Methode zur Textklassifizierung der Natural Language API Nachrichtenartikel klassifizieren können. Dabei haben Sie zuerst nur einen Artikel klassifiziert und anschließend ein großes Dataset aus vielen Nachrichtenartikeln mithilfe der NL API und BigQuery klassifiziert und analysiert. Außerdem haben Sie gelernt, wie Sie eine BigQuery-Tabelle erstellen und Abfragen für Ihre Daten ausführen können.

Weitere Informationen

Google Cloud-Schulungen und -Zertifizierungen

In unseren Schulungen erfahren Sie alles zum optimalen Einsatz unserer Google Cloud-Technologien und können sich entsprechend zertifizieren lassen. Unsere Kurse vermitteln technische Fähigkeiten und Best Practices, damit Sie möglichst schnell mit Google Cloud loslegen und Ihr Wissen fortlaufend erweitern können. Wir bieten On-Demand-, Präsenz- und virtuelle Schulungen für Anfänger wie Fortgeschrittene an, die Sie individuell in Ihrem eigenen Zeitplan absolvieren können. Mit unseren Zertifizierungen weisen Sie nach, dass Sie Experte im Bereich Google Cloud-Technologien sind.

Anleitung zuletzt aktualisiert am 21. März 2025

Lab zuletzt getestet am 21. März 2025

© 2026 Google LLC. Alle Rechte vorbehalten. Google und das Google-Logo sind Marken von Google LLC. Alle anderen Unternehmens- und Produktnamen können Marken der jeweils mit ihnen verbundenen Unternehmen sein.

.

. ).

).