WICHTIG:

WICHTIG:

Dieses Lab sollte nur auf einem Computer oder Laptop durchgeführt werden.

Dieses Lab sollte nur auf einem Computer oder Laptop durchgeführt werden.

Pro Lab sind nur 5 Versuche zulässig.

Pro Lab sind nur 5 Versuche zulässig.

Zur Erinnerung: Es ist ganz normal, beim ersten Versuch nicht alle Fragen richtig zu beantworten oder eine Aufgabe wiederholen zu müssen – das gehört zum Lernprozess.

Zur Erinnerung: Es ist ganz normal, beim ersten Versuch nicht alle Fragen richtig zu beantworten oder eine Aufgabe wiederholen zu müssen – das gehört zum Lernprozess.

Sobald ein Lab gestartet wurde, kann der Timer nicht mehr pausiert werden. Nach 1 Stunde und 30 Minuten wird das Lab beendet und Sie müssen von vorne beginnen.

Sobald ein Lab gestartet wurde, kann der Timer nicht mehr pausiert werden. Nach 1 Stunde und 30 Minuten wird das Lab beendet und Sie müssen von vorne beginnen.

Weitere Informationen finden Sie in den technischen Tipps zum Lab.

Weitere Informationen finden Sie in den technischen Tipps zum Lab.

Aktivitätsübersicht

Google Cloud-Dienste schreiben Audit-Logs, in denen administrative Aktivitäten und Zugriffe in Ihren Google Cloud-Ressourcen aufgezeichnet werden. Anhand von Audit-Logeinträgen können Sie herausfinden, wer was wo und wann in Ihren Google Cloud-Projekten getan hat. Wenn Sie Audit-Logs aktivieren, können Ihre Sicherheits-, Prüf- und Compliance-Teams Google Cloud-Daten und -Systeme auf mögliche Sicherheitslücken oder externen Datenmissbrauch hin überwachen.

In diesem Lab untersuchen Sie Audit-Logs, um Muster verdächtiger Aktivitäten im Zusammenhang mit Cloud-Ressourcen zu erkennen.

Szenario

Die Cymbal Bank hat die Migration zu ihrer Hybrid-Cloud-Lösung abgeschlossen und ihre Workflows in der neuen Cloud-Umgebung bereitgestellt. Leider wurde das Security Engineering-Team über eine Warnung mit hoher Priorität informiert, die einen unbefugten Zugriff auf mehrere Cloud-Ressourcen betrifft. Das ist alarmierend, da böswillige Akteurinnen und Akteure kompromittierte Cloud-Ressourcen nutzen können, um Daten zu exfiltrieren und Angriffe auf andere Systeme zu starten. Sie haben bislang noch nie einen Sicherheitsvorfall erlebt. Ihre Teamleiterin, Chloe, sieht darin eine gute Gelegenheit für Sie, die Prozesse und Verfahren der Incident Response kennenzulernen. Sie sollen Hannah, eine Incident Responderin im Incident Response Team, begleiten und beobachten. Das Team ist eine Einheit der Abteilung für Security Engineering. Hannah hat Ihnen Zugriff auf die Logs der Warnung gewährt, die Sie zur Untersuchung der schädlichen Aktivität verwenden. Sie möchten den Sicherheitsvorfall besser verstehen und haben deshalb eine Testumgebung eingerichtet, um den Vorfall nachzustellen und die Artefakte zu analysieren. Sie verwenden zwei separate Nutzerkonten: Mit einem Konto wird die schädliche Aktivität generiert und mit dem anderen Konto wird die Aktivität untersucht.

So gehts: Zuerst stellen Sie den Sicherheitsvorfall nach, indem Sie Aktivitäten über das erste Nutzerkonto generieren. Als Nächstes exportieren Sie die Logs zur weiteren Analyse. Anschließend stellen Sie den Vorfall weiter nach und generieren zusätzliche Nutzeraktivitäten. Zum Schluss analysieren Sie die Logs mit BigQuery.

Einrichtung

Bevor Sie auf „Lab starten“ klicken

Lesen Sie diese Anleitung. Labs sind zeitlich begrenzt und können nicht pausiert werden. Der Timer beginnt zu laufen, wenn Sie auf Lab starten klicken, und zeigt Ihnen, wie lange die Ressourcen für das Lab verfügbar sind.

In diesem praxisorientierten Lab führen Sie die Aktivitäten eigenständig in einer echten Cloud-Umgebung durch, nicht in einer Simulation oder einer Demo-Umgebung. Dazu erhalten Sie neue, temporäre Anmeldedaten, mit denen Sie für die Dauer des Labs auf Google Cloud zugreifen können.

Für dieses Lab benötigen Sie Folgendes:

- Einen Standardbrowser (empfohlen wird Chrome)

Hinweis: Nutzen Sie den privaten oder Inkognitomodus, um dieses Lab durchzuführen. So wird verhindert, dass es zu Konflikten zwischen Ihrem persönlichen Konto und dem Teilnehmerkonto kommt und zusätzliche Gebühren für Ihr persönliches Konto erhoben werden.

- Zeit für die Durchführung des Labs – denken Sie daran, dass Sie ein begonnenes Lab nicht unterbrechen können.

Hinweis: Wenn Sie über ein persönliches Google Cloud-Konto oder -Projekt verfügen, verwenden Sie es nicht für dieses Lab. So werden zusätzliche Kosten für Ihr Konto vermieden.

Lab starten und bei der Google Cloud Console anmelden

-

Klicken Sie auf Lab starten. Auf der linken Seite befindet sich der Bereich Details zum Lab mit diesen Informationen:

- Restzeit

- Schaltfläche Google Cloud Console öffnen

- Temporäre Anmeldedaten für das Lab

- Ggf. weitere Informationen für dieses Lab

Hinweis: Wenn Sie für das Lab bezahlen müssen, wird ein Pop-up-Fenster geöffnet, in dem Sie Ihre Zahlungsmethode auswählen können.

-

Klicken Sie auf Google Cloud Console öffnen (oder klicken Sie mit der rechten Maustaste und wählen Sie Link in Inkognitofenster öffnen aus, wenn Sie Chrome verwenden). Die Anmeldeseite wird in einem neuen Browsertab geöffnet.

Tipp: Sie können die Tabs in getrennten Fenstern nebeneinander anordnen, um bequem zwischen ihnen zu wechseln.

Hinweis: Wenn das Dialogfeld Konto auswählen angezeigt wird, klicken Sie auf Anderes Konto verwenden.

-

Kopieren Sie bei Bedarf den folgenden Google Cloud-Nutzernamen und fügen Sie ihn in das Dialogfeld Anmelden ein. Klicken Sie dann auf Weiter.

{{{user_0.username | "Google Cloud username"}}}

Sie finden den Google Cloud-Nutzernamen auch im Bereich Details zum Lab.

- Kopieren Sie das folgende Google Cloud-Passwort und fügen Sie es in das Dialogfeld Willkommen ein. Klicken Sie dann auf Weiter.

{{{user_0.password | "Google Cloud password"}}}

Sie finden das Google Cloud-Passwort auch im Bereich Details zum Lab.

Wichtig: Sie müssen die für das Lab bereitgestellten Anmeldedaten verwenden. Nutzen Sie nicht die Anmeldedaten Ihres Google Cloud-Kontos.

Hinweis: Wenn Sie Ihr eigenes Google Cloud-Konto für dieses Lab nutzen, können zusätzliche Kosten anfallen.

- Klicken Sie sich durch die nachfolgenden Seiten:

- Akzeptieren Sie die Nutzungsbedingungen.

- Fügen Sie keine Wiederherstellungsoptionen oder 2-Faktor-Authentifizierung hinzu (da dies nur ein temporäres Konto ist).

- Melden Sie sich nicht für kostenlose Testzeiträume an.

Nach wenigen Augenblicken wird die Console in diesem Tab geöffnet.

Hinweis: Wenn Sie sich eine Liste der Google Cloud-Produkte und ‑Dienste ansehen möchten, klicken Sie oben links auf das Navigationsmenü.

Cloud Shell aktivieren

Die Cloud Shell ist eine Umgebung für Online-Entwicklung und -Betrieb, auf die Sie mit Ihrem Browser von einem beliebigen Standort aus zugreifen können. Mit der Cloud Shell erhalten Sie Befehlszeilenzugriff auf Ihre Google Cloud-Ressourcen.

- Klicken Sie oben rechts in der Google Cloud Console auf Cloud Shell aktivieren (

). Möglicherweise müssen Sie auf Weiter klicken.

). Möglicherweise müssen Sie auf Weiter klicken.

Nach dem Start der Cloud Shell wird eine Nachricht mit der Google Cloud-Projekt-ID für diese Sitzung angezeigt:

Ihr Cloud-Projekt in dieser Sitzung ist festgelegt als YOUR_PROJECT_ID

Das Befehlszeilentool für Google Cloud, gcloud, ist in der Cloud Shell vorinstalliert und unterstützt die Tab-Vervollständigung. Um auf Google Cloud zuzugreifen, müssen Sie zuerst gcloud autorisieren.

- Mit diesem Befehl können Sie den Namen des aktiven Kontos auflisten:

gcloud auth list

-

Ein Pop-up-Fenster wird angezeigt, in dem Sie aufgefordert werden, Cloud Shell zu autorisieren. Klicken Sie auf Autorisieren.

-

Die Ausgabe sollte jetzt so aussehen:

Ausgabe:

ACTIVE: *

ACCOUNT: student-01-xxxxxxxxxxxx@qwiklabs.net

To set the active account, run:

$ gcloud config set account `ACCOUNT`

- Listen Sie die Projekt-ID mit diesem Befehl auf:

gcloud config list project

Beispielausgabe:

[core]

project = qwiklabs-gcp-44776a13dea667a6

Hinweis: Die vollständige Dokumentation für gcloud finden Sie in Google Cloud in der Übersicht zur gcloud CLI.

Aufgabe 1: Kontoaktivität generieren

Hinweis: Achten Sie darauf, dass Sie in der Google Cloud Console als Nutzername 1: angemeldet sind.

In dieser Aufgabe erstellen und löschen Sie Cloud-Ressourcen, um Kontoaktivitäten zu generieren, auf die Sie als Cloud-Audit-Logs zugreifen.

- Kopieren Sie die folgenden Befehle in das Cloud Shell-Terminal:

gcloud storage buckets create gs://$DEVSHELL_PROJECT_ID

echo "this is a sample file" > sample.txt

gcloud storage cp sample.txt gs://$DEVSHELL_PROJECT_ID

gcloud compute networks create mynetwork --subnet-mode=auto

export ZONE=$(gcloud compute project-info describe \

--format="value(commonInstanceMetadata.items[google-compute-default-zone])")

gcloud compute instances create default-us-vm \

--machine-type=e2-micro \

--zone=$ZONE --network=mynetwork

gcloud storage rm --recursive gs://$DEVSHELL_PROJECT_ID

- Drücken Sie die Eingabetaste.

Klicken Sie auf Fortschritt prüfen, um zu sehen, ob Sie die Aufgabe richtig ausgeführt haben.

Kontoaktivität generieren

Aufgabe 2: Audit-Logs exportieren

Hinweis: Achten Sie darauf, dass Sie in der Google Cloud Console als Nutzername 1: angemeldet sind.

Die Aktivität, die Sie in der vorherigen Aufgabe generiert haben, wurde als Audit-Log aufgezeichnet. In dieser Aufgabe exportieren Sie diese Logs in ein BigQuery-Dataset, um sie weiter zu analysieren.

- Geben Sie in der Titelleiste der Google Cloud Console Log-Explorer in das Suchfeld ein und klicken Sie dann in den Suchergebnissen auf Log-Explorer. Die Seite Log-Explorer wird geöffnet.

- Klicken Sie neben Logging für Beobachtbarkeit auf Anpinnen.

- Beim Exportieren von Logs wird der aktuelle Filter auf die exportierten Daten angewendet. Kopieren Sie die folgende Abfrage in den Query Builder:

logName = ("projects/{{{project_0.project_id | Project ID}}}/logs/cloudaudit.googleapis.com%2Factivity")

- Klicken Sie auf Abfrage ausführen. Die Abfrageergebnisse sollten im Bereich Abfrageergebnisse angezeigt werden. Diese Abfrage filtert nach Cloud-Audit-Logs in Ihrem Projekt.

- Klicken Sie unter dem Feld Abfrageeditor auf Aktionen > Senke erstellen. Das Dialogfeld Logroutingsenke erstellen wird geöffnet.

Hinweis: Wenn Ihr Browserfenster schmal ist, wird in der Benutzeroberfläche möglicherweise Mehr anstelle von Weitere Aktionen angezeigt.

- Geben Sie im Dialogfeld Logroutingsenke erstellen die folgenden Einstellungen an und übernehmen Sie für alle anderen die Standardeinstellungen:

| Bereich |

Feld: Werte |

| Senkendetails |

Name der Senke: AuditLogsExport

Klicken Sie auf Weiter. |

| Senkenziel |

Senkendienst auswählen: BigQuery-Dataset

BigQuery-Dataset auswählen: Erstellen Sie ein neues BigQuery-Dataset.

Das Dialogfeld Dataset erstellen wird geöffnet. |

| Dataset erstellen |

Dataset-ID: auditlogs_dataset

Klicken Sie auf Dataset erstellen.

Das Dialogfeld Dataset erstellen wird geschlossen und Sie kehren zum Dialogfeld Senkenziel zurück. |

| Senkenziel |

Klicken Sie auf Weiter.

Entfernen Sie das Häkchen aus dem Kästchen Partitionierte Tabellen verwenden, falls es bereits ausgewählt ist, und klicken Sie auf Weiter. |

| Logs auswählen, die in der Senke enthalten sind |

Der Einschlussfilter ist bereits ausgefüllt: logName=("projects/[PROJECT ID]/logs/cloudaudit.googleapis.com%2Factivity")

Klicken Sie auf Weiter.

Klicken Sie auf Senke erstellen.

Kehren Sie zur Seite Log-Explorer zurück. |

- Klicken Sie im Navigationsbereich Logging auf Logrouter, um die Senke AuditLogsExport in der Liste Log-Router-Senken aufzurufen.

- Klicken Sie neben der Senke AuditLogsExport auf Weitere Aktionen (

) > Senkendetails ansehen, um Informationen zur erstellten Senke AuditLogsExport aufzurufen. Das Dialogfeld Senkendetails wird geöffnet.

) > Senkendetails ansehen, um Informationen zur erstellten Senke AuditLogsExport aufzurufen. Das Dialogfeld Senkendetails wird geöffnet.

- Klicken Sie auf Abbrechen, um das Dialogfeld Senkendetails zu schließen, wenn Sie sich die Informationen zur Senke angesehen haben.

Alle zukünftigen Logs werden jetzt nach BigQuery exportiert und die BigQuery-Tools können verwendet werden, um die Audit-Log-Daten zu analysieren. Beim Export werden keine vorhandenen Logeinträge exportiert.

Klicken Sie auf Fortschritt prüfen, um zu sehen, ob Sie die Aufgabe richtig ausgeführt haben.

Audit-Logs exportieren

Aufgabe 3: Mehr Kontoaktivität generieren

Hinweis: Achten Sie darauf, dass Sie in der Google Cloud Console als Nutzername 1: angemeldet sind.

In dieser Aufgabe erstellen und löschen Sie Cloud-Ressourcen, um zusätzliche Kontoaktivitäten zu generieren. Anschließend greifen Sie in BigQuery darauf zu, um weitere Informationen aus den Logs zu extrahieren.

- Kopieren Sie die folgenden Befehle in das Cloud Shell-Terminal:

gcloud storage buckets create gs://$DEVSHELL_PROJECT_ID

gcloud storage buckets create gs://$DEVSHELL_PROJECT_ID-test

echo "this is another sample file" > sample2.txt

gcloud storage cp sample.txt gs://$DEVSHELL_PROJECT_ID-test

export ZONE=$(gcloud compute project-info describe \

--format="value(commonInstanceMetadata.items[google-compute-default-zone])")

gcloud compute instances delete --zone=$ZONE \

--delete-disks=all default-us-vm

Diese Befehle erzeugen mehr Aktivität, die in den nach BigQuery exportierten Audit-Logs angezeigt werden kann.

- Drücken Sie die Eingabetaste.

Geben Sie bei entsprechender Aufforderung Y ein und drücken Sie die Eingabetaste. Sie haben zwei Buckets erstellt und eine Compute Engine-Instanz gelöscht.

- Wenn nach einigen Minuten die Eingabeaufforderung angezeigt wird, geben Sie die folgenden Befehle in das Cloud Shell-Terminal ein:

gcloud storage rm --recursive gs://$DEVSHELL_PROJECT_ID

gcloud storage rm --recursive gs://$DEVSHELL_PROJECT_ID-test

- Drücken Sie die Eingabetaste.

Sie haben beide Buckets gelöscht.

Klicken Sie auf Fortschritt prüfen, um zu sehen, ob Sie die Aufgabe richtig ausgeführt haben.

Mehr Kontoaktivität generieren

Aufgabe 4: Als zweite Nutzerin bzw. zweiter Nutzer anmelden

Sie müssen das Google Cloud-Konto wechseln, indem Sie sich mit dem zweiten Nutzerkonto, das im Bereich Details zum Lab angegeben ist, in der Google Cloud Console anmelden. Mit diesem Nutzerkonto analysieren Sie die Logs.

- Klicken Sie in der Google Cloud Console auf das Nutzersymbol oben rechts und dann auf Konto hinzufügen.

- Gehen Sie zurück zum Bereich Details zum Lab, kopieren Sie den Google Cloud-Nutzernamen 2: und das Passwort. Fügen Sie dann den Nutzernamen und das Passwort in das Dialogfeld Anmelden der Google Cloud Console ein.

Aufgabe 5: Administratoraktivitätslogs analysieren

Hinweis: Achten Sie darauf, dass Sie in der Google Cloud Console als Nutzername 2: angemeldet sind.

In dieser Aufgabe überprüfen Sie die in der vorherigen Aufgabe generierten Logs zu Administratoraktivitäten. Ihre Aufgabe ist es, Filter zu identifizieren und anzuwenden, um Logs zu isolieren, die auf verdächtige Aktivitäten hindeuten könnten. So können Sie diese Teilmenge von Logs exportieren und die Analyse potenzieller Probleme vereinfachen.

Logs zu Administratoraktivitäten enthalten Logeinträge für API-Aufrufe und andere Verwaltungsaktionen, mit denen die Konfiguration oder die Metadaten von Ressourcen geändert werden. In den Logs wird beispielsweise das Erstellen von VM-Instanzen und App Engine-Anwendungen sowie das Ändern von Berechtigungen aufgezeichnet.

Hinweis: Sie können Audit-Logeinträge in der Loganzeige, in Cloud Logging und im Cloud SDK aufrufen. Sie können Audit-Logeinträge auch nach Pub/Sub, BigQuery oder Cloud Storage exportieren.

- Geben Sie in der Titelleiste der Google Cloud Console Log-Explorer in das Suchfeld ein und klicken Sie dann in den Suchergebnissen auf Log-Explorer. Die Seite Log-Explorer wird geöffnet.

- Klicken Sie neben Logging für Beobachtbarkeit auf Anpinnen.

- Achten Sie darauf, dass der Ein/Aus-Button Abfrage anzeigen aktiviert ist. Dadurch wird das Feld Query Builder geöffnet.

- Kopieren Sie den folgenden Befehl und fügen Sie ihn in das Feld Query Builder ein. Beachten Sie die Projekt-ID Ihres Google Cloud-Projekts in dem Befehl.

logName = ("projects/{{{project_0.project_id | "PROJECT_ID"}}}/logs/cloudaudit.googleapis.com%2Factivity")

- Klicken Sie auf Abfrage ausführen.

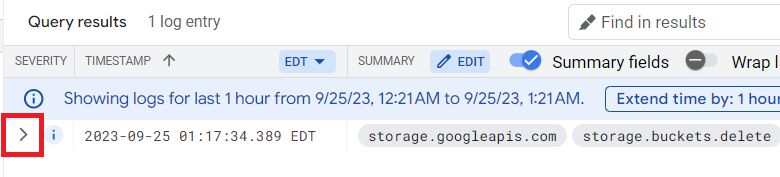

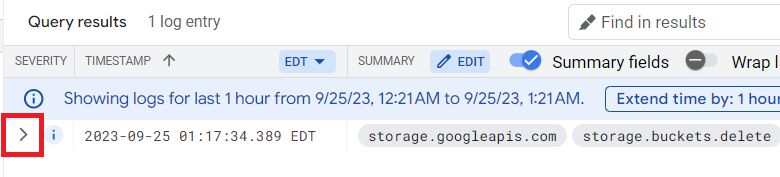

- Suchen Sie in den Abfrageergebnissen nach dem Logeintrag, der angibt, dass ein Cloud Storage-Bucket gelöscht wurde. Er enthält das Zusammenfassungsfeld storage.buckets.delete. Zusammenfassungsfelder sind in den Logergebnissen enthalten, um wichtige Informationen zum Logeintrag hervorzuheben.

Dieser Eintrag bezieht sich auf storage.googleapis.com, das die Methode storage.buckets.delete aufruft, um einen Bucket zu löschen. Der Bucket-Name ist derselbe wie Ihre Projekt-ID: .

- Klicken Sie in diesem Eintrag auf den Text storage.googleapis.com und wählen Sie Übereinstimmende Einträge anzeigen aus. Unter Abfrageergebnisse sollten jetzt nur noch sechs Einträge zu erstellten und gelöschten Cloud Storage-Buckets angezeigt werden.

- Im Feld „Abfrageeditor“ wurde die Zeile protoPayload.serviceName="storage.googleapis.com" zum Query Builder hinzugefügt. Dadurch werden nur Einträge gefiltert, die storage.googleapis.com entsprechen.

- Klicken Sie in den Abfrageergebnissen in einem der Einträge auf storage.buckets.delete und wählen Sie Übereinstimmende Einträge anzeigen aus.

Es wurde eine weitere Zeile zum Textfeld Query Builder hinzugefügt:

logName = ("projects/{{{project_0.project_id | "PROJECT_ID"}}}/logs/cloudaudit.googleapis.com%2Factivity")

protoPayload.serviceName="storage.googleapis.com"

protoPayload.methodName="storage.buckets.delete"

In den Abfrageergebnissen sollten jetzt alle Einträge zu gelöschten Cloud Storage-Buckets angezeigt werden. So können Sie bestimmte Ereignisse ganz einfach finden.

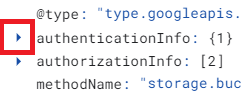

- Maximieren Sie in den Abfrageergebnissen ein storage.buckets.delete-Ereignis, indem Sie auf den Pfeil > neben der Zeile klicken:

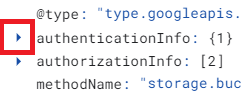

- Maximieren Sie das Feld authenticatitonInfo, indem Sie auf den Pfeil > neben der Zeile klicken:

Beachten Sie das Feld principalEmail, in dem die E-Mail-Adresse des Nutzerkontos angezeigt wird, das diese Aktion ausgeführt hat. Das ist das Nutzerkonto 1, das Sie zum Generieren der Nutzeraktivität verwendet haben.

Aufgabe 6: Audit-Logs mit BigQuery analysieren

Hinweis: Achten Sie darauf, dass Sie in der Google Cloud Console als Nutzername 2: angemeldet sind.

Sie haben Logs generiert und in ein BigQuery-Dataset exportiert. In dieser Aufgabe analysieren Sie die Logs mit dem Abfrageeditor.

Hinweis: Wenn Sie die Logs in ein BigQuery-Dataset exportieren, werden in Cloud Logging für die exportierten Logeinträge datierte Tabellen erstellt. Die Namen der Tabellen, in denen die Logeinträge platziert werden, basieren auf den Lognamen der Einträge.

Die BigQuery Console öffnen

-

Klicken Sie in der Google Cloud Console im Navigationsmenü auf BigQuery.

Daraufhin wird das Dialogfeld Willkommen bei BigQuery in der Cloud Console geöffnet, das einen Link zur Kurzanleitung und Informationen zu Aktualisierungen der Benutzeroberfläche enthält.

-

Klicken Sie auf Fertig, um das Dialogfeld zu schließen.

- Klicken Sie im Bereich Klassischer Explorer auf den Pfeil neben Ihrem Projekt . Das Dataset auditlogs_dataset wird angezeigt.

Hinweis: Wenn auditlogs_dataset nicht angezeigt wird, aktualisieren Sie das Browserfenster.

Als Nächstes prüfen Sie, ob das BigQuery-Dataset die entsprechenden Berechtigungen hat, damit der Export Writer Logeinträge speichern kann.

-

Klicken Sie auf das Dataset auditlogs_dataset.

-

Klicken Sie in der Symbolleiste „auditlogs_dataset“ auf das Drop-down-Menü Freigeben und wählen Sie Berechtigungen verwalten aus.

-

Maximieren Sie auf der Seite Berechtigung für „auditlogs_dataset“ freigeben den Abschnitt BigQuery-Dateneditor.

-

Prüfen Sie, ob das für den Logexport verwendete Dienstkonto eine aufgeführte Berechtigung ist. Das Dienstkonto sieht in etwa so aus: service-xxxxxxxx@gcp-sa-logging.iam.gserviceaccount.com

Diese Berechtigung wird automatisch zugewiesen, wenn der Logexport konfiguriert wird. Sie können also damit prüfen, ob der Logexport konfiguriert wurde.

-

Klicken Sie auf Schließen, um das Fenster Dataset freigeben zu schließen.

-

Klicken Sie im Bereich Klassischer Explorer auf den Pfeil neben dem Dataset auditlogs_dataset, um die Tabelle cloudaudit_googleapis_com_acitivty aufzurufen. Diese Tabelle enthält Ihre exportierten Logs.

-

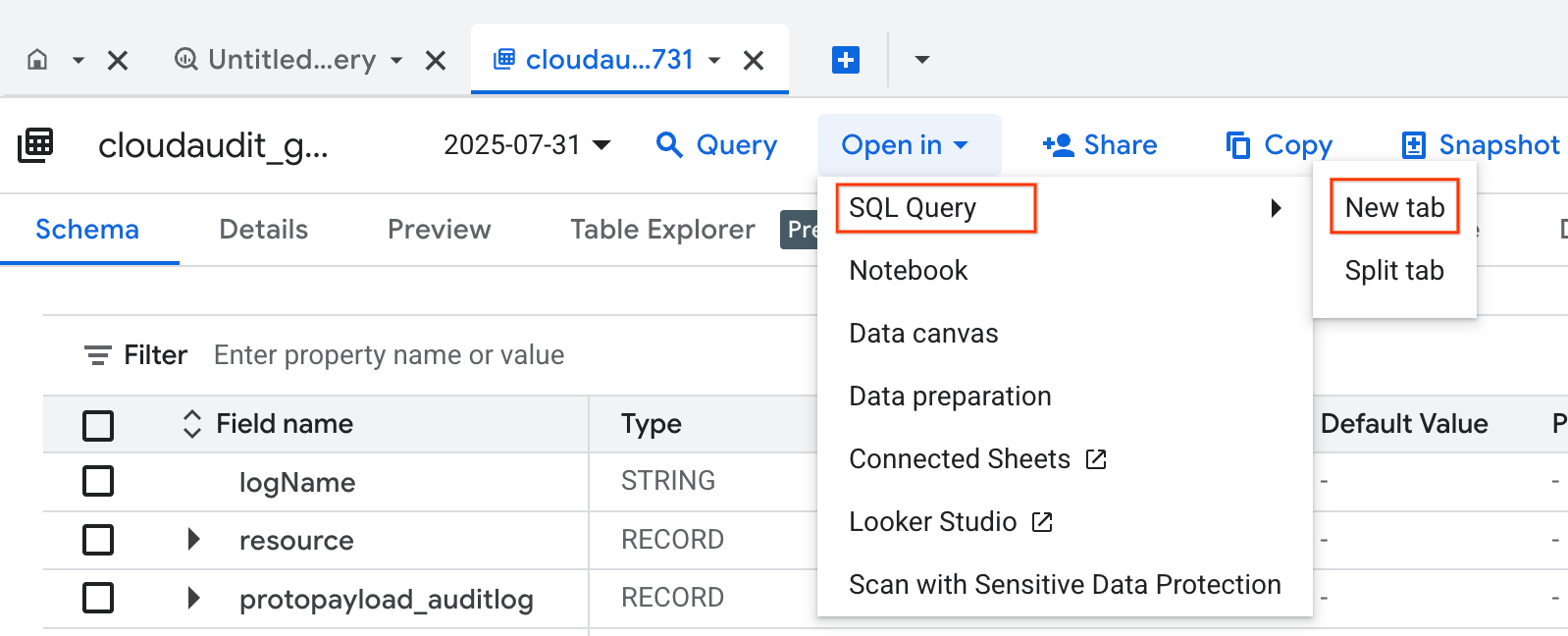

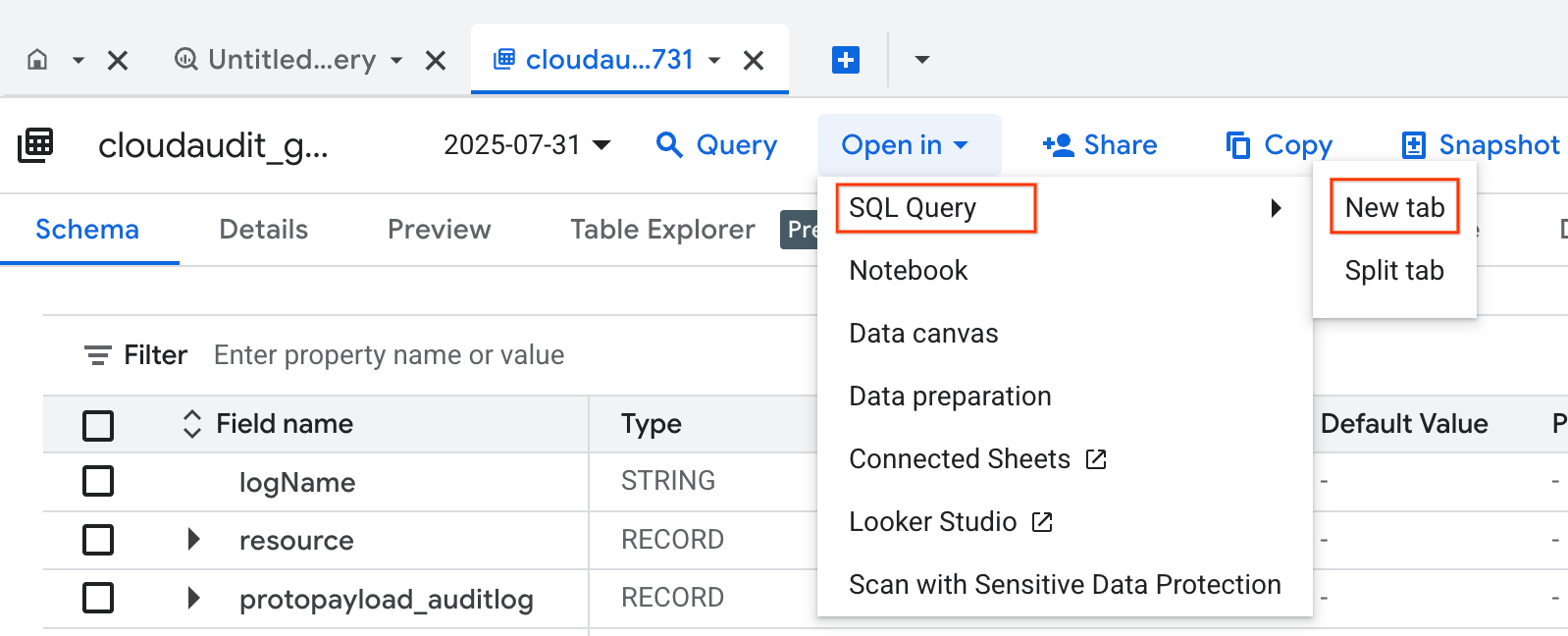

Wählen Sie die Tabelle cloudaudit_googleapis_com_activity aus. Das Tabellenschema wird angezeigt. Sehen Sie sich das Tabellenschema und die Details an.

-

Maximieren Sie das Drop-down-Menü Öffnen in und wählen Sie SQL-Abfrage > Neuer Tab aus.

- Löschen Sie auf dem Tab Unbenannte Abfrage des Query Builders vorhandenen Text und kopieren Sie den folgenden Befehl und fügen Sie ihn ein:

SELECT

timestamp,

resource.labels.instance_id,

protopayload_auditlog.authenticationInfo.principalEmail,

protopayload_auditlog.resourceName,

protopayload_auditlog.methodName

FROM

`auditlogs_dataset.cloudaudit_googleapis_com_activity_*`

WHERE

PARSE_DATE('%Y%m%d', _TABLE_SUFFIX) BETWEEN

DATE_SUB(CURRENT_DATE(), INTERVAL 7 DAY) AND

CURRENT_DATE()

AND resource.type = "gce_instance"

AND operation.first IS TRUE

AND protopayload_auditlog.methodName = "v1.compute.instances.delete"

ORDER BY

timestamp,

resource.labels.instance_id

LIMIT

1000;

Diese Abfrage gibt die Nutzerinnen und Nutzer zurück, die in den letzten 7 Tagen virtuelle Maschinen gelöscht haben.

- Klicken Sie auf Ausführen.

Nach ein paar Sekunden gibt BigQuery alle Nutzerinnen und Nutzer aus, die in den letzten 7 Tagen eine virtuelle Compute Engine-Maschine gelöscht haben. Sie sollten einen Eintrag sehen. Das ist die Aktivität, die Sie in den vorherigen Aufgaben als Nutzer 1 generiert haben. Denken Sie daran, dass in BigQuery nur die Aktivitäten angezeigt werden, die nach dem Erstellen des Exports stattgefunden haben.

- Ersetzen Sie die vorherige Abfrage auf dem Tab Unbenannte Abfrage durch die folgende:

SELECT

timestamp,

resource.labels.bucket_name,

protopayload_auditlog.authenticationInfo.principalEmail,

protopayload_auditlog.resourceName,

protopayload_auditlog.methodName

FROM

`auditlogs_dataset.cloudaudit_googleapis_com_activity_*`

WHERE

PARSE_DATE('%Y%m%d', _TABLE_SUFFIX) BETWEEN

DATE_SUB(CURRENT_DATE(), INTERVAL 7 DAY) AND

CURRENT_DATE()

AND resource.type = "gcs_bucket"

AND protopayload_auditlog.methodName = "storage.buckets.delete"

ORDER BY

timestamp,

resource.labels.instance_id

LIMIT

1000;

Diese Abfrage gibt die Nutzerinnen und Nutzer zurück, die in den letzten 7 Tagen Cloud Storage-Buckets gelöscht haben. Sie sollten zwei Einträge sehen. Das ist die Aktivität, die Sie in den vorherigen Aufgaben als Nutzer 1 generiert haben.

- Klicken Sie auf Ausführen.

Die Möglichkeit, Audit-Logs in BigQuery zu analysieren, ist sehr leistungsstark. In dieser Aktivität haben Sie sich nur zwei Beispiele für das Abfragen von Audit-Logs angesehen.

Klicken Sie auf Fortschritt prüfen, um zu sehen, ob Sie die Aufgabe richtig ausgeführt haben.

Audit-Logs mit BigQuery analysieren

Fazit

Gut gemacht! Sie haben erfolgreich eine Abfrage im Log-Explorer ausgeführt. Anschließend haben Sie Logs exportiert und ein Dataset erstellt, das Sie in BigQuery analysiert haben.

Sie haben gezeigt, wie Sie Audit-Logs verwenden und nach Arten von schädlichen Aktivitäten filtern können, um diese Logs dann in BigQuery weiter zu analysieren und so Bedrohungen zu erkennen.

Lab beenden

Bevor Sie das Lab beenden, sehen Sie nach, ob Sie alle Aufgaben erledigt haben. Wenn Sie soweit sind, klicken Sie auf Lab beenden und dann auf Senden.

Wenn Sie das Lab beenden, haben Sie keinen Zugriff mehr auf die Lab-Umgebung und können auch nicht mehr auf die darin ausgeführten Aufgaben zugreifen.

© 2026 Google LLC. Alle Rechte vorbehalten. Google und das Google-Logo sind Marken von Google LLC. Alle anderen Unternehmens- und Produktnamen können Marken der jeweils mit ihnen verbundenen Unternehmen sein.

WICHTIG:

WICHTIG: Dieses Lab sollte nur auf einem Computer oder Laptop durchgeführt werden.

Dieses Lab sollte nur auf einem Computer oder Laptop durchgeführt werden. Pro Lab sind nur 5 Versuche zulässig.

Pro Lab sind nur 5 Versuche zulässig. Zur Erinnerung: Es ist ganz normal, beim ersten Versuch nicht alle Fragen richtig zu beantworten oder eine Aufgabe wiederholen zu müssen – das gehört zum Lernprozess.

Zur Erinnerung: Es ist ganz normal, beim ersten Versuch nicht alle Fragen richtig zu beantworten oder eine Aufgabe wiederholen zu müssen – das gehört zum Lernprozess. Sobald ein Lab gestartet wurde, kann der Timer nicht mehr pausiert werden. Nach 1 Stunde und 30 Minuten wird das Lab beendet und Sie müssen von vorne beginnen.

Sobald ein Lab gestartet wurde, kann der Timer nicht mehr pausiert werden. Nach 1 Stunde und 30 Minuten wird das Lab beendet und Sie müssen von vorne beginnen. Weitere Informationen finden Sie in den technischen Tipps zum Lab.

Weitere Informationen finden Sie in den technischen Tipps zum Lab.

). Möglicherweise müssen Sie auf Weiter klicken.

). Möglicherweise müssen Sie auf Weiter klicken. ) > Senkendetails ansehen, um Informationen zur erstellten Senke AuditLogsExport aufzurufen. Das Dialogfeld Senkendetails wird geöffnet.

) > Senkendetails ansehen, um Informationen zur erstellten Senke AuditLogsExport aufzurufen. Das Dialogfeld Senkendetails wird geöffnet.