WICHTIG:

WICHTIG:

Dieses Lab sollte nur auf einem Computer oder Laptop durchgeführt werden.

Dieses Lab sollte nur auf einem Computer oder Laptop durchgeführt werden.

Pro Lab sind nur 5 Versuche zulässig.

Pro Lab sind nur 5 Versuche zulässig.

Zur Erinnerung: Es ist ganz normal, beim ersten Versuch nicht alle Fragen richtig zu beantworten oder eine Aufgabe wiederholen zu müssen – das gehört zum Lernprozess.

Zur Erinnerung: Es ist ganz normal, beim ersten Versuch nicht alle Fragen richtig zu beantworten oder eine Aufgabe wiederholen zu müssen – das gehört zum Lernprozess.

Sobald ein Lab gestartet wurde, kann der Timer nicht mehr pausiert werden. Nach 1 Stunde und 30 Minuten wird das Lab beendet und Sie müssen von vorne beginnen.

Sobald ein Lab gestartet wurde, kann der Timer nicht mehr pausiert werden. Nach 1 Stunde und 30 Minuten wird das Lab beendet und Sie müssen von vorne beginnen.

Weitere Informationen finden Sie in den technischen Tipps zum Lab.

Weitere Informationen finden Sie in den technischen Tipps zum Lab.

Aktivitätsübersicht

Eine Datenpipeline ist eine Reihe von Prozessen, mit denen Daten aus verschiedenen Quellen an ein Ziel zur Speicherung und Analyse übertragen werden.

Datenpipelines können die Leistung und Effizienz der Datentransformation steigern, indem sie den Datenfluss automatisieren und die Datenverarbeitung optimieren.

Eine SQL-Pipeline kann Ihnen dabei helfen, die Leistung zu verbessern, indem Sie unnötige Schritte vermeiden. Das liegt daran, dass eine SQL-Pipeline Daten direkt im Ziel lesen und in das Ziel schreiben kann, ohne Zwischen-Datasets erstellen zu müssen. Das kann Zeit und Ressourcen sparen und die Genauigkeit Ihrer Ergebnisse verbessern.

Außerdem kann Ihnen eine SQL-Pipeline dabei helfen, die Kapazität Ihres Datenspeichers zu optimieren. Das liegt daran, dass Sie die Pipeline verwenden können, um nicht mehr benötigte Daten zu löschen oder zu archivieren. So können Sie Speicherplatz auf Ihren Speichersystemen freigeben und die Leistung verbessern.

Das Erstellen effizienter und flexibler SQL-Pipelines kann eine Herausforderung sein, besonders da sich die Anforderungen von Organisationen schnell ändern. Durch sorgfältige Planung und Gestaltung Ihrer Pipelines können Sie jedoch Pipelines erstellen, die sich auch an die komplexesten Datenanforderungen anpassen lassen.

In diesem Lab verwalten Sie Daten und verwenden SQL, um eine effiziente und flexible Pipeline zu erstellen, die eine geschäftliche Anforderung erfüllt.

Szenario

In den letzten Jahren ist der Gewinn von TheLook eCommerce dank Online-Shopping in die Höhe geschnellt. Die Lieferzeiten haben jedoch nicht Schritt gehalten und die Kundenzufriedenheit ist gesunken.

Als Cloud-Datenanalyst*in bei TheLook eCommerce sollen Sie mit Kai, dem Leiter des Logistikteams, zusammenarbeiten, um eine Datenpipeline zu entwickeln, mit der Daten zu Kundenlieferungen erfasst, bereinigt, transformiert und geladen werden können. Dazu gehört auch die zurückgelegte Entfernung vom Verteilzentrum zu den einzelnen Kunden.

Anhand dieser Informationen kann das Logistikteam bestimmen, wie es die Lieferzeiten verbessern und die Kundenzufriedenheit steigern kann, z. B. ob neue Verteilzentren eröffnet, bestehende Verteilzentren verlegt oder in neue Transportmethoden investiert werden sollte.

Sie wenden Ihre BigQuery- und SQL-Kenntnisse an, um eine flexible Pipeline zu entwickeln, die dem Logistikteam zuverlässige Daten zur besseren Überwachung der Lieferleistung bereitstellt und bei sich ändernden Datenanforderungen des Logistikteams problemlos aktualisiert werden kann.

Zuerst erstellen Sie ein Dataset und definieren Tabellenschemas für die aufzunehmenden Daten. Als Nächstes führen Sie eine Reihe von Transformationen durch und analysieren sie. Dann wenden Sie die Transformationen auf die Daten an, bevor Sie die transformierten Daten in neu definierte Tabellen laden. Abschließend formalisieren Sie diese Abfragen in einer gespeicherten Prozedur.

Einrichtung

Bevor Sie auf „Lab starten“ klicken

Lesen Sie diese Anleitung. Labs sind zeitlich begrenzt und können nicht pausiert werden. Der Timer beginnt zu laufen, wenn Sie auf Lab starten klicken, und zeigt Ihnen, wie lange die Ressourcen für das Lab verfügbar sind.

In diesem praxisorientierten Lab führen Sie die Aktivitäten eigenständig in einer echten Cloud-Umgebung durch, nicht in einer Simulation oder einer Demo-Umgebung. Dazu erhalten Sie neue, temporäre Anmeldedaten, mit denen Sie für die Dauer des Labs auf Google Cloud zugreifen können.

Für dieses Lab benötigen Sie Folgendes:

- Einen Standardbrowser (empfohlen wird Chrome)

Hinweis: Nutzen Sie den privaten oder Inkognitomodus, um dieses Lab durchzuführen. So wird verhindert, dass es zu Konflikten zwischen Ihrem persönlichen Konto und dem Teilnehmerkonto kommt und zusätzliche Gebühren für Ihr persönliches Konto erhoben werden.

- Zeit für die Durchführung des Labs – denken Sie daran, dass Sie ein begonnenes Lab nicht unterbrechen können.

Hinweis: Wenn Sie über ein persönliches Google Cloud-Konto oder -Projekt verfügen, verwenden Sie es nicht für dieses Lab. So werden zusätzliche Kosten für Ihr Konto vermieden.

Lab starten und bei der Google Cloud Console anmelden

-

Klicken Sie auf Lab starten. Auf der linken Seite befindet sich der Bereich Details zum Lab mit diesen Informationen:

- Restzeit

- Schaltfläche Google Cloud Console öffnen

- Temporäre Anmeldedaten für das Lab

- Ggf. weitere Informationen für dieses Lab

Hinweis: Wenn Sie für das Lab bezahlen müssen, wird ein Pop-up-Fenster geöffnet, in dem Sie Ihre Zahlungsmethode auswählen können.

-

Klicken Sie auf Google Cloud Console öffnen (oder klicken Sie mit der rechten Maustaste und wählen Sie Link in Inkognitofenster öffnen aus, wenn Sie Chrome verwenden). Die Anmeldeseite wird in einem neuen Browsertab geöffnet.

Tipp: Sie können die Tabs in getrennten Fenstern nebeneinander anordnen, um bequem zwischen ihnen zu wechseln.

Hinweis: Wenn das Dialogfeld Konto auswählen angezeigt wird, klicken Sie auf Anderes Konto verwenden.

-

Kopieren Sie bei Bedarf den folgenden Google Cloud-Nutzernamen und fügen Sie ihn in das Dialogfeld Anmelden ein. Klicken Sie dann auf Weiter.

{{{user_0.username | "Google Cloud username"}}}

Sie finden den Google Cloud-Nutzernamen auch im Bereich Details zum Lab.

- Kopieren Sie das folgende Google Cloud-Passwort und fügen Sie es in das Dialogfeld Willkommen ein. Klicken Sie dann auf Weiter.

{{{user_0.password | "Google Cloud password"}}}

Sie finden das Google Cloud-Passwort auch im Bereich Details zum Lab.

Wichtig: Sie müssen die für das Lab bereitgestellten Anmeldedaten verwenden. Nutzen Sie nicht die Anmeldedaten Ihres Google Cloud-Kontos.

Hinweis: Wenn Sie Ihr eigenes Google Cloud-Konto für dieses Lab nutzen, können zusätzliche Kosten anfallen.

- Klicken Sie sich durch die nachfolgenden Seiten:

- Akzeptieren Sie die Nutzungsbedingungen.

- Fügen Sie keine Wiederherstellungsoptionen oder 2-Faktor-Authentifizierung hinzu (da dies nur ein temporäres Konto ist).

- Melden Sie sich nicht für kostenlose Testzeiträume an.

Nach wenigen Augenblicken wird die Console in diesem Tab geöffnet.

Hinweis: Wenn Sie sich eine Liste der Google Cloud-Produkte und ‑Dienste ansehen möchten, klicken Sie oben links auf das Navigationsmenü.

Aufgabe 1: Dataset erstellen

In dieser Aufgabe erstellen Sie ein Dataset im vorhandenen Projekt und definieren das Schema und die Datentypen.

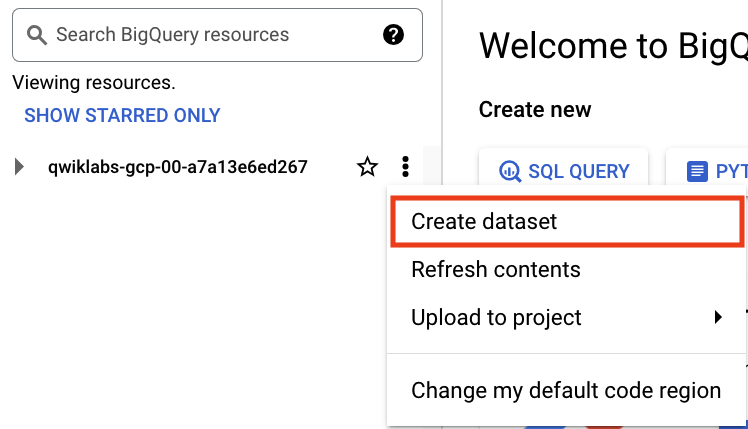

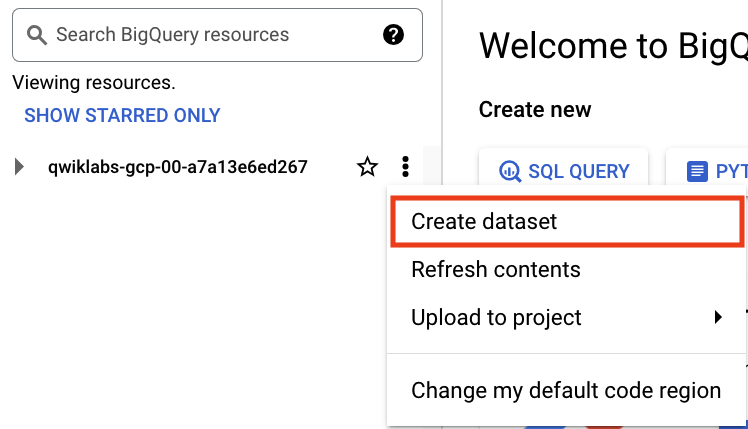

- Wählen Sie in der Cloud Console im Navigationsmenü (

) die Option BigQuery aus.

) die Option BigQuery aus.

Hinweis: Möglicherweise wird das Fenster Willkommen bei BigQuery in der Cloud Console angezeigt. Es enthält Links zur Kurzanleitung und zu den Versionshinweisen für Aktualisierungen der Benutzeroberfläche. Klicken Sie auf Fertig, um fortzufahren.

Das Navigationsmenü, der Bereich Explorer und der Abfrageeditor werden angezeigt.

- Klicken Sie neben der Projekt-ID auf das Symbol Aktionen ansehen (

) und klicken Sie auf Dataset erstellen.

) und klicken Sie auf Dataset erstellen.

Hinweis:Möglicherweise müssen Sie zuerst ein Projekt auswählen. Klicken Sie dazu in der Titelleiste der Google Cloud Console auf Projekt auswählen und wählen Sie dann im Dialogfeld Projekt auswählen den Projektlink aus.

-

Legen Sie im Bereich Dataset erstellen die Dataset-ID auf thelook_ecommerce fest. Prüfen Sie, ob der Standort auf „USA (multiregional)“ festgelegt ist, und übernehmen Sie für die anderen Felder die Standardwerte.

-

Klicken Sie auf Dataset erstellen.

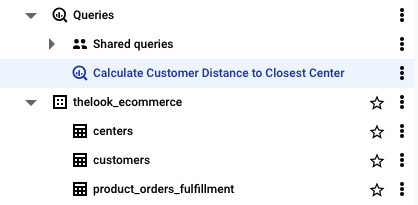

Das Dataset thelook_ecommerce wird jetzt unter dem Namen Ihres Projekts angezeigt.

- Klicken Sie im Abfrageeditor auf das Symbol SQL-Abfrage (+), um einen neuen Tab Unbenannte Abfrage zu öffnen, auf dem Sie die Abfrage ausführen können.

Hinweis: Jedes Mal, wenn Sie eine neue Abfrage im Abfrageeditor ausführen, können Sie die alte Abfrage entweder ersetzen, indem Sie die neue Abfrage auf demselben Tab Unbenannte Abfrage über die vorherige kopieren und einfügen, oder Sie können auf das Symbol SQL-Abfrage (+) klicken, um einen neuen Tab Unbenannte Abfrage zu öffnen, auf dem Sie die Abfrage ausführen können.

- Kopieren Sie die folgende Abfrage und fügen Sie sie auf dem Tab Unbenannte Abfrage ein, um die Tabelle

product_order_fulfillment zu erstellen:

--Create empty product_orders_fulfillment table

CREATE OR REPLACE TABLE

`thelook_ecommerce.product_orders_fulfillment`

( order_id INT64,

user_id INT64,

status STRING,

product_id INT64,

created_at TIMESTAMP,

returned_at TIMESTAMP,

shipped_at TIMESTAMP,

delivered_at TIMESTAMP,

cost NUMERIC,

sale_price NUMERIC,

retail_price NUMERIC,

category STRING,

name STRING,

brand STRING,

department STRING,

sku STRING,

distribution_center_id INT64);

- Klicken Sie auf Ausführen.

Hinweis:Mit dieser Abfrage wird eine neue Tabelle mit dem Namen product_orders_fulfillment erstellt, wenn sie noch nicht vorhanden ist. Andernfalls wird die vorhandene Tabelle durch die neue Tabellendefinition ersetzt.

- Klicken Sie auf Zur Tabelle, um sich das Tabellenschema und die erstellten Datentypen anzusehen.

Dieses Dataset ist derzeit leer. Hier werden die Daten eingefügt, sobald sie geladen sind.

Klicken Sie auf Fortschritt prüfen, um zu sehen, ob Sie die Aufgabe richtig ausgeführt haben.

Dataset erstellen

Aufgabe 2: Tabelle aus Abfrageergebnissen erstellen

Ihre Analyse weitet sich aus und umfasst nun auch die Nähe von Verteilzentren zu den Kunden, die Bestellungen aufgeben. Dazu müssen Sie Werte basierend auf geografischen Standorten berechnen.

In dieser Aufgabe erstellen Sie geometrische Punkte aus den Breiten- und Längengradwerten, die in den Tabellen original users und distribution_centers bereitgestellt werden.

- Kopieren Sie die folgende Abfrage in den Abfrageeditor:

--Create empty customers table

CREATE OR REPLACE TABLE

`thelook_ecommerce.customers`

( id INT64,

first_name STRING,

last_name STRING,

email STRING,

age INT64,

gender STRING,

state STRING,

street_address STRING,

postal_code STRING,

city STRING,

country STRING,

traffic_source STRING,

created_at TIMESTAMP,

latitude FLOAT64,

longitude FLOAT64,

point_location GEOGRAPHY);

--Create empty centers table

CREATE OR REPLACE TABLE

`thelook_ecommerce.centers`

( id INT64,

name STRING,

latitude FLOAT64,

longitude FLOAT64,

point_location GEOGRAPHY);

Mit dieser Abfrage werden die Tabellendefinitionen für die Tabellen „customers“ und „centers“ erstellt, die die ursprünglichen Spalten aus den Tabellen „users“ und „distribution_centers“ enthalten. Mit dieser Abfrage wird auch beiden Tabellen eine Spalte point_location hinzugefügt. Für diese Spalten wird der Datentyp auf „Geografie“ festgelegt.

- Klicken Sie auf Ausführen.

Klicken Sie auf Fortschritt prüfen, um zu sehen, ob Sie die Aufgabe richtig ausgeführt haben.

Neue Tabellen zum Speichern relevanter Daten erstellen

Aufgabe 3: BigQuery-Daten transformieren

In dieser Aufgabe erstellen Sie Punktgeometrien mit der Geografie-Funktion ST_GEOGPOINT, indem Sie ST_GEOGPOINT(lon, lat) aufrufen.

Führen Sie zuerst die folgenden SQL-Abfragen aus, um die Tabellen centers und customers zu erstellen und zu befüllen. Mit diesen Abfragen werden die Daten aus einer SELECT-Anweisung geladen, da sich der ursprüngliche Standort (Längengrad, Breitengrad) der Daten im öffentlichen BigQuery-Dataset thelook_ecommerce befindet.

Ein öffentliches Google-Dataset ist ein Dataset, das in BigQuery gespeichert ist und der Allgemeinheit über das Google Cloud Public Dataset-Programm zugänglich gemacht wird. Mit öffentlichen Datasets können Sie ganz einfach öffentlich verfügbare Daten in BigQuery verwenden, ohne sie laden und verwalten zu müssen.

- Kopieren Sie die folgende Abfrage in den Abfrageeditor:

--load the centers table from public dataset and include geography transformation

CREATE OR REPLACE TABLE

`thelook_ecommerce.centers` AS

SELECT

id,

name,

latitude,

longitude,

ST_GEOGPOINT(dcenters.longitude, dcenters.latitude) AS point_location

FROM

`bigquery-public-data.thelook_ecommerce.distribution_centers` AS dcenters;

Mit dieser Abfrage wird die Tabelle „centers“ geladen, einschließlich der Geografie-Transformation.

- Klicken Sie auf Ausführen.

Hinweis: Sie können auf Zur Tabelle klicken, um sich das Tabellenschema und die erstellten Datentypen anzusehen.

- Kopieren Sie nun die folgende Abfrage in den Abfrageeditor:

--load the customers table from public dataset and include geography transformation

CREATE OR REPLACE TABLE

`thelook_ecommerce.customers` AS

SELECT

id,

first_name,

last_name,

email,

age,

gender,

state,

street_address,

postal_code,

city,

country,

traffic_source,

created_at,

latitude,

longitude,

ST_GEOGPOINT(users.longitude, users.latitude) AS point_location

FROM

`bigquery-public-data.thelook_ecommerce.users` AS users;

Mit dieser Abfrage wird die Tabelle „customers“ geladen, einschließlich der Geografie-Transformation.

- Klicken Sie auf Ausführen.

Als Nächstes müssen Sie die Datenwerte für die Analyse berechnen.

Da die Beziehung zwischen Kunden und Verteilzentren wichtig ist, verwenden Sie diese geografischen Punktstandorte, um das nächstgelegene Verteilzentrum für jeden Kunden und die Entfernung dieser Standorte zu berechnen.

Verwenden Sie dazu die Geografiefunktion ST_DISTANCE, um die Mindestentfernung zwischen einem Kundenstandort und einem Zentrum zu berechnen.

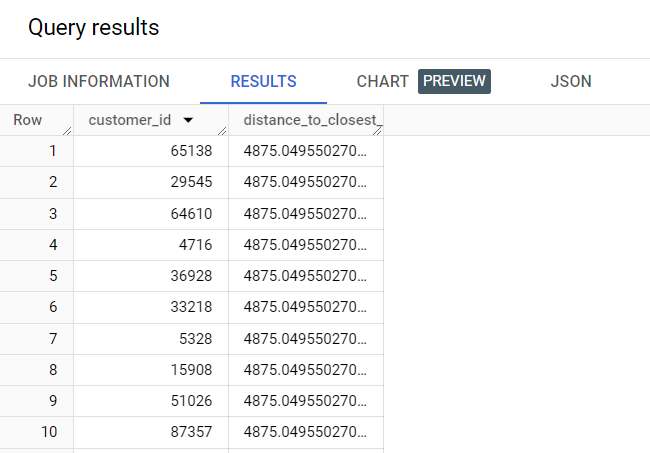

- Kopieren Sie die folgende skalare Unterabfrage in den Abfrageeditor:

SELECT

customers.id as customer_id,

(

SELECT

MIN(ST_DISTANCE(centers.point_location, customers.point_location))/1000,

FROM

`thelook_ecommerce.centers` AS centers) AS distance_to_closest_center

FROM

`thelook_ecommerce.customers` AS customers ;

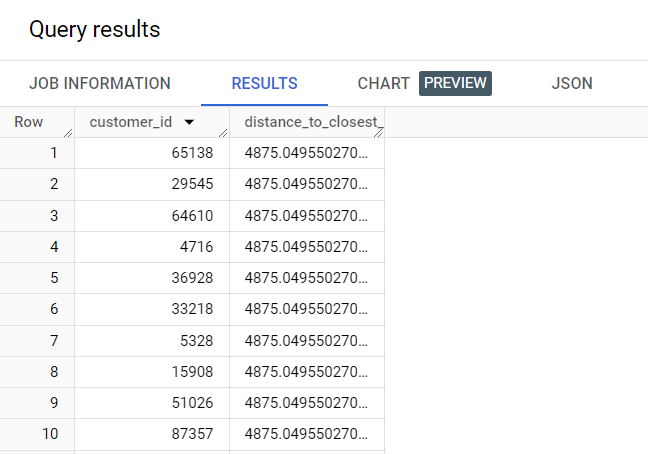

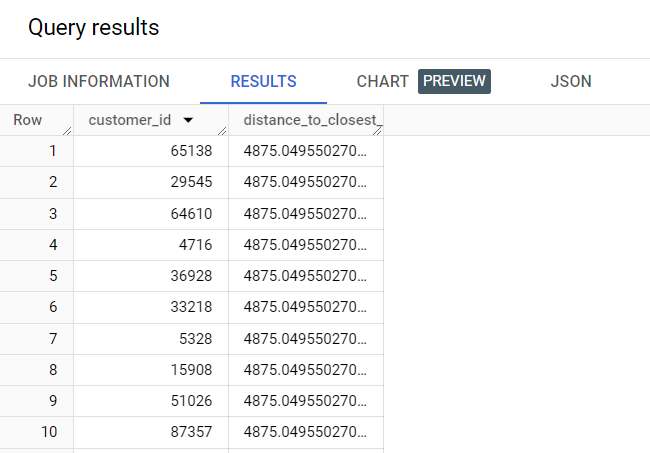

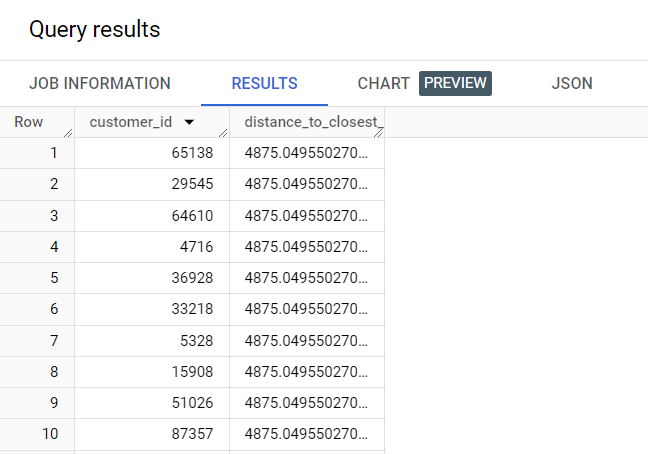

Mit dieser Abfrage wird die Entfernung in Kilometern berechnet.

- Klicken Sie auf Ausführen.

Wie im Screenshot zu sehen, gibt die Abfrage die Entfernung zwischen jedem Kunden und dem nächstgelegenen Verteilzentrum zurück. Sehen Sie sich die SELECT-Anweisung an, um zu verstehen, wie die Distanzberechnung abgeleitet wird.

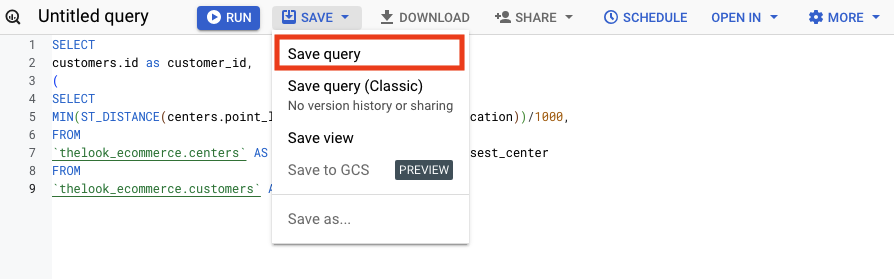

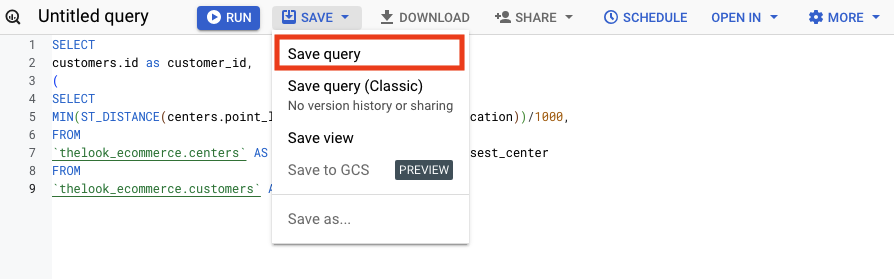

- Maximieren Sie das Drop-down-Menü Speichern und wählen Sie Abfrage speichern aus.

Das Dialogfeld Abfrage speichern wird geöffnet.

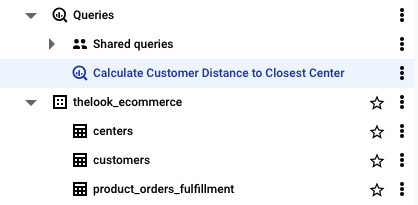

- Geben Sie im Feld Name den Namen

Calculate Customer Distance to Closest Center ein.

- Wählen Sie unter Region die Option aus.

- Klicken Sie auf Speichern.

Die Abfrage wird in der Liste Abfragen gespeichert.

Klicken Sie auf Fortschritt prüfen, um zu sehen, ob Sie die Aufgabe richtig ausgeführt haben.

Transformation von BigQuery-Daten durchführen

Aufgabe 4: Gespeicherte Prozedur erstellen, um Updates zu vereinfachen

Eine gespeicherte Prozedur ist ein Satz von SQL-Anweisungen, die in einer Datenbank gespeichert und als einzelne Einheit ausgeführt werden können.

In dieser Aufgabe erstellen Sie eine gespeicherte Prozedur, die alle Tabellendefinitionen, Transformationen und Aufnahmeanweisungen enthält, die Sie bisher in den Aufgaben 1 bis 3 manuell und sequenziell generiert haben.

Wenn Sie eine gespeicherte Prozedur erstellen möchten (in diesem Fall sp_create_load_tables), fügen Sie die Anweisung CREATE OR REPLACE PROCEDURE am Anfang des Skripts ein, gefolgt vom Namen der gespeicherten Prozedur und der Anweisung BEGIN. Nachdem Sie alle Komponenten der Prozedur hinzugefügt haben, fügen Sie die END-Anweisung ein.

Sie können Ihre Tabellendefinitionen und die Abschnitte für die Datenaufnahme in die Prozedur einfügen. Sie können je nach Präferenz alle Tabellendefinitionen voranstellen oder sie nach Tabelle in einem Cluster zusammenfügen. In diesem Lab folgt auf jede Tabellendefinition jedoch der Abschnitt zur Datenaufnahme und alle anderen Transformationen, die in den vorherigen Schritten durchgeführt wurden.

Sie können auch Spalten in Ihrer Kundentabelle erstellen, in denen die berechnete distance_to_closest_center und die closest_centervalues gespeichert werden. Der große Vorteil dieser Prozedur liegt darin, dass Sie sie ganz einfach aktualisieren oder erweitern können, wenn sich das Schema ändert oder Sie zusätzliche Spalten einfügen oder berechnete Spalten generieren möchten. Nach der Aktualisierung kann die gespeicherte Prozedur so eingerichtet werden, dass sie regelmäßig ausgeführt wird.

Erstellen Sie nun eine gespeicherte Prozedur, in der alle Schritte, die Sie zuvor in den Aufgaben 1 bis 3 ausgeführt haben, als eine Einheit ausgeführt werden. Wenn der folgende Code ausgeführt wird, werden die Tabellen aktualisiert und entsprechend mit Daten gefüllt.

- Kopieren Sie die folgende Abfrage in einen neuen Abfrage-Tab Unbenannt:

CREATE OR REPLACE PROCEDURE

`thelook_ecommerce.sp_create_load_tables`()

BEGIN

--Create empty product_orders_fulfillment table

CREATE OR REPLACE TABLE

`thelook_ecommerce.product_orders_fulfillment` ( order_id INT64,

user_id INT64,

status STRING,

product_id INT64,

created_at TIMESTAMP,

returned_at TIMESTAMP,

shipped_at TIMESTAMP,

delivered_at TIMESTAMP,

cost NUMERIC,

sale_price NUMERIC,

retail_price NUMERIC,

category STRING,

name STRING,

brand STRING,

department STRING,

sku STRING,

distribution_center_id INT64) ;

--load the product_order_fulfillment table from public dataset

CREATE OR REPLACE TABLE thelook_ecommerce.product_orders_fulfillment AS

SELECT

items.*,

products.id AS product_id_products,

products.name AS product_name,

products.category AS product_category,

FROM

bigquery-public-data.thelook_ecommerce.order_items AS items

JOIN

bigquery-public-data.thelook_ecommerce.products AS products

ON

(items.product_id = products.id);

--Create empty centers table

CREATE OR REPLACE TABLE

`thelook_ecommerce.centers` ( id INT64,

name STRING,

latitude FLOAT64,

longitude FLOAT64,

point_location GEOGRAPHY);

--load the centers table from public dataset and include geography transformation

CREATE OR REPLACE TABLE

`thelook_ecommerce.centers` AS

SELECT

id,

name,

latitude,

longitude,

ST_GEOGPOINT(dcenters.longitude, dcenters.latitude) AS point_location

FROM

`bigquery-public-data.thelook_ecommerce.distribution_centers` AS dcenters ;

--Create empty customers table

CREATE OR REPLACE TABLE

`thelook_ecommerce.customers` ( id INT64,

first_name STRING,

last_name STRING,

email STRING,

age INT64,

gender STRING,

state STRING,

street_address STRING,

postal_code STRING,

city STRING,

country STRING,

traffic_source STRING,

created_at TIMESTAMP,

latitude FLOAT64,

longitude FLOAT64,

point_location GEOGRAPHY);

--load the customers table from public dataset and include geography transformation

CREATE OR REPLACE TABLE

`thelook_ecommerce.customers` AS

SELECT

id,

first_name,

last_name,

email,

age,

gender,

state,

street_address,

postal_code,

city,

country,

traffic_source,

created_at,

latitude,

longitude,

ST_GEOGPOINT(users.longitude, users.latitude) AS point_location

FROM

`bigquery-public-data.thelook_ecommerce.users` AS users ;

END

;

- Klicken Sie auf Ausführen.

Hinweis: Mit der gespeicherten Prozedur werden alle erforderlichen Tabellen erstellt und mit den transformierten Daten gefüllt. Die gespeicherte Prozedur gibt jedoch nicht die Abfrageergebnisse zurück, die die Entfernung zwischen Kunden und ihrem nächstgelegenen Verteilzentrum zeigen. Fahren Sie dazu mit Schritt 7 unten fort.

- Maximieren Sie das Drop-down-Menü Speichern und wählen Sie Abfrage speichern aus. Das Dialogfeld Abfrage speichern wird geöffnet.

- Geben Sie im Feld Name den Namen

sp_create_load_tables ein.

- Wählen Sie unter Region die Option aus.

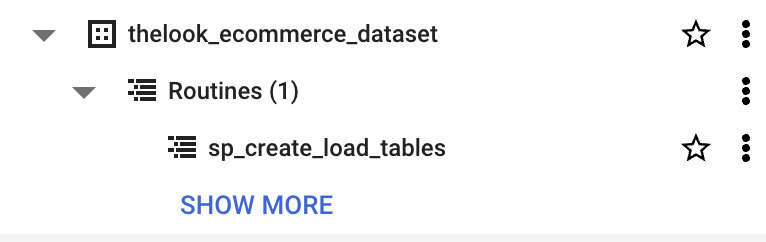

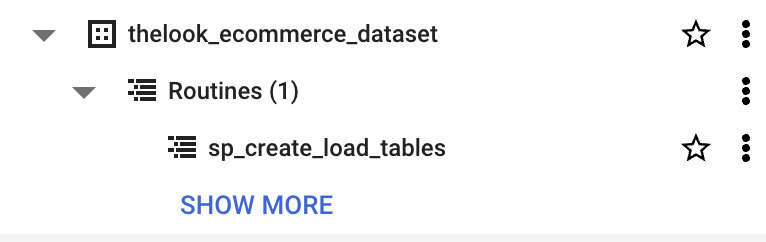

- Klicken Sie auf Speichern. Diese gespeicherte Prozedur wird im Abschnitt Routinen des Datasets angezeigt:

- Klicken Sie auf Ausführen, um diese gespeicherte Prozedur auszuführen.

Führen Sie, wie oben in Schritt 5 von Aufgabe 3 gezeigt, die SELECT SQL-Anweisung aus, um die Entfernung zwischen jedem Kunden und dem nächstgelegenen Verteilzentrum zu bestimmen.

- Kopieren Sie die folgende skalare Unterabfrage in den Abfrageeditor:

SELECT

customers.id as customer_id,

(

SELECT

MIN(ST_DISTANCE(centers.point_location, customers.point_location))/1000,

FROM

`thelook_ecommerce.centers` AS centers) AS distance_to_closest_center

FROM

`thelook_ecommerce.customers` AS customers ;

Mit dieser Abfrage wird die Entfernung in Kilometern berechnet.

- Klicken Sie auf Ausführen.

Klicken Sie auf Fortschritt prüfen, um zu sehen, ob Sie die Aufgabe richtig ausgeführt haben.

Gespeicherte Prozedur erstellen, um Updates zu vereinfachen

Hinweis: In diesem Lab führen Sie keine geplante Abfrage aus. Es ist jedoch wichtig, die verschiedenen Möglichkeiten zum Aktualisieren von Daten und zum Verwalten Ihrer SQL-Pipelines zu verstehen.

Wenn Sie eine geplante Abfrage einrichten möchten, klicken Sie einfach im Abfrageeditor auf Planen. Das Fenster „Neue geplante Abfrage“ wird geöffnet. Hier können Sie verschiedene Abfragedetails angeben. Das ist bei jeder Abfrage möglich, die regelmäßig aktualisiert werden muss.

Fazit

Gut gemacht!

Sie haben SQL und BigQuery erfolgreich verwendet, um eine einfache und flexible Datenpipeline zu erstellen, die eine geschäftliche Anforderung erfüllt.

Zuerst haben Sie ein Dataset erstellt und Tabellenschemas für die aufzunehmenden Daten definiert. Als Nächstes haben Sie eine Reihe von Transformationen durchgeführt und analysiert.

Dann haben Sie die Transformationen auf die Daten angewendet, bevor Sie die transformierten Daten in neu definierte Tabellen geladen haben.

Abschließend haben Sie diese Abfragen in einer gespeicherten Prozedur formalisiert, um relevante berechnete Werte und die Vorgehensweise bei der Einrichtung geplanter Abfragen für regelmäßige Aktualisierungen einzubeziehen.

In diesem Lab haben Sie gelernt, wie wichtig es ist, Datasets zu erstellen und Tabellenschemas für die darin enthaltenen Daten zu definieren. Durch das Ausführen und Untersuchen einer Reihe von Transformationen haben Sie die erforderlichen Kenntnisse erworben, um Transformationen auf Daten anzuwenden, bevor Sie die transformierten Daten in neu definierte Tabellen laden. Außerdem haben Sie gelernt, wie Sie diese Abfragen in einer gespeicherten Prozedur formalisieren, um relevante berechnete Werte und die Vorgehensweise bei der Einrichtung geplanter Abfragen für regelmäßige Aktualisierungen einzubeziehen.

Sie sind auf dem besten Weg, zu verstehen, wie BigQuery zum Erstellen und Verwalten von SQL-Pipelines verwendet werden kann.

Lab beenden

Bevor Sie das Lab beenden, sehen Sie nach, ob Sie alle Aufgaben erledigt haben. Wenn Sie soweit sind, klicken Sie auf Lab beenden und dann auf Senden.

Wenn Sie das Lab beenden, haben Sie keinen Zugriff mehr auf die Lab-Umgebung und können auch nicht mehr auf die darin ausgeführten Aufgaben zugreifen.

© 2026 Google LLC. Alle Rechte vorbehalten. Google und das Google-Logo sind Marken von Google LLC. Alle anderen Unternehmens- und Produktnamen können Marken der jeweils mit ihnen verbundenen Unternehmen sein.

WICHTIG:

WICHTIG: Dieses Lab sollte nur auf einem Computer oder Laptop durchgeführt werden.

Dieses Lab sollte nur auf einem Computer oder Laptop durchgeführt werden. Pro Lab sind nur 5 Versuche zulässig.

Pro Lab sind nur 5 Versuche zulässig. Zur Erinnerung: Es ist ganz normal, beim ersten Versuch nicht alle Fragen richtig zu beantworten oder eine Aufgabe wiederholen zu müssen – das gehört zum Lernprozess.

Zur Erinnerung: Es ist ganz normal, beim ersten Versuch nicht alle Fragen richtig zu beantworten oder eine Aufgabe wiederholen zu müssen – das gehört zum Lernprozess. Sobald ein Lab gestartet wurde, kann der Timer nicht mehr pausiert werden. Nach 1 Stunde und 30 Minuten wird das Lab beendet und Sie müssen von vorne beginnen.

Sobald ein Lab gestartet wurde, kann der Timer nicht mehr pausiert werden. Nach 1 Stunde und 30 Minuten wird das Lab beendet und Sie müssen von vorne beginnen. Weitere Informationen finden Sie in den technischen Tipps zum Lab.

Weitere Informationen finden Sie in den technischen Tipps zum Lab.

) die Option BigQuery aus.

) die Option BigQuery aus. ) und klicken Sie auf Dataset erstellen.

) und klicken Sie auf Dataset erstellen.