GSP812

Ringkasan

Lab ini akan menunjukkan cara menggunakan Cloud Data Fusion untuk mengeksplorasi silsilah data: Asal data dan perpindahannya dari waktu ke waktu.

Silsilah data Cloud Data Fusion membantu Anda:

- Mendeteksi penyebab utama peristiwa data bermasalah.

- Melakukan analisis dampak sebelum membuat perubahan data.

Cloud Data Fusion menyediakan silsilah di tingkat set data dan tingkat kolom, serta berbatas waktu untuk menunjukkan silsilah dari waktu ke waktu.

-

Silsilah tingkat set data menunjukkan hubungan antara set data dan pipeline dalam interval waktu yang dipilih.

-

Silsilah tingkat kolom menunjukkan operasi yang dilakukan pada sekumpulan kolom di set data sumber untuk menghasilkan sekumpulan kolom yang berbeda di set data target.

Untuk tujuan lab ini, Anda akan menggunakan dua pipeline yang menunjukkan skenario umum di mana data mentah dibersihkan lalu dikirim untuk pemrosesan downstream. Jejak data ini—dari data mentah, data pengiriman yang telah dibersihkan, hingga output analisis—dapat dieksplorasi menggunakan fitur silsilah Cloud Data Fusion.

Catatan: Saat ini, fitur Silsilah Cloud Data Fusion hanya tersedia di Cloud Data Fusion Enterprise Edition.

Tujuan

Dalam lab ini, Anda akan mempelajari cara:

- Menjalankan contoh pipeline untuk menghasilkan silsilah.

- Mengeksplorasi silsilah tingkat set data dan tingkat kolom.

- Meneruskan informasi handshake dari pipeline upstream ke pipeline downstream.

Penyiapan dan persyaratan

Untuk setiap lab, Anda akan memperoleh project Google Cloud baru serta serangkaian resource selama jangka waktu tertentu, tanpa biaya.

-

Login ke Google Skills menggunakan jendela samaran.

-

Perhatikan waktu akses lab (misalnya, 02:00:00), dan pastikan Anda dapat menyelesaikannya dalam waktu tersebut.

Tidak ada fitur jeda. Bila perlu, Anda dapat memulai ulang lab, tetapi Anda harus memulai dari awal.

-

Jika sudah siap, klik Start lab.

Catatan: Setelah Anda mengklik Start lab, perlu waktu sekitar 15 - 20 menit agar resource yang diperlukan disediakan dan instance Data Fusion dibuat.

Selama waktu ini, Anda dapat membaca langkah-langkah di bawah untuk mengetahui sasaran lab.

Jika Anda melihat kredensial lab (Nama pengguna dan Sandi) di panel kiri, artinya instance telah dibuat dan Anda dapat melanjutkan dengan login ke konsol.

-

Catat kredensial lab (Nama pengguna dan Sandi) Anda. Anda akan menggunakannya untuk login ke Konsol Google Cloud.

-

Klik Open Google console.

-

Klik Use another account, lalu salin/tempel kredensial lab ini ke perintah yang muncul.

Jika menggunakan kredensial lain, Anda akan menerima pesan error atau dikenai biaya.

-

Setujui ketentuan dan lewati halaman resource pemulihan.

Catatan: Jangan klik End lab kecuali Anda sudah menyelesaikan lab atau ingin mengulanginya. Tindakan ini akan membersihkan pekerjaan Anda dan menghapus project.

Login ke Konsol Google Cloud.

- Dengan menggunakan tab atau jendela browser yang Anda gunakan untuk sesi lab ini, salin Username dari panel Connection Details, lalu klik tombol Open Google Console.

Catatan: Jika Anda diminta untuk memilih akun, klik Use another account.

- Tempel Username, lalu Password saat diminta.

- Klik Next.

- Setujui persyaratan dan ketentuan.

Karena ini adalah akun sementara yang hanya akan berlaku selama penggunaan lab ini, Anda disarankan untuk:

- Tidak menambahkan opsi pemulihan

- Tidak mendaftar ke uji coba gratis

- Setelah konsol terbuka, lihat daftar layanan dengan mengklik Navigation menu (

) di kiri atas.

) di kiri atas.

Mengaktifkan Cloud Shell

Cloud Shell adalah mesin virtual dengan beberapa alat pengembangan. Mesin virtual ini menawarkan direktori beranda persisten berkapasitas 5 GB dan berjalan di Google Cloud. Cloud Shell memberikan akses command line ke resource Google Cloud Anda. gcloud adalah alat command line untuk Google Cloud. Fitur ini sudah terinstal di Cloud Shell dan mendukung penyelesaian tab.

-

Di Google Cloud Console, pada panel navigasi, klik Activate Cloud Shell ( ).

).

-

Klik Continue.

Perlu waktu beberapa saat untuk menyediakan dan menghubungkan ke lingkungan. Setelah terhubung, Anda juga diautentikasi, dan project ditetapkan ke PROJECT_ID Anda. Contoh:

Contoh perintah

gcloud auth list

(Output)

Akun berkredensial:

- <myaccount>@<mydomain>.com (active)

(Contoh output)

Akun berkredensial:

- google1623327_student@qwiklabs.net

gcloud config list project

(Output)

[core]

project = <project_ID>

(Contoh output)

[core]

project = qwiklabs-gcp-44776a13dea667a6

Memeriksa izin project

Sebelum mulai bekerja di Google Cloud, Anda harus memastikan project Anda memiliki izin yang tepat dalam Identity and Access Management (IAM).

-

Di Konsol Google Cloud, pada Navigation menu ( ), klik IAM & Admin > IAM.

), klik IAM & Admin > IAM.

-

Pastikan Akun Layanan komputasi default {project-number}-compute@developer.gserviceaccount.com tersedia dan peran editor telah ditetapkan. Prefiks akun adalah nomor project yang dapat Anda temukan di Navigation menu > Cloud overview.

Jika akun tersebut tidak ada di IAM atau tidak memiliki peran editor, ikuti langkah-langkah di bawah untuk menetapkan peran yang diperlukan.

-

Di Konsol Google Cloud, pada Navigation menu, klik Cloud overview.

-

Dari kartu Project info, salin Project number.

-

Pada Navigation menu, klik IAM & Admin > IAM.

-

Di bagian atas halaman IAM, klik Add.

-

Untuk New principals, ketik:

{project-number}-compute@developer.gserviceaccount.com

Ganti {project-number} dengan nomor project Anda.

-

Untuk Select a role, pilih Basic (atau Project) > Editor.

-

Klik Save.

Prasyarat

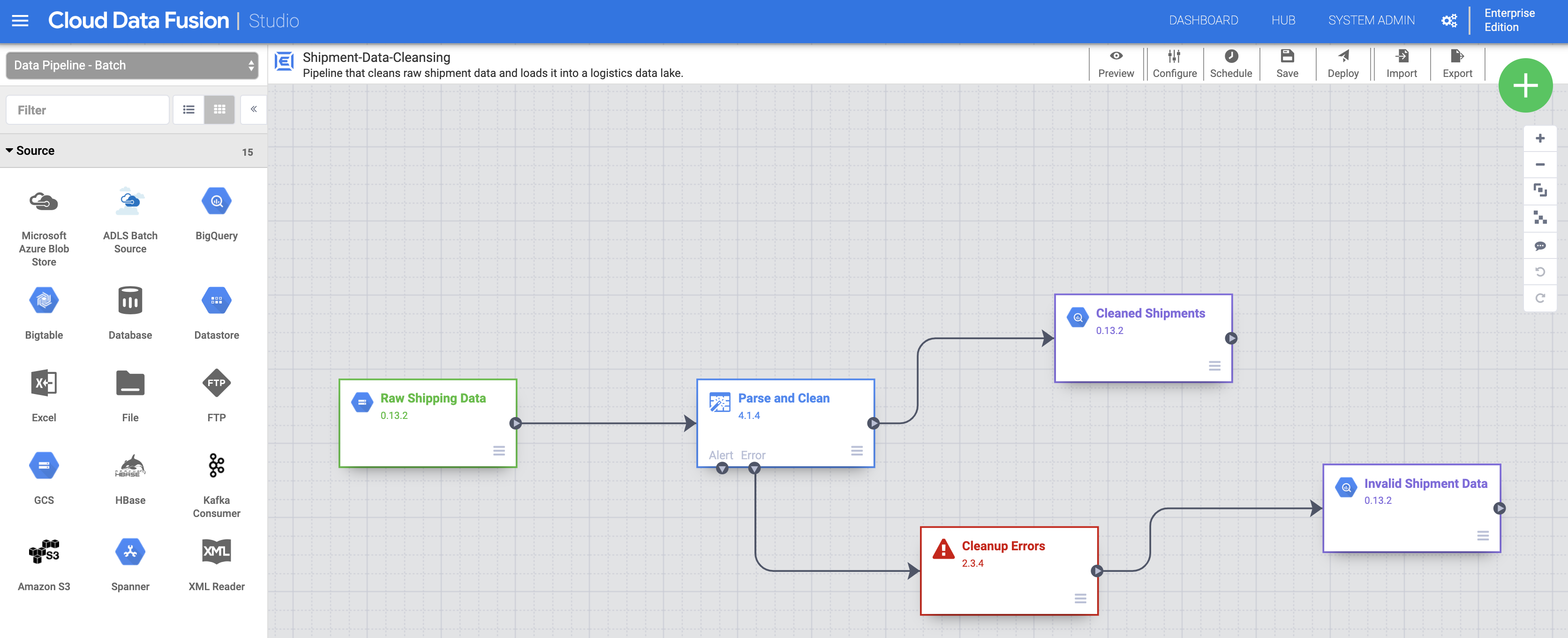

Dalam lab ini, Anda akan menggunakan dua pipeline:

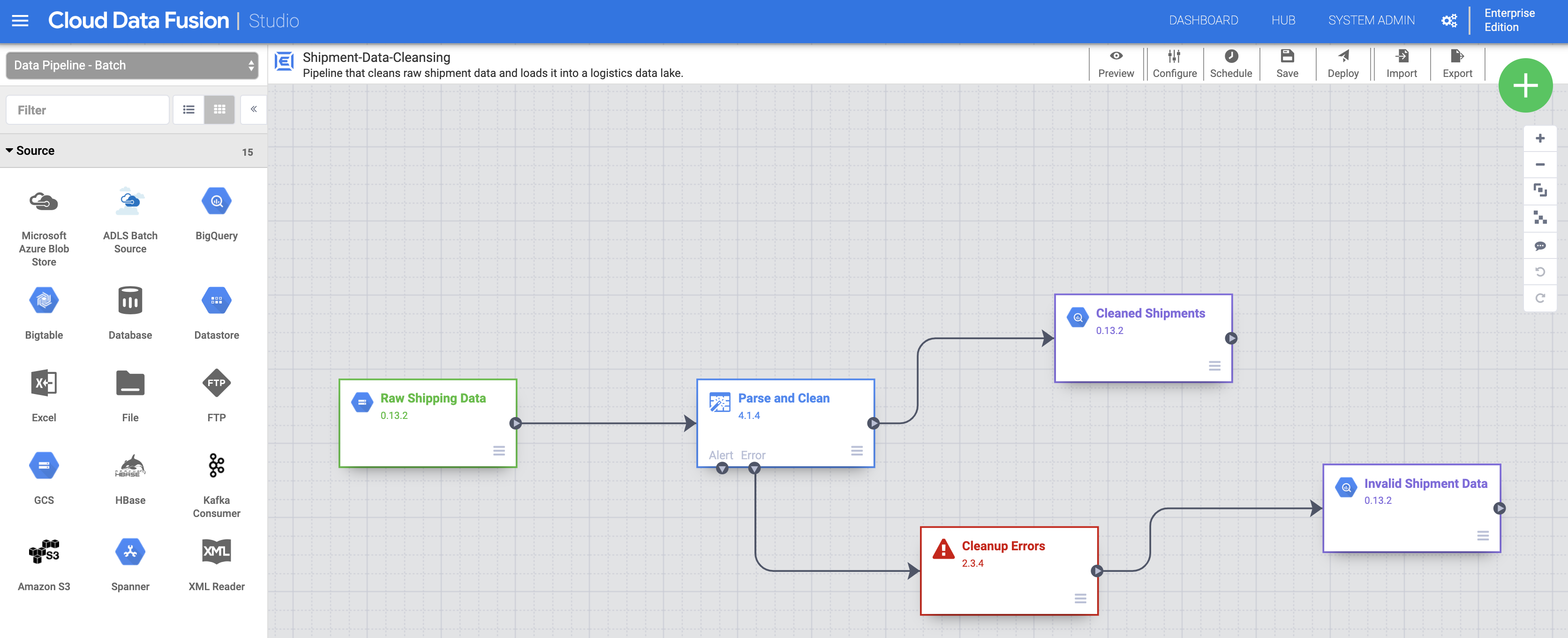

- Pipeline Shipment Data Cleansing, yang membaca data pengiriman mentah dari sampel set data kecil dan menerapkan transformasi untuk membersihkan data tersebut.

- Pipeline Delayed Shipments USA, yang membaca data pengiriman yang telah dibersihkan, menganalisis data tersebut, dan menemukan pengiriman di Amerika Serikat yang tertunda hingga melebihi batas tertentu.

Gunakan link Shipment Data Cleansing dan Delayed Shipments USA untuk mendownload sampel set data ini ke komputer lokal Anda.

Tugas 1. Menambahkan izin yang diperlukan untuk instance Cloud Data Fusion Anda

- Di kolom judul Konsol Google Cloud, ketik Data Fusion di kolom Search, lalu klik Data Fusion dalam hasil penelusuran. Klik Instances.

Catatan: Pembuatan instance memerlukan waktu sekitar 20 menit. Tunggu hingga instance siap.

Selanjutnya, Anda akan memberikan izin ke akun layanan yang terkait dengan instance tersebut, menggunakan langkah-langkah berikut.

-

Dari Konsol Google Cloud, buka IAM & Admin > IAM.

-

Pastikan Compute Engine Default Service Account {project-number}-compute@developer.gserviceaccount.com ada, lalu salin Service Account tersebut ke papan klip Anda.

-

Di halaman IAM Permissions, klik +Grant Access.

-

Di kolom New principals, tempelkan akun layanan tadi.

-

Klik Select a role field dan mulai ketik Cloud Data Fusion API Service Agent, lalu pilih peran tersebut.

-

Klik ADD ANOTHER ROLE.

-

Tambahkan peran Dataproc Administrator.

-

Klik Save.

Klik Periksa progres saya untuk memverifikasi tujuan.

Menambahkan peran Agen Layanan Cloud Data Fusion API ke akun layanan

Memberikan izin pengguna kepada akun layanan

-

Di konsol, pada Navigation menu, klik IAM & admin > IAM.

-

Pilih kotak centang Include Google-provided role grants.

-

Scroll ke bawah dalam daftar untuk menemukan akun layanan Cloud Data Fusion yang dikelola Google yang terlihat seperti service-{project-number}@gcp-sa-datafusion.iam.gserviceaccount.com, lalu salin nama akun layanan tersebut ke papan klip Anda.

-

Selanjutnya, buka IAM & admin > Service Accounts.

-

Klik akun compute engine default yang terlihat seperti {project-number}-compute@developer.gserviceaccount.com, lalu pilih tab Principals with access di menu navigasi bagian atas.

-

Klik tombol Grant Access.

-

Di kolom New Principals, tempel akun layanan yang telah Anda salin sebelumnya.

-

Pada menu dropdown Role, pilih Service Account User.

-

Klik Save.

Tugas 2. Membuka UI Cloud Data Fusion

-

Buka Data Fusion, klik Instances, lalu klik link View Instance di samping instance Data Fusion Anda. Pilih kredensial lab Anda untuk login. Jika diminta mengikuti tur layanan, klik No, Thanks. Anda kini dialihkan ke UI Cloud Data Fusion.

-

Klik Studio dari panel navigasi kiri untuk membuka halaman Cloud Data Fusion Studio.

Tugas 3. Mengimpor, men-deploy, dan menjalankan pipeline Shipment Data Cleansing

- Selanjutnya, Anda perlu mengimpor Data Pengiriman mentah. Klik Import di kanan atas halaman Studio, lalu pilih dan impor pipeline Shipment Data Cleansing yang telah Anda download.

Catatan:

Jika muncul pop-up yang meminta Anda mengupgrade plugin pipeline, klik Fix All untuk mengupgrade plugin ke versi terbaru.

-

Sekarang, deploy pipeline tersebut. Klik Deploy di kanan atas halaman Studio. Setelah deployment, halaman Pipeline akan terbuka.

-

Klik Run di bagian tengah atas halaman Pipeline untuk menjalankan pipeline.

Catatan: Jika pipeline gagal, jalankan ulang pipeline tersebut

Klik Periksa progres saya untuk memverifikasi tujuan.

Mengimpor, Men-deploy, dan Menjalankan pipeline Shipment Data Cleansing

Tugas 4. Mengimpor, men-deploy, dan menjalankan pipeline data Delayed Shipments

Setelah status Shipping Data Cleansing menampilkan Succeeded, lanjutkan dengan mengimpor dan men-deploy pipeline data Delayed Shipments USA yang telah Anda download.

-

Klik Studio dari panel navigasi kiri untuk kembali ke halaman Cloud Data Fusion Studio.

-

Klik Import di kanan atas halaman Studio, lalu pilih dan impor pipeline data Delayed Shipments USA yang telah Anda download.

Catatan:

Jika muncul pop-up yang meminta Anda mengupgrade plugin pipeline, klik Fix All untuk mengupgrade plugin ke versi terbaru.

-

Deploy pipeline dengan mengklik Deploy di kanan atas halaman Studio. Setelah deployment, halaman Pipeline akan terbuka.

-

Klik Run di bagian tengah atas halaman Pipeline untuk menjalankan pipeline.

Catatan: Jika pipeline gagal, jalankan ulang pipeline tersebut

Setelah pipeline kedua ini berhasil diselesaikan, Anda dapat melanjutkan ke langkah berikutnya di bawah.

Klik Periksa progres saya untuk memverifikasi tujuan.

Mengimpor, Men-deploy, dan Menjalankan pipeline data Delayed Shipments

Tugas 5. Menemukan beberapa set data

Anda harus menemukan set data sebelum mengeksplorasi silsilahnya.

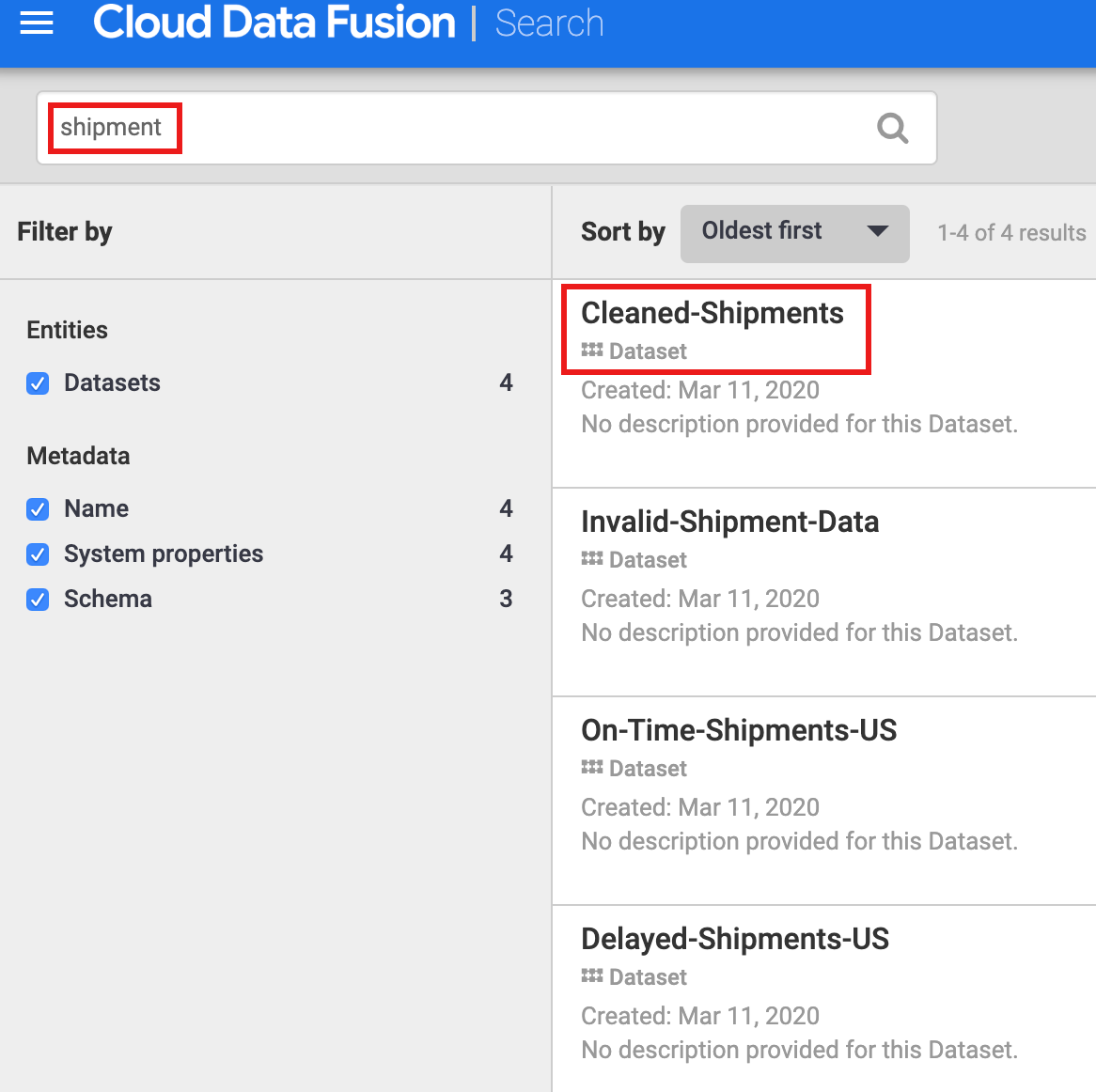

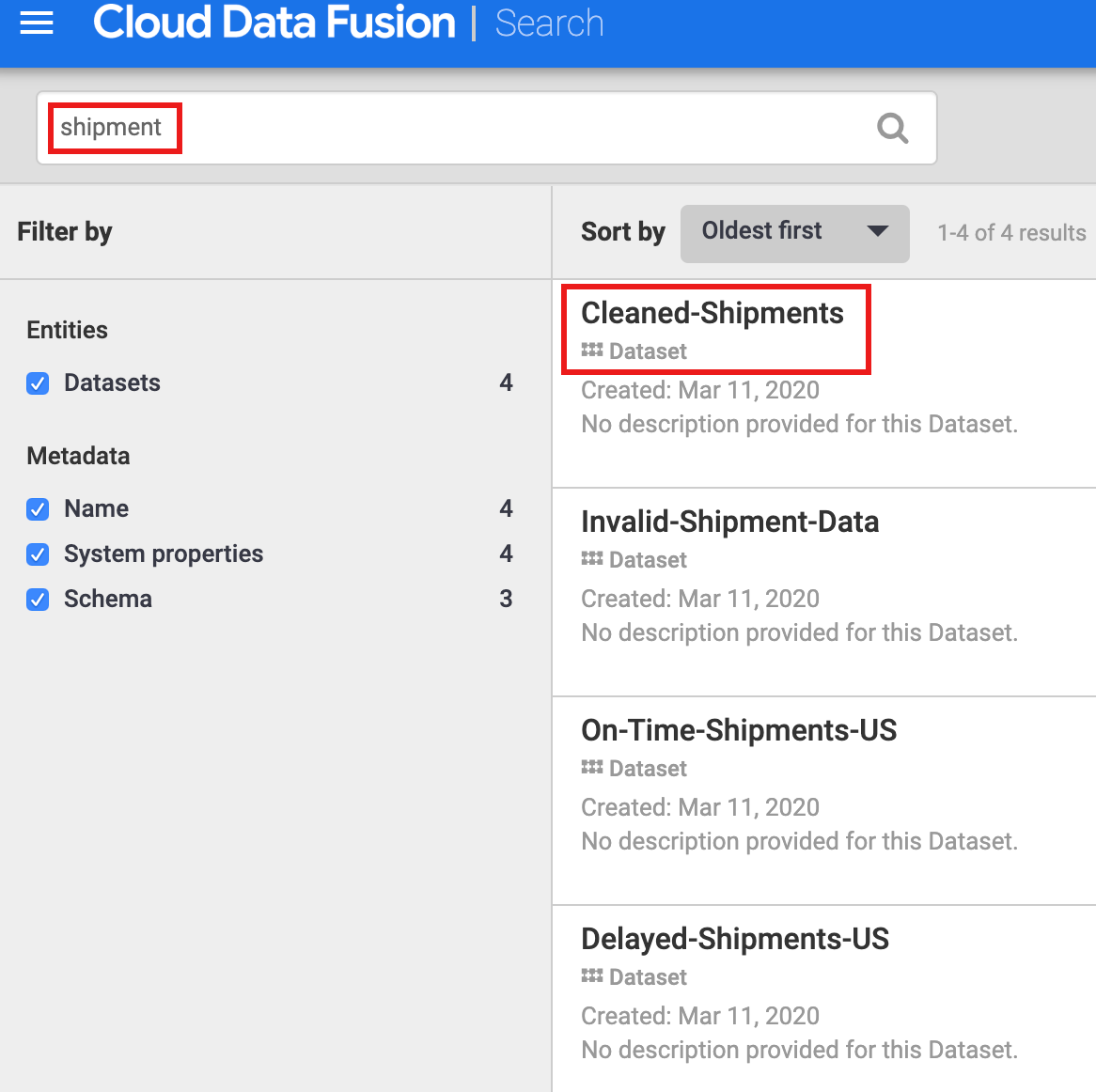

- Pilih Metadata dari panel navigasi kiri UI Cloud Data Fusion untuk membuka halaman Search metadata.

- Karena set data Shipment Data Cleansing menentukan "Cleaned-Shipments" sebagai set data referensi, masukkan

shipment di kotak Search. Hasil penelusuran mencakup set data ini.

Tugas 6. Menggunakan tag untuk menemukan set data

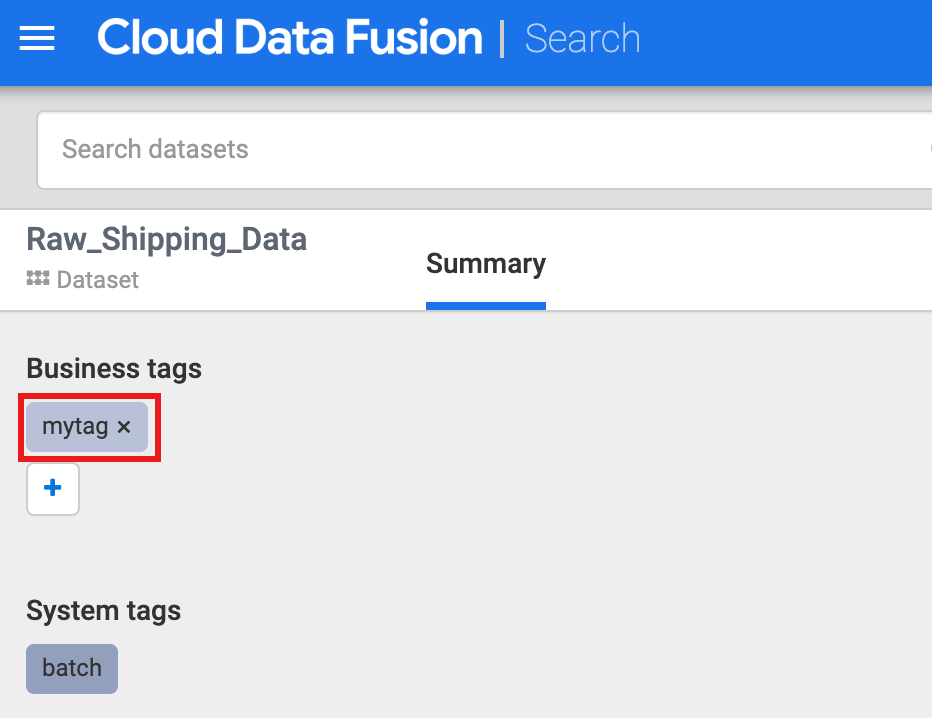

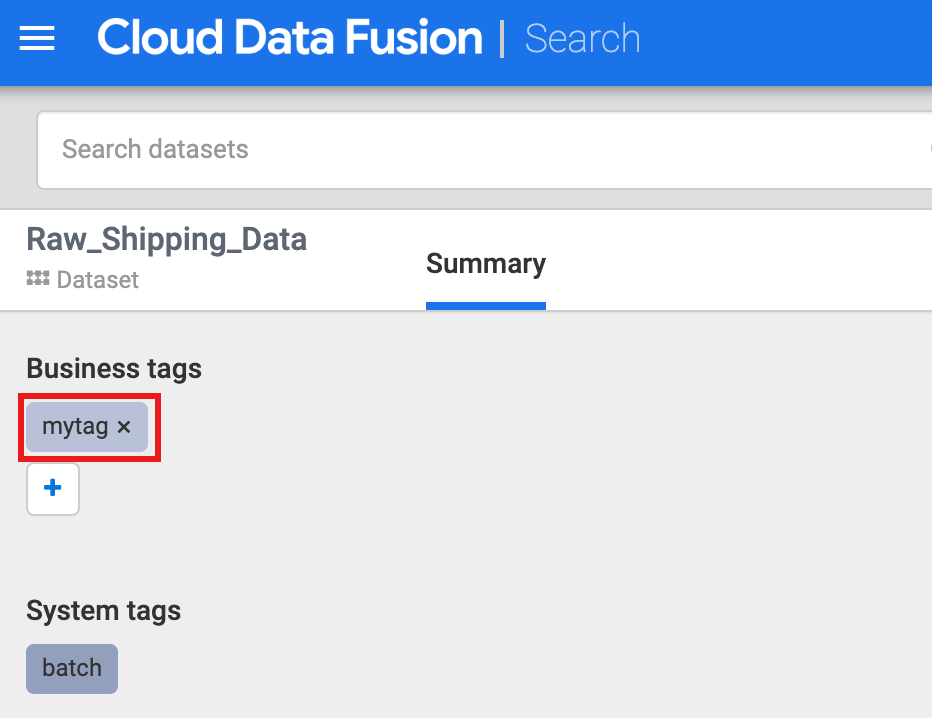

Penelusuran Metadata menemukan set data yang telah digunakan, diproses, atau dihasilkan oleh pipeline Cloud Data Fusion. Pipeline dijalankan pada framework terstruktur yang menghasilkan dan mengumpulkan metadata teknis dan operasional. Metadata teknis mencakup nama, jenis, skema, kolom, waktu pembuatan, dan informasi pemrosesan set data. Informasi teknis ini digunakan oleh fitur silsilah dan penelusuran metadata Cloud Data Fusion.

Meskipun Reference Name sumber dan sink merupakan ID set data unik dan istilah penelusuran yang sangat baik, Anda dapat menggunakan metadata teknis lainnya sebagai kriteria penelusuran, seperti deskripsi, skema, nama kolom, atau awalan metadata set data.

Cloud Data Fusion juga mendukung anotasi set data dengan metadata bisnis, seperti tag dan properti nilai kunci, yang dapat digunakan sebagai kriteria penelusuran. Misalnya, untuk menambahkan dan mencari anotasi tag bisnis pada set data Data Pengiriman Mentah:

-

Pilih Metadata dari panel navigasi kiri UI Cloud Data Fusion untuk membuka halaman Search metadata.

-

Masukkan Raw shipping data di halaman penelusuran opsi metadata.

-

Klik Raw_Shipping_Data.

-

Di bagian Business tags, klik +, lalu masukkan nama tag (karakter alfanumerik dan garis bawah diizinkan) dan tekan Enter.

Anda dapat mencari tag dengan mengklik nama tag itu atau dengan memasukkan tag: tag_name di kotak penelusuran pada halaman penelusuran Metadata.

Tugas 7. Mengeksplorasi silsilah data

Silsilah tingkat set data

-

Pilih Metadata dari panel navigasi kiri UI Cloud Data Fusion untuk membuka halaman Search metadata, lalu masukkan shipment di kotak Search.

-

Klik nama set data Cleaned-Shipments yang tercantum di halaman Search.

-

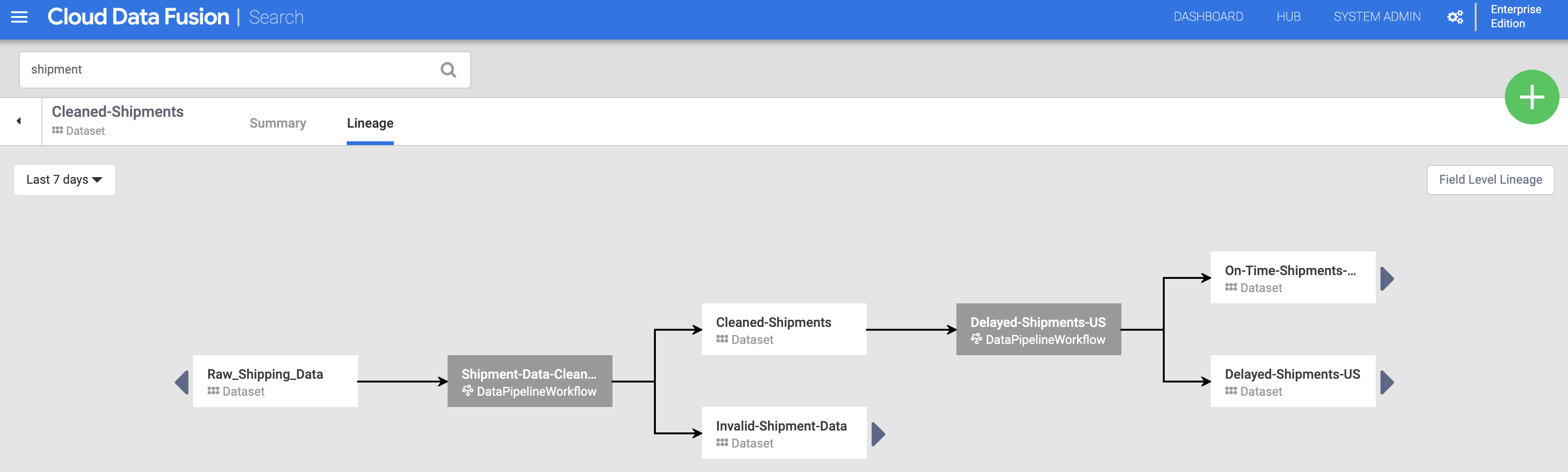

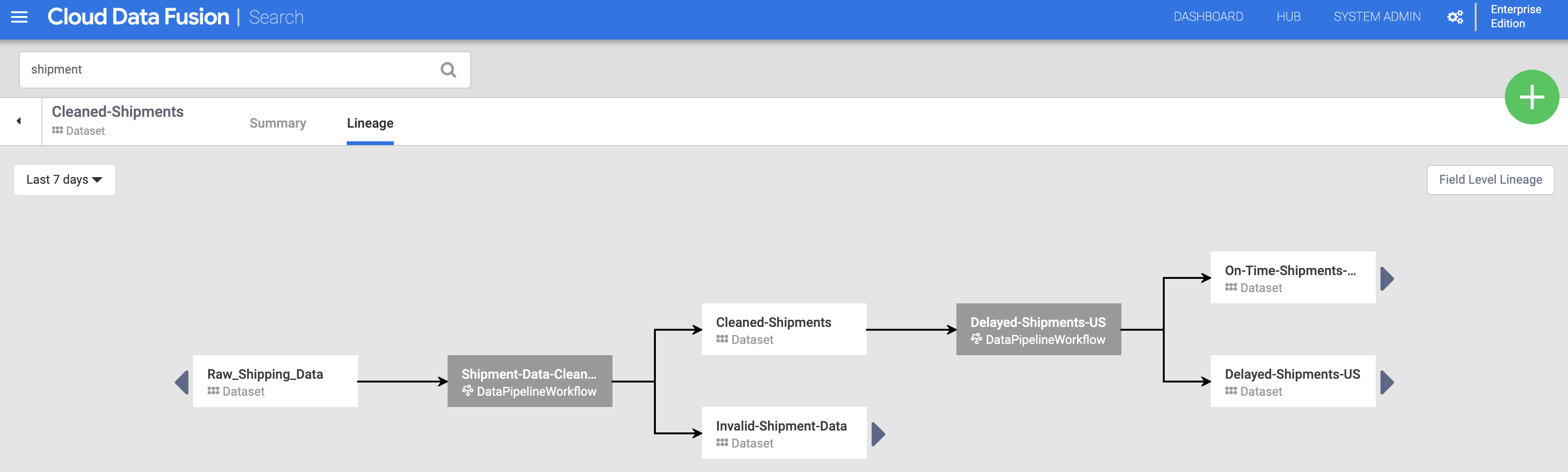

Kemudian, klik tab Lineage. Grafik silsilah menunjukkan bahwa set data ini dihasilkan oleh pipeline Shipments-Data-Cleansing, yang telah menggunakan set data Raw_Shipping_Data.

Silsilah tingkat kolom

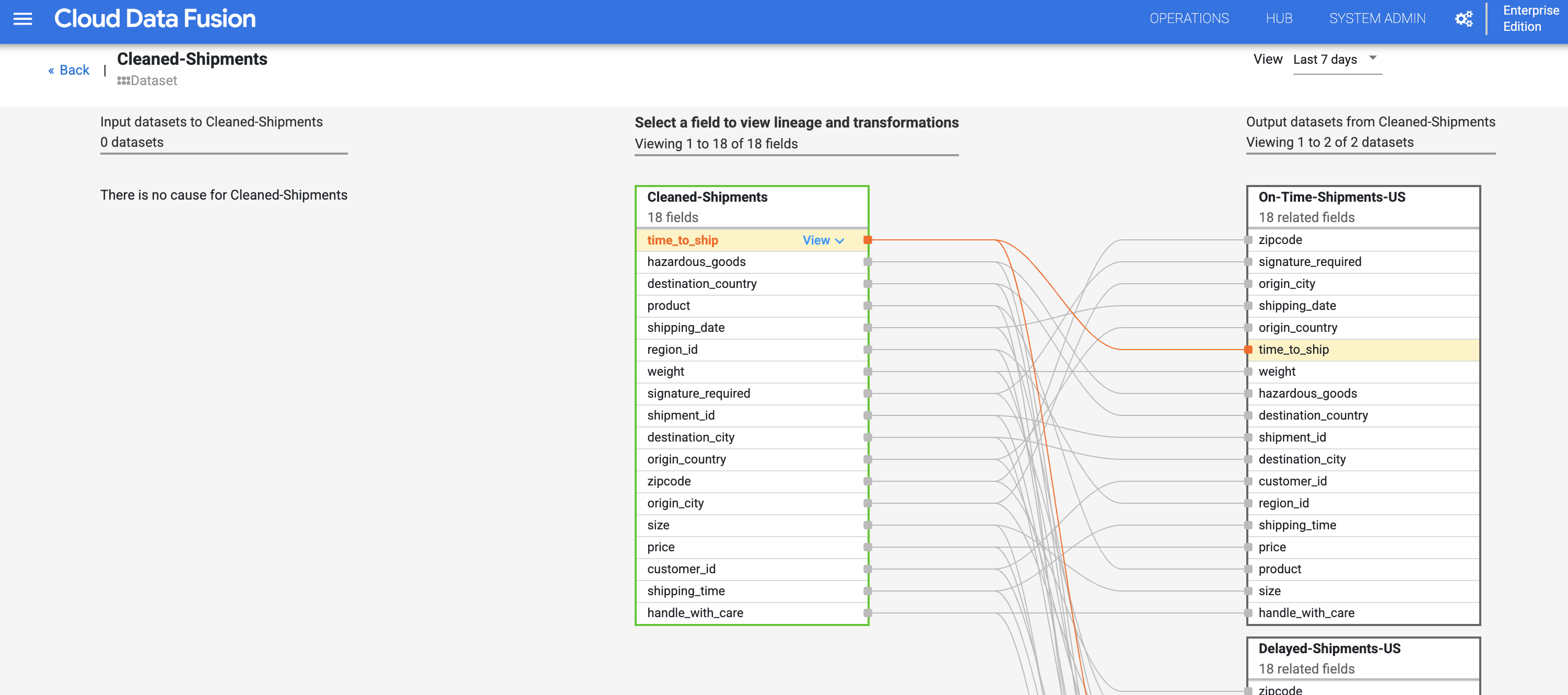

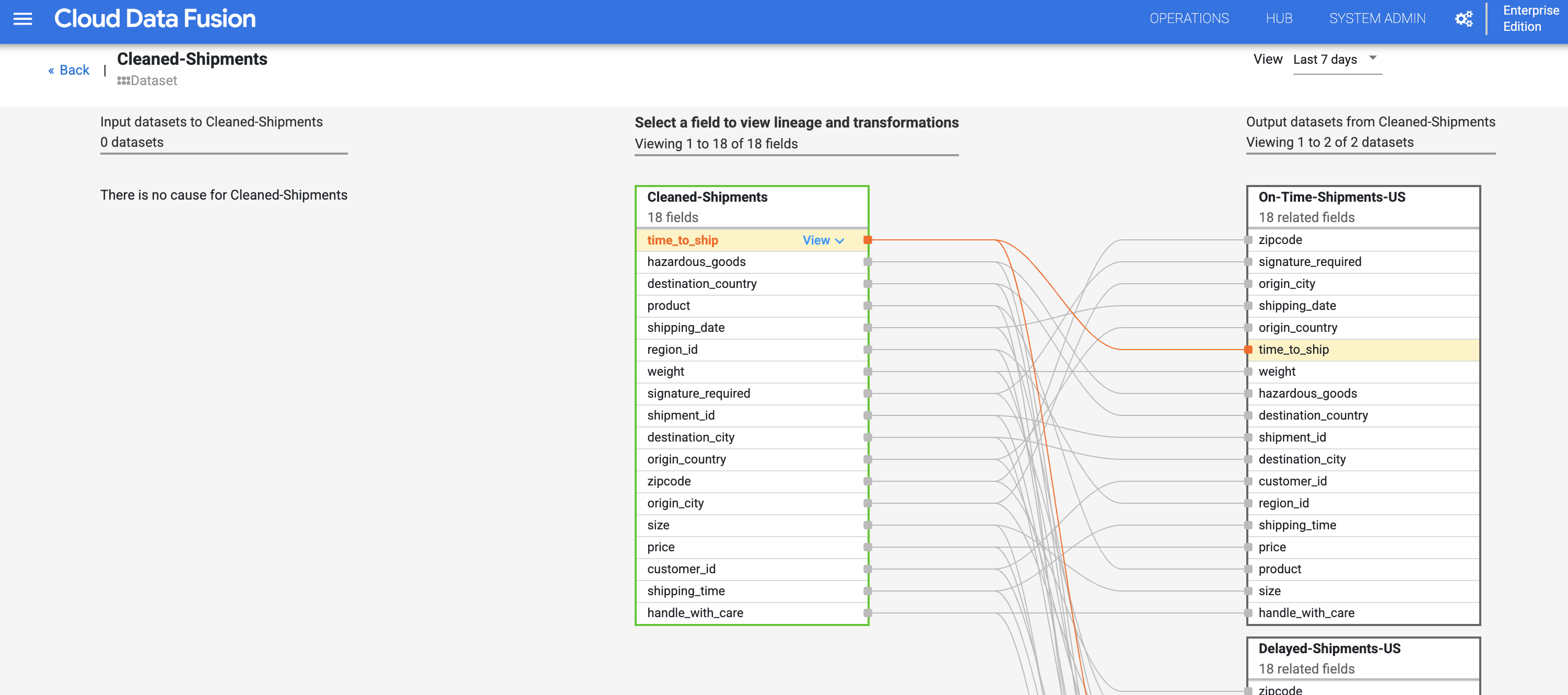

Silsilah tingkat kolom Cloud Data Fusion menunjukkan hubungan antara kolom set data dan transformasi yang dilakukan pada sekumpulan kolom untuk menghasilkan sekumpulan kolom yang berbeda. Seperti silsilah tingkat set data, silsilah tingkat kolom juga terikat waktu, dan hasilnya berubah seiring waktu.

- Melanjutkan dari langkah silsilah tingkat Set data, klik tombol Field Level Lineage di kanan atas grafik silsilah tingkat set data Cleaned Shipments untuk menampilkan grafik silsilah tingkat kolomnya.

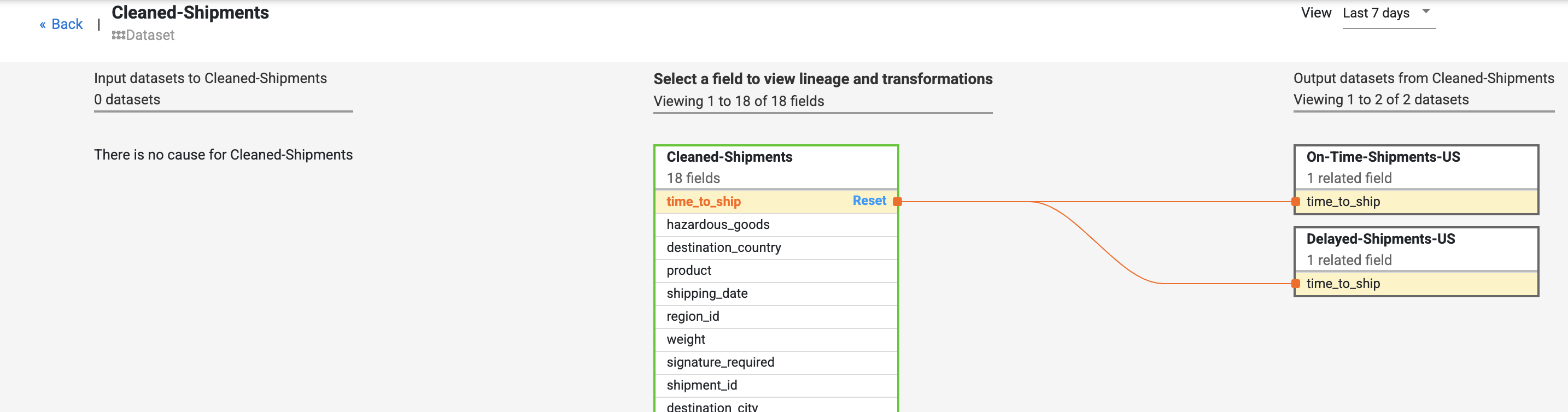

- Grafik silsilah tingkat kolom menunjukkan hubungan antarkolom. Anda dapat memilih sebuah kolom untuk melihat silsilahnya. Pilih View, lalu pilih Pin field untuk melihat silsilah kolom tersebut saja.

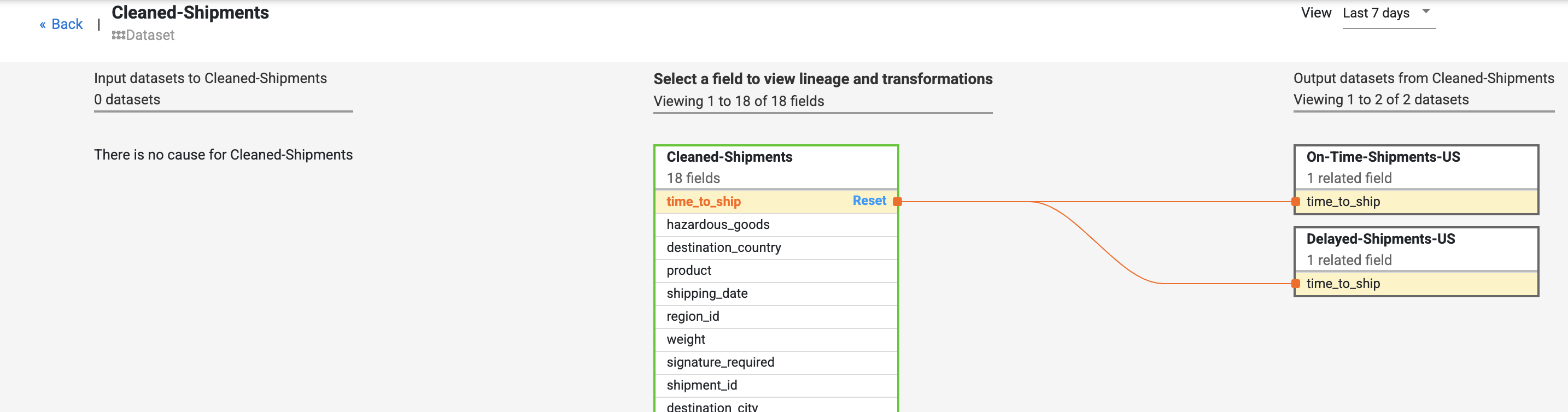

- Temukan kolom time_to_ship di bagian set data Cleaned-Shipments, pilih View, lalu pilih View impact untuk melakukan analisis dampak.

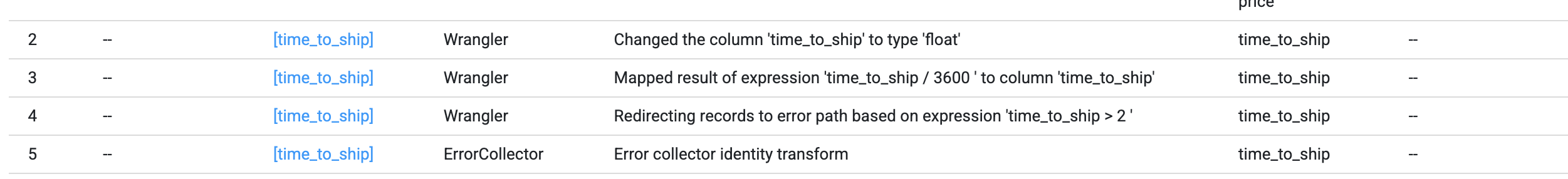

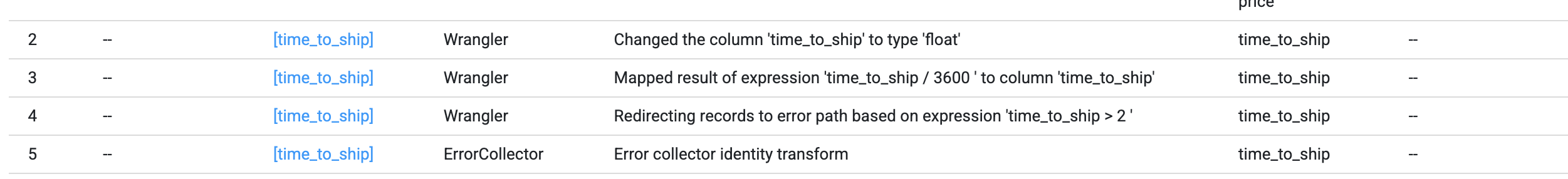

Silsilah tingkat kolom menunjukkan perubahan kolom ini dari waktu ke waktu. Perhatikan transformasi kolom time_to_ship: (i) mengonversinya menjadi kolom jenis float, (ii) menentukan apakah nilai tersebut dialihkan ke node berikutnya atau ke jalur error.

Silsilah ini mengekspos histori perubahan yang telah dialami oleh kolom tertentu. Contoh lainnya mencakup penyambungan beberapa kolom untuk membuat kolom baru (seperti nama depan dan nama belakang yang digabung untuk menghasilkan nama, atau komputasi yang dilakukan pada kolom (seperti mengonversi angka menjadi persentase terhadap total jumlah).

Link penyebab dan dampak menunjukkan transformasi yang dilakukan di kedua sisi kolom dalam format buku besar yang dapat dibaca manusia.

Selamat!

Dalam lab ini, Anda telah mempelajari cara mengeksplorasi silsilah data. Informasi ini bisa jadi penting untuk pelaporan dan tata kelola. Hal ini dapat membantu berbagai audiens memahami bagaimana data dapat berada dalam kondisi seperti sekarang.

Manual Terakhir Diperbarui: 14 November 2022

Lab Terakhir Diuji: 8 Agustus 2023

Hak cipta 2026 Google LLC. Semua hak dilindungi undang-undang. Google dan logo Google adalah merek dagang dari Google LLC. Semua nama perusahaan dan produk lain mungkin adalah merek dagang dari tiap-tiap perusahaan yang bersangkutan.

) di kiri atas.

) di kiri atas.

).

).